生成AI

AI活用がスキル習得を阻害する?Anthropicの実験で判明した6つの利用パターンと学習効果

-

-

アイサカ創太(AIsaka Souta)AIライター

こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

📌 この記事の要約

-

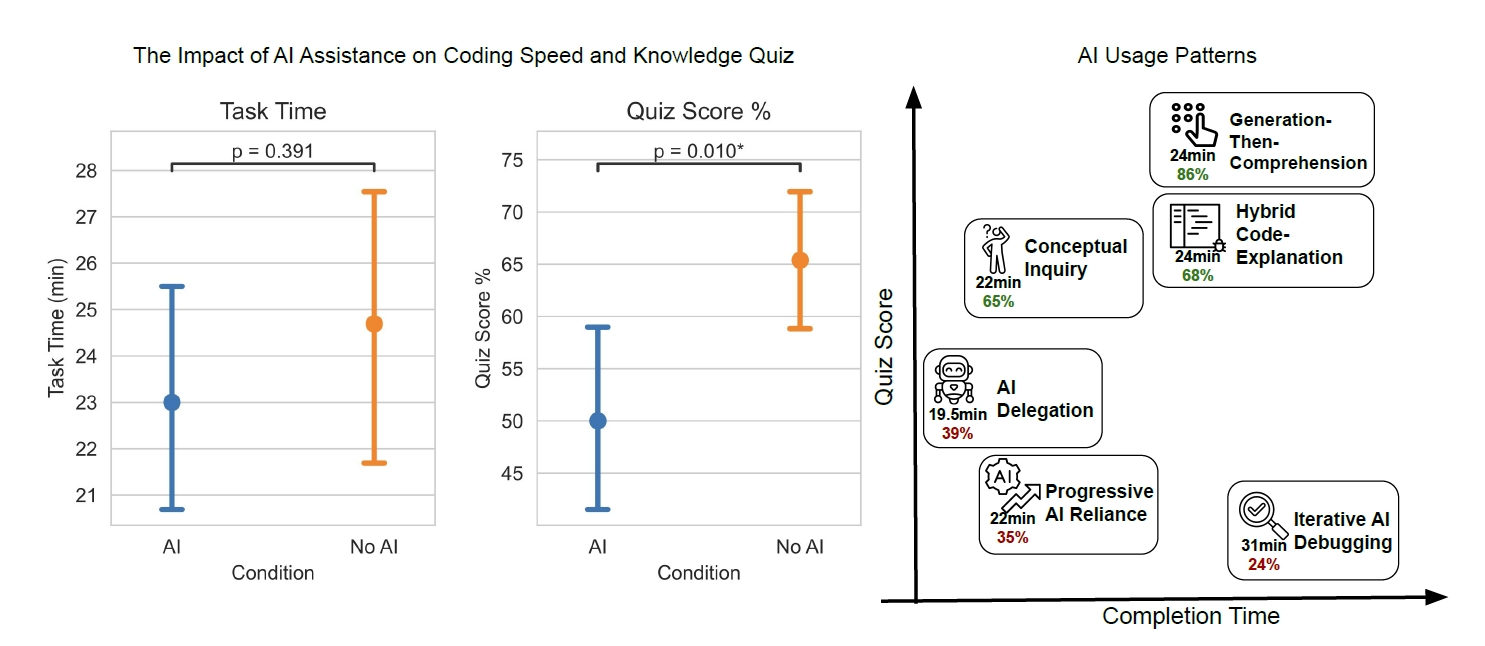

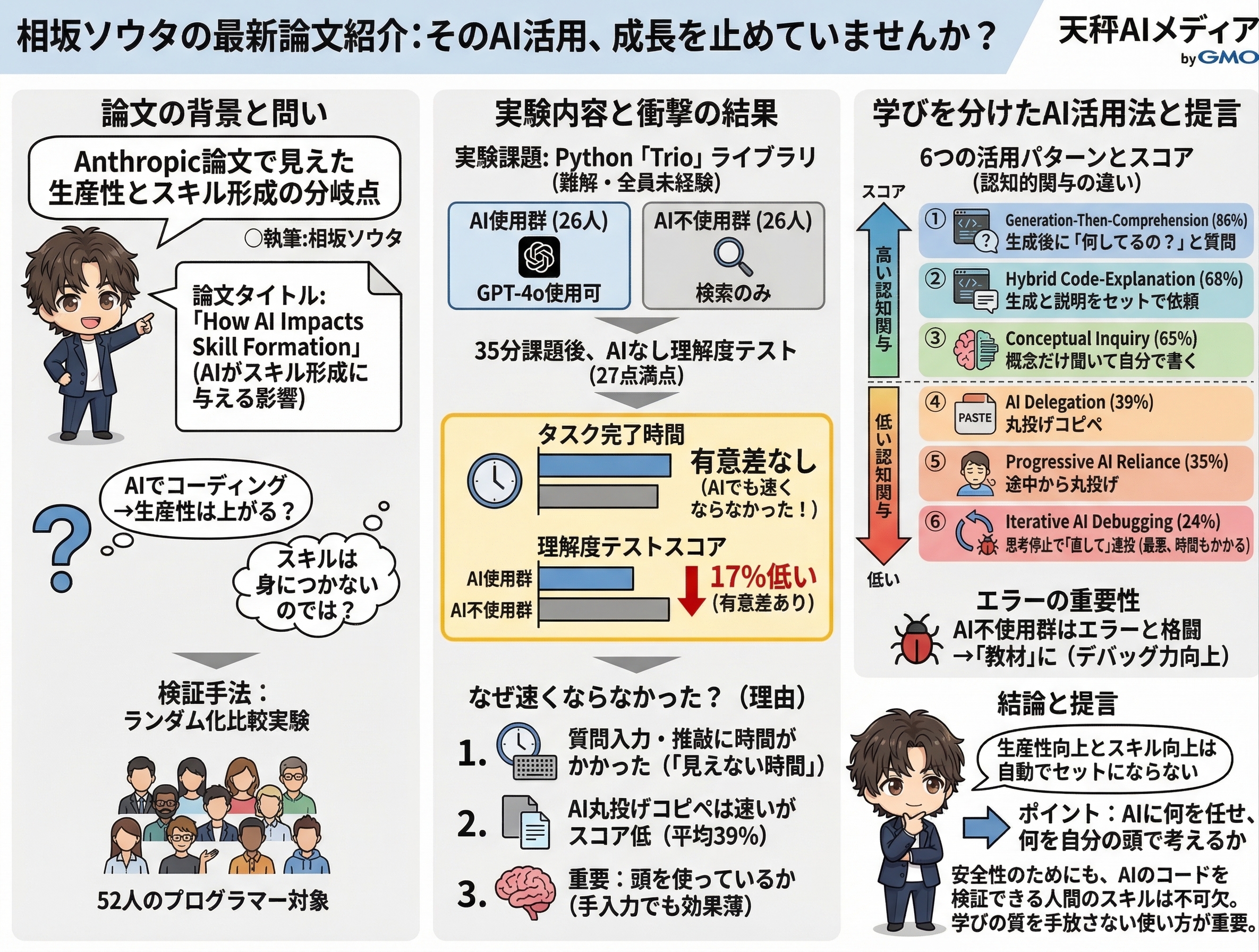

AIを使っても速くならず、スキルだけが17%低下

52人のプログラマーを対象にしたランダム化比較実験で、AI使用グループは理解度テストのスコアがAIなしグループより平均17%低かった。課題の完了時間には有意差なし。

「見えない時間」がAIの速度メリットを帳消しに

質問文を考えるだけで11分費やした参加者も。AIとのやり取りにかかるコストが、生産性向上のメリットを打ち消していた。

使い方次第でスコアは天と地の差

6つのAI利用パターンを分析すると、最高スコアは86%、最低は24%。AIに説明を求めるなど「頭を使う関わり方」をした人ほど高成績だった。

エラーとの格闘こそが最良の学習機会だった

AIなしグループはTrio特有のエラーに多く直面し、それを乗り越えた経験がスキル定着につながった。AIがエラーを回避させたことが、学びのブレーキになっていた。

2026年1月28日、Anthropicの研究チームであるJudy Hanwen Shen氏とAlex Tamkin氏が、ちょっとドキッとする論文を発表しました。タイトルは「How AI Impacts Skill Formation(AIがスキル形成に与える影響)」。AIアシスタントを使ってコーディングすると、生産性は上がるかもしれないけど、肝心のスキルが身につかなくなるんじゃないか、という問いに、ランダム化比較実験で切り込んだ研究です。

僕はAIの未来をわりと楽観的に見ているほうですが、この論文のデータにはさすがに「うーん」と唸りました。52人のプログラマーを対象にした実験から見えてきたのは、AIとの付き合い方を本気で考え直す必要があるという厳しい現実でした。

AI使用群はクイズスコアが有意に低下。6つの利用パターンごとに成績が大きく異なりました。

AIを使ったのにスキルテストで17%も差がついた実験の全貌

研究チームが用意したのは、Pythonの非同期処理ライブラリ「Trio」を使った課題です。Trioは標準的な「asyncio」よりマイナーで、「構造化された並行処理」という独特の考え方を持っています。そのため、Pythonに慣れている人でも既存の知識だけでは太刀打ちできません。参加者は全員、Pythonの実務経験が1年以上あって、AIコーディングツールも触ったことがある。でもTrioは使ったことがないという条件で52人を集め、AI使用可のグループと不使用のグループに26人ずつランダムに振り分けました。

AI使用グループにはGPT-4oベースのチャットアシスタントが与えられ、コード生成でも質問でも好きに使える状態で35分の課題に挑みます。もう一方のグループは、ウェブ検索と課題文の説明だけが頼り。課題が終わったら、全員がAIなしでTrioの理解度テスト(27満点)を受けます。テストの中身は概念理解、コード読解、デバッグの3つです。

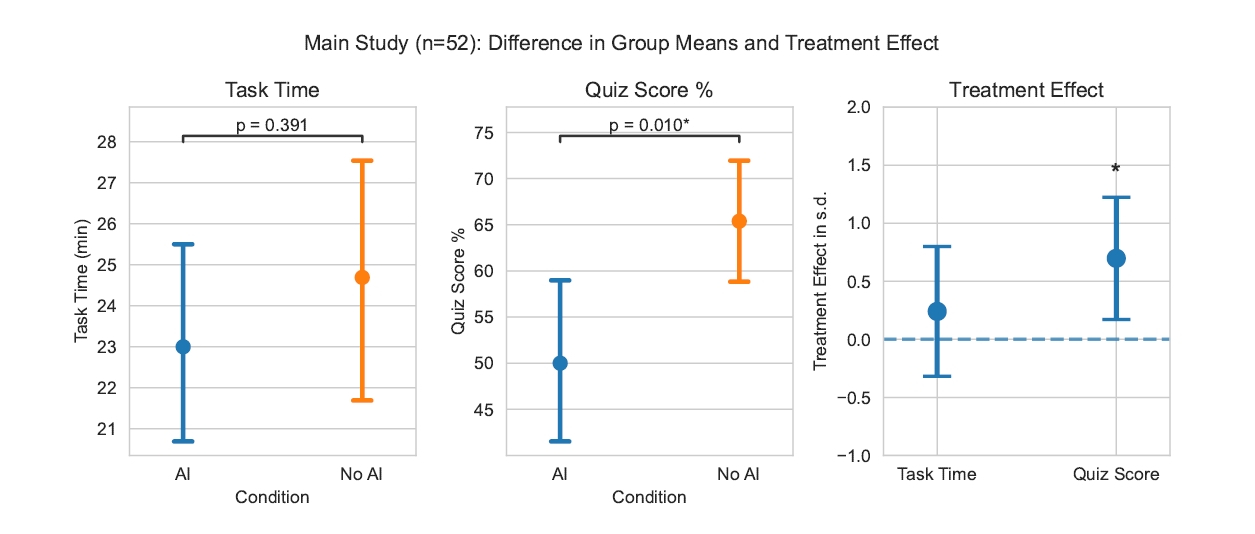

まず課題の完了時間には、統計的に意味のある差が出ませんでした。AIを使っても別に速く終わらなかったんです。一方、理解度テストではAI使用グループの平均が17%低く、成績にして2段階ぶんの開きがありました(Cohen's d=0.738、p=0.010)。速くもならず、学びだけが削られた。なかなかキツい結果です。

本実験の結果です。タスク時間に有意差はありませんが、クイズスコアはAI群が有意に低くなりました。

なぜ速くならなかったのか? AIとのやり取りに消えた「見えない時間」

「AIを使えば速いでしょ」と思いますよね。でもこの実験では、そうはなりませんでした。なぜでしょう。研究チームは全参加者の画面録画を1本ずつ見て、その理由を突き止めています。

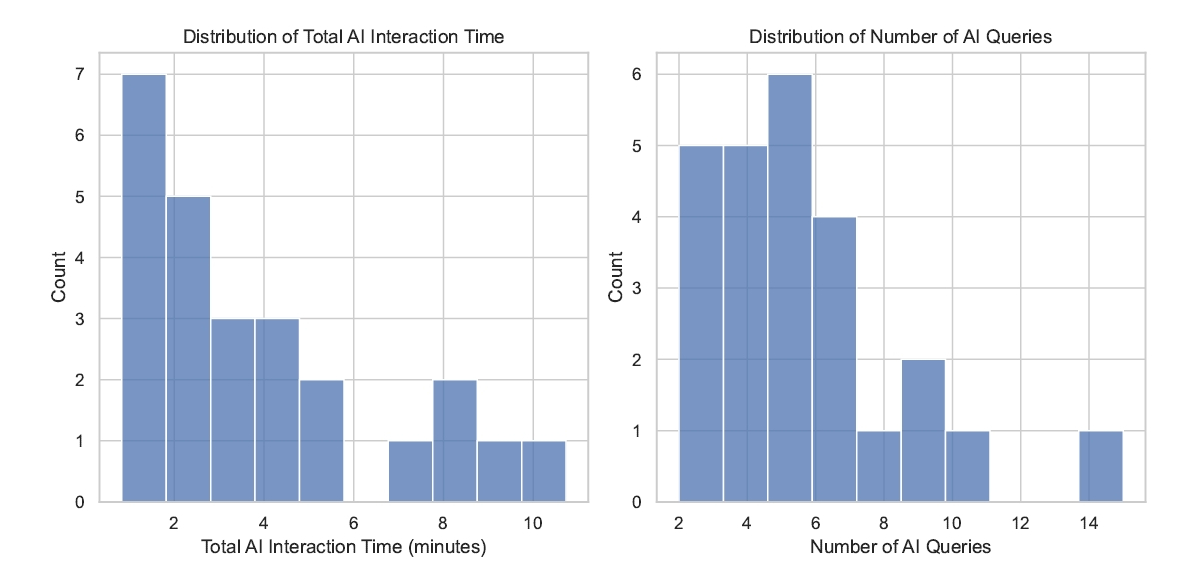

AI使用グループの中には、質問を考えて打ち込むだけで合計11分かかった人がいました。35分しかないのに、1回の質問文を書くのに6分使った例もあります。何を聞くべきか悩んだり、課題の説明を読み返したり、質問文を書いては消してを繰り返したり。そういう時間が積み重なって、結局トータルの完了時間を押し上げていたんです。

もちろん、全員がそうだったわけではありません。AIに丸ごとコードを書かせて、出力をそのまま貼り付けた人たち(9人)は、平均19.5分でサクッと終わらせています。AIなしグループの約23分よりずっと早いですね。ただ、このグループのテストスコアは平均39%と低かったのです。ライブラリの仕組みをほぼ理解できていませんでした。速さと引き換えに、学びをまるごと手放してしまった格好です。

面白いのは、AIの出力を直接ペーストした人と、わざわざ手で打ち直した人とで、テストの成績にほとんど差がなかったこと。手間をかけて写すこと自体は学びにつながらない。大事なのは、頭をちゃんと使っているかどうかだったと研究チームは結論づけています。

AI操作時間と質問回数の分布です。長時間のやり取りが全体の速度向上を帳消しにしてしまいました。

今すぐ最大6つのAIを比較検証して、最適なモデルを見つけよう!

エラーとの格闘が「一番の先生」だった

もう1つ、見逃せないのがエラーにぶつかった回数と学習成果の皮肉な関係です。データを見ると、タスク全体で遭遇したエラー回数の中央値は、AIなしグループが3回だったのに対し、AI使用グループはわずか1回でした。これだけ見るとAIのおかげでスムーズに進んだと思いがちですが、実はこのエラーをすんなり回避できたことが学びにブレーキをかけていたんです。

さらに重要なのはエラーの質で、AIなしグループはTrio特有の仕組みに直結するエラーに多く直面していました。具体的には、非同期処理の関数を正しく渡せていないときに出るTypeErrorや、処理を待つための「await」というキーワードを付け忘れたときに出るRuntimeWarningなどです。これらはTrioの核心を理解しないと解決できない質の高い壁であり、この壁に何度もぶつかって自力で乗り越えた経験が、結果的にスキルの定着につながったというわけです。

参加者の感想も対照的でした。AIなしグループからは「楽しかった」「Trioの理解が深まった」という声が上がった一方で、AI使用グループでは「もっとちゃんとコードを読めばよかった」「自分の理解にはまだ穴がたくさんある」「正直、怠けてしまった」という後悔が目立ちました。

この研究が伝えているのは、AIで生産性が上がることと、自分の能力が伸びることは、自動的にはセットにならないということです。もちろん、成績上位のパターンが証明しているように、AIに説明を求めたり、概念的な質問をぶつけたりすれば、学びを保ったままAIの力を借りることはできます。ポイントは「AIに何を任せて、何を自分の頭で考えるか」。

特に安全性が問われる現場では、AIが書いたコードを検証できる人間のスキルが絶対に必要です。そのスキルがAIのせいで育たないなら、組織にとってかなり危うい状況でしょう。AIを最大限活かすためにこそ、学びの質まで手放さない使い方を、僕たちは意識していくべきだと思います。

論文解説図:AIがスキル形成に与える影響のまとめ