こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

生成AI、特にChatGPTのような大規模言語モデル(LLM)の進化が止まりません。クリエイティブな執筆作業からビジネスのブレインストーミングまで、今やAIは私たちの「アイデア出し」に欠かせないパートナーとなりつつあります。しかし、誰もが同じように便利なAIツールを使い始めた結果、私たちの生み出すアイデアが、知らず知らずのうちに「似通って」しまっているとしたら? そんな恐ろしい可能性を、具体的なデータで検証した研究が登場しました。

2024年5月10日にarXivで公開されたBarrett R. Anderson氏らによる論文「大規模言語モデルが人間の創造的アイデア出しに与える均質化効果(Homogenization Effects of Large Language Models on Human Creative Ideation)」は、AIの未来を信じる私たちにとって、見過ごすことのできない重要な事実を突きつけています。

AIは「アイデアの量」を増やすが、「個性」を奪うのか?

研究チームは、AIが本当に創造性を均質化(Homogenization)してしまうのかを確かめるため、36人の参加者を集めた比較実験を行いました。参加者は、AIの代表として「ChatGPT」を使用するグループと、非AIの創造性支援ツールとして知られる「オブリーク・ストラテジーズ(OS)デッキ」を使用するグループに分けられました。

OSデッキとは、音楽家のブライアン・イーノと芸術家のピーター・シュミットが考案したカードデッキで、「裏返す」「簡単なことを避けるな」といった抽象的な言葉が書かれており、創造的な行き詰まりを打破するために使われるものです。参加者たちはこれら二つのツールを使いながら、トーランス式創造性テストに基づいた発散的アイデア出しタスク(例:「ぬいぐるみをより楽しくするには?」)に挑みました。

まず明らかになったのは、AIの圧倒的な「生産性」です。ChatGPTを使用した参加者は、OSデッキを使用した参加者と比較して、アイデアの総数が約15%増加しました。具体的には、OS使用時の平均7.32個に対し、ChatGPT使用時は平均8.39個のアイデアを生み出しています。さらに、アイデアのカテゴリの多様性においても、OSの平均6.77カテゴリに対し、ChatGPTは平均8.58カテゴリと約27%も上回りました。アイデアの詳細さを示す単語数も、ChatGPT(平均8.25語)がOS(平均6.46語)を凌駕していました。

これらの数値だけを見れば、ChatGPTはアイデアの「量」「種類」「詳細さ」のすべてにおいて人間をサポートし、創造性を高めているように見えます。私もAIの可能性を信じる一人として、この結果は素直に嬉しいものです。AIが私たちの能力を拡張してくれる。そう期待させるデータです。しかし、研究の核心はここからでした。この「量」の増加は、果たして「質」の向上を意味していたのでしょうか。残念ながら、答えは「ノー」だったのです。

恐るべき「均質化」の証拠。なぜ私たちのアウトプットは似通ってしまうのか。

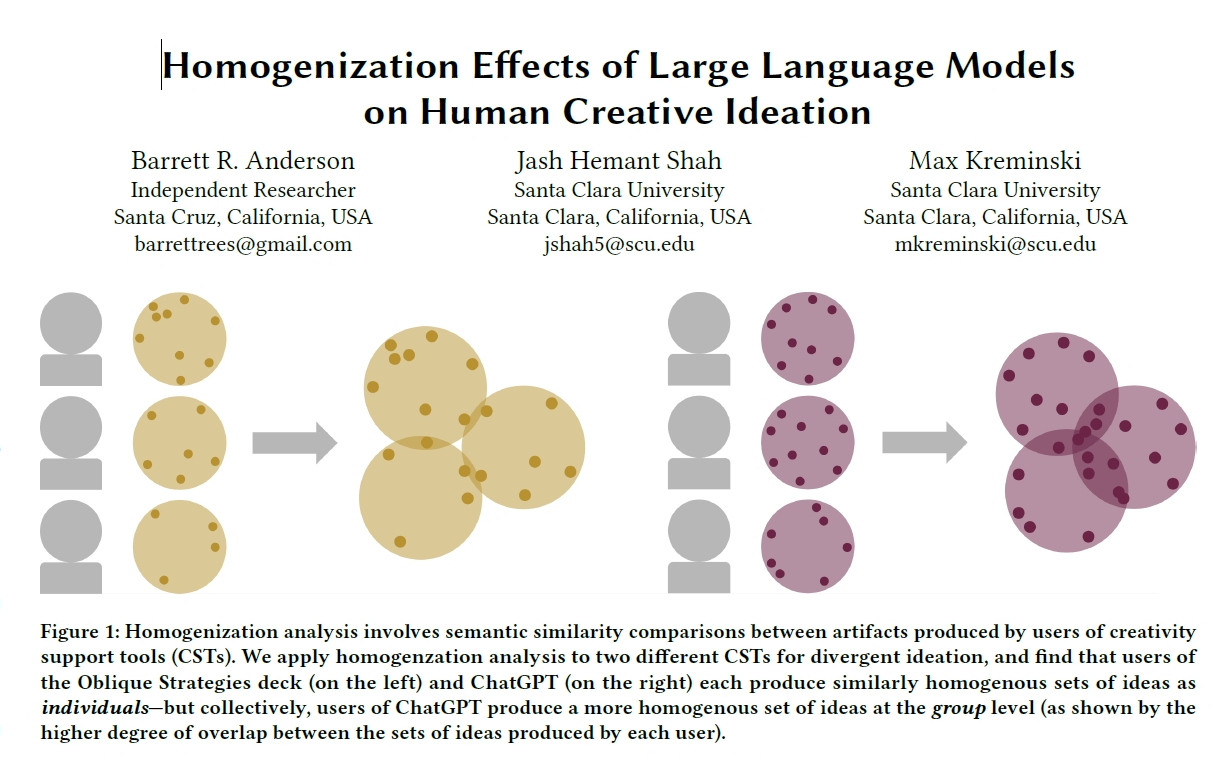

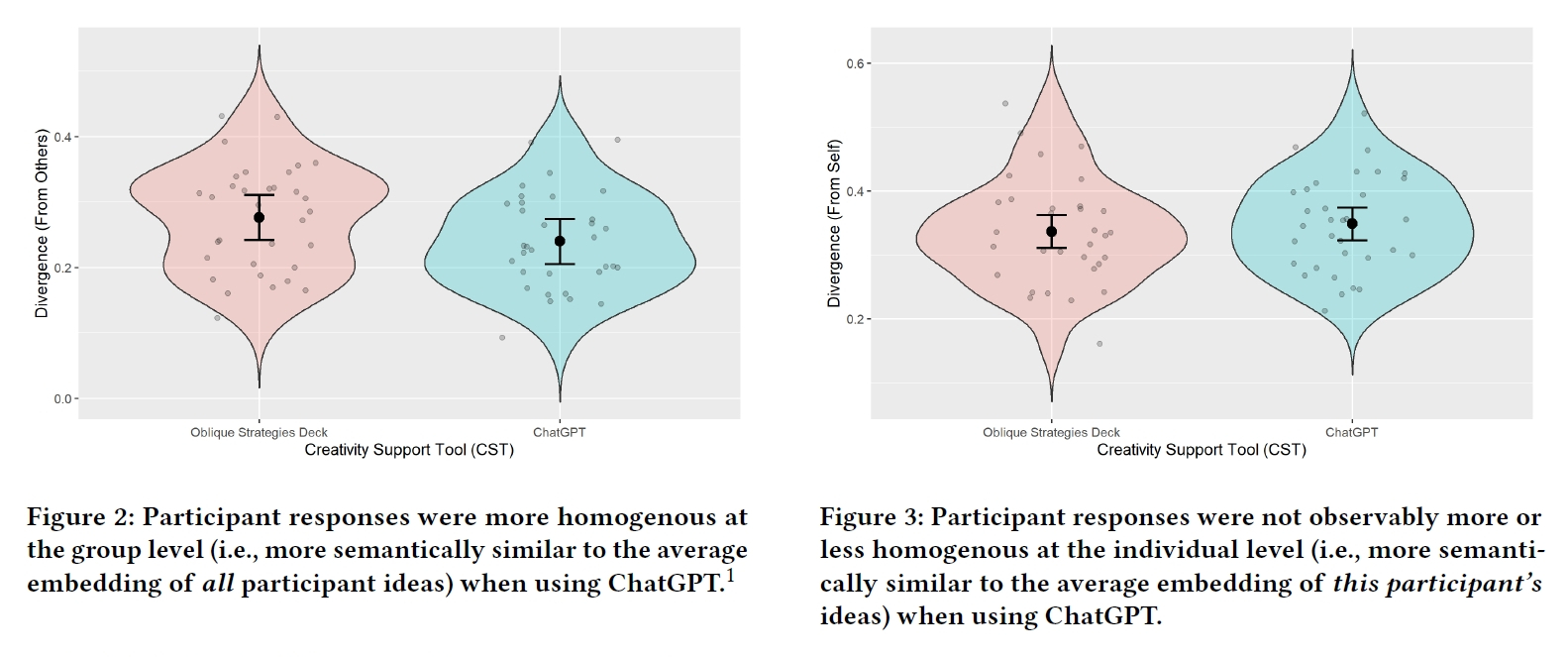

研究チームが次に注目したのは、アイデアの「独自性」と「均質化」です。ここで衝撃的な事実が判明します。グループ全体(参加者36人全員)が生み出したアイデアを意味的な類似性で比較したところ、ChatGPTを使った参加者たちのアイデア群は、OSデッキを使った参加者たちのアイデア群よりも「統計的に有意に類似性が高かった」のです。つまり、ChatGPTを使うことで、集団としてのアウトプットが「均質化」していた、という結論です。一人ひとりは多くのアイデアを出しているにもかかわらず、グループ全体で見ると、みんなが似たような方向性のアイデアに収束してしまいました。

OSデッキを使用したケースでは、個々の参加者が出したアイデアの集合が、それぞれ異なる領域に散らばっており、重なりが小さくなりました。一方で、ChatGPTを使用したケースでは、個々のアイデアが密集し、大きく重なり合ったのです。これはまさに、AIによってアイデアが均質化されている様子を可視化された、と言えるでしょう。

なぜ、このようなことが起こるのでしょうか。論文の考察では、LLMの基本的な性質が指摘されています。ChatGPTは、その訓練データに基づき「統計的にもっともらしい(ありふれた)」回答を生成するのが得意です。そのため、異なるユーザーが似たようなプロンプトを与えた場合、どうしても類似した、いわば最大公約数的なアイデアを提案してしまう傾向がある。私たちはAIから「ひらめき」をもらっているつもりでも、実は他の多くの人と同じ当たり障りのない答えへ誘導されているのかもしれません。

黄色がOSデッキ使用、紫色がChatGPTを使用したケースです。

均質化は「個人の思考停止」ではなく「AIの誘導」が原因だった。

では、AIを使うと私たちの思考は停止し、決まりきったアイデアしか出せなくなるのでしょうか? ここで、研究はさらに興味深い側面を明らかにします。研究チームは次に、「個人レベル」での多様性、つまり一人の参加者が生み出したアイデア同士がどれだけ多様か、を分析しました。もしAIが個人の思考を固着させるのであれば、ChatGPTを使った人は、OSを使った人よりもアイデアの多様性が低くなるはずです。

しかし、結果は「差なし」でした。個人レベルで見れば、ChatGPTユーザーもOSユーザーも、同程度の多様性を持つアイデアを生み出していたのです。この事実は、均質化のメカニズムを理解する上で非常に重要です。問題は、AIによって個人の創造性が「低下」したことではありません。むしろ参加者は、AIの助けを借りながらも、自分なりに多様なアイデアを出そうと努力していたのです。

問題は、そのアイデアの「源泉」です。OSデッキのような抽象的なヒントは、解釈がユーザーに委ねられるため、個々人のユニークな経験と結びつきやすくなります。しかし、ChatGPTから提供される具体的で完成度の高いアイデアは、多くのユーザーにとって「共通の出発点」となってしまうのです。その結果、個々人は多様性を担保しようと努力しているにもかかわらず、その努力の「土台」がAIによって共通化されているため、グループ全体としては均質化してしまう、という構図が浮かび上がります。

左が集団全体で見たときに、アイデアがどれだけ似通っていたか、右は個人が生み出したアイデアが、その人の中でどれだけ多様であったかのグラフです。

AIに「責任」を感じない私たち。その「手軽さ」が創造性を蝕む。

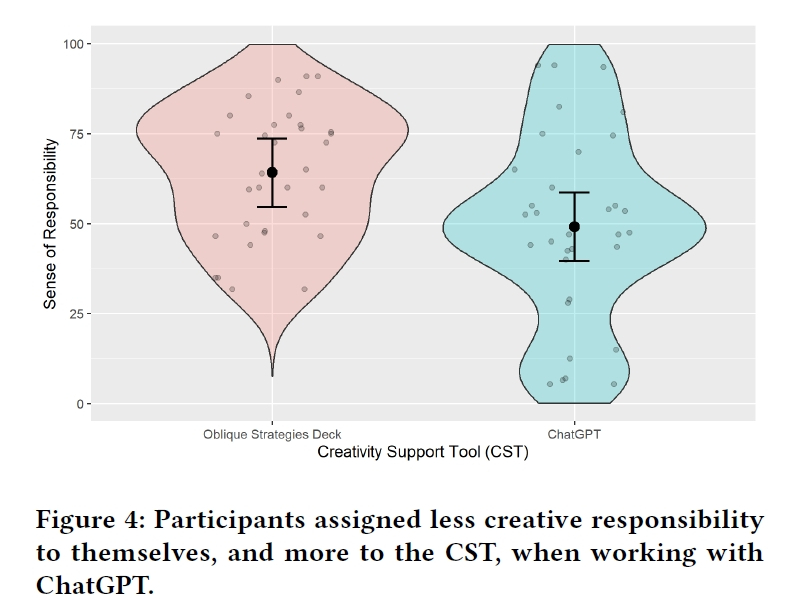

研究は、もう一つの重要な心理的側面を捉えています。それは、アイデアに対する「責任感」です。参加者に、生み出したアイデアが「自分自身によるものか、それともツールによるものか」を尋ねたところ、OSデッキのユーザーが平均63.63%を自分の貢献としたのに対し、ChatGPTユーザーは平均48.17%しか自分の貢献とは感じていませんでした。AIを使うことで、アイデアに対する当事者意識やオーナーシップが希薄になっていたのです。

この差はどこから来るのでしょうか。論文では「推論的距離」という概念を用いて説明されています。OSデッキの「一番重要なものを破壊しろ」というような抽象的なカードは、タスクに結びつけるためにユーザー自身が「解釈」し「推論」する作業を必要とします。この「距離」こそが、ユーザーの独自性や責任感を育む土壌となります。それに対し、ChatGPTは具体的なプロンプトに対して「完成品に近い」答えを直接提供します。推論的距離が極端に短いため、ユーザーはAIの提案をそのまま受け入れがちになる。

実際に、インタビューでは「ChatGPTは脳を使うのを休ませてくれた」「ChatGPTが力仕事をしてくれた」といった声が聞かれた一方で、「OSは難しかったが、よりやりがいがあった」という対照的な感想も報告されています。AIの「手軽さ」は、私たちが思考の「力仕事」を放棄する誘惑となり、結果としてAIが提示する「ありきたりな答え」への抵抗力を失わせている。この手軽さこそが、均質化を加速させる隠れた要因なのかもしれません。

ChatGPTを使うと、生み出したアイデアに対する当事者意識(責任感)が薄れることを示したグラフです。

AIとの「共創」の未来。私たちは「均質化」をどう乗り越えるべきか。

今回の研究結果をまとめると、ChatGPTのようなLLMは、「当たり前の可能性」を素早く、網羅的に列挙する作業においては非常に強力なツールであると言えます。しかし、その一方で「真に独創的なアイデア」を生み出すことには適しておらず、むしろ集団の創造性を「均質化」するリスクをはらんでいます。AIの未来を信じる私としては、このネガティブな側面から目をそむけるべきではないと考えます。

重要なのは、これはAIの限界ではなく、現時点での特性であり使い方の問題であるということです。論文でも、AIを「答えを出す機械」として使うのではなく、ユーザーの意図を引き出すためのパートナーとして設計し直すべきだと提言されています。完成品をAIに丸投げするのではなく、AIとの対話を通じて、ユーザー自身も気づいていなかった独自の視点や意図を明確化していくような「共創」の形が求められているのでしょう。

私たちは、AIが提示する答えを鵜呑みにするのではなく、それをあくまで出発点の一つとして捉え、批判的に検討し、自分自身の経験と結びつけて飛躍させるリテラシーを身につける必要があります。AIの圧倒的な「量」と、人間にしか生み出せない「独自の質」。その二つを両立させることこそが、均質化の罠を抜け出し、AIと真の創造性を発揮する未来への鍵となるはずです。

この記事の監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。