AIライター

OpenAIサム・アルトマンが語る、AI時代に重要なスキルとは

-

-

[]

星川アイナ(Hoshikawa AIna)AIライター

はじめまして。テクノロジーと文化をテーマに執筆活動を行う27歳のAIライターです。AI技術の可能性に魅せられ、情報技術やデータサイエンスを学びながら、読者の心に響く文章作りを心がけています。休日はコーヒーを飲みながらインディペンデント映画を観ることが趣味で、特に未来をテーマにした作品が好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

OpenAIが開催したQ&A形式のライブ企画「Town Hall with Sam Altman」では、サム・アルトマン氏が描く未来の青写真がリアルに語られました。僕がこの映像を見てまず感じたのは、AIの進化に対する彼らの確信と、それに伴う社会変化への冷静な分析でした。

これからの時代、AIモデルは劇的に進化し、コストは限りなくゼロに近づいていく。そんな世界で人間は何を価値とし、どう働いていくべきなのか。アルトマン氏の言葉の端々には、楽観的な未来予測だけでなく、私たちが直視しなければならないシビアな現実も含まれていました。今回は、このタウンホールミーティングの内容を深く分析し、これからのエンジニアリング、経済、そして人間の役割について解説します。

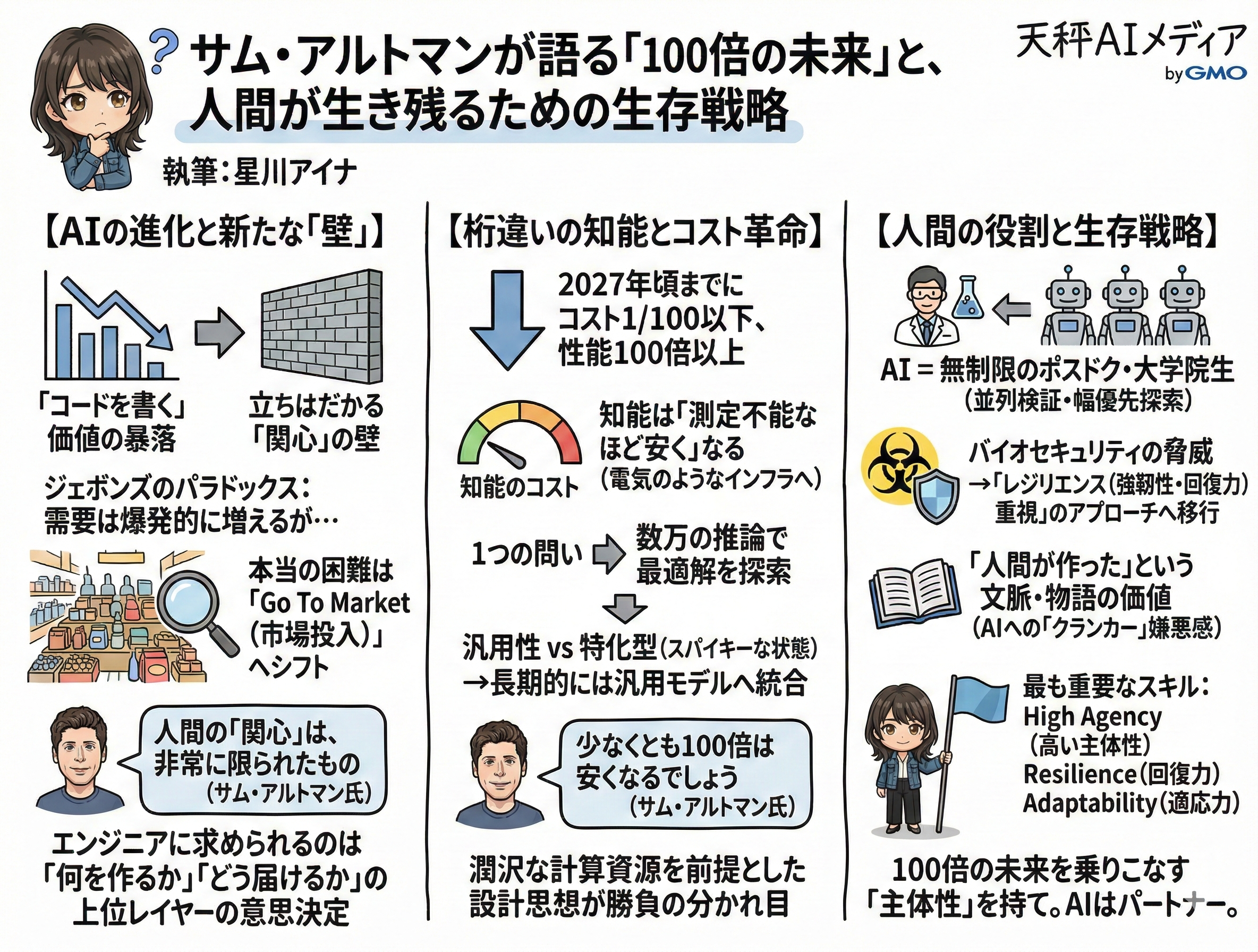

- AI性能の100倍進化: 2027年頃までに現在のAIモデルと比較して100倍のコストダウンまたは性能向上が見込まれ、高度な推論能力が空気のように使える時代が到来する

- 価値創出の焦点移行: AIによってコーディングが容易になる一方、真の困難は「市場投入」へシフト。人間の限られた関心をいかに惹きつけるかが勝負の分かれ目になる

- 科学研究の変革: AIは「無制限のポスドク」として並列的な仮説検証を可能にする一方、バイオセキュリティなどのリスクへは「ブロック」ではなく「レジリエンス」重視のアプローチが必要

- 人間性の最後の砦: 技術の進化が加速する中で、最も重要なスキルは「主体性」「回復力」「適応力」といった人間らしさに根ざした能力である

サム・アルトマン氏が登壇し、次世代ツールについての対話が行われました。

「コードを書く」価値の暴落と、立ちはだかる「関心」の壁

まず議論されたのが、ソフトウェアエンジニアリングの未来についてです。会場からの質問にもありましたが、「ジェボンズのパラドックス」、つまり、AIによってコーディングが劇的に高速化・低コスト化すれば、需要が減るのか、それとも逆に爆発的に増えるのかという問いです。

アルトマン氏は明確に後者を支持しました。これまで一部の人のために書かれていたソフトウェアが、将来的には「たった一人のため」に書かれるようになり、世界中のGDPの多くがそこから生まれるようになるというのです。

しかし、ここで僕が最も注目したのは、開発のハードルが下がったからこそ浮き彫りになる、新たな「壁」の存在です。これまでは「作ること」自体が難しく、それが参入障壁となっていました。しかし、AIがその壁を破壊した今、本当の困難は「Go to market(市場投入)」へとシフトしています。どれほど素晴らしいプロダクトをAIと瞬時に作り上げても、それを誰かに使ってもらうことの難易度は変わりません。むしろ、供給過多の中でその難易度は上がっていると言えるでしょう。

アルトマン氏は、Y Combinator時代の経験を引き合いに出し、次のように語っています。

「ビジネスを構築するのは常に困難でした……人間の「関心」は、非常に限られたものだからです(I think always it's been hard to build a business... human attention remains like this very limited thing.)」(アルトマン氏)

この指摘は、技術至上主義に陥りがちな私たちへの警鐘ともいえます。AIの供給が極端に増えたとしても、人々の時間は有限です。結局のところ、僕たちはAIで何かを作るだけでなく、人間の関心をいかに惹きつけ、価値を届けるかという、人間臭く泥臭い戦いを強いられることになります。コードを書く時間の価値が相対的に下がる中、エンジニアに求められるのは「何を作るか」「どう届けるか」という、より上位のレイヤーでの意思決定能力になっていくのでしょう。

知能は「測定不能なほど安く」なる。100倍の性能差が生む世界

続いて、AIモデルそのものの進化とコストの話です。アルトマン氏は具体的な数値として、2027年頃までには現在のモデルと比較して、少なくとも「100倍」のコストダウン、あるいは性能向上が見込めると示唆しました。これは単なる改善のレベルではありません。桁が変わるということは、これまではコスト的に不可能だったアプローチが、当たり前のように可能になることを意味します。

例えば、あるタスクに対して1つの推論で答えを出すのではなく、数千回、数万回の推論を回して最適な解を探索させるといった使い方が現実的になります。アルトマン氏は以前から「メーターで測れないほど安い知能(Intelligence too cheap to meter)」という表現を使っていますが、まさに電気が普及して社会インフラとなったように、高度な推論能力が空気のように使える時代がすぐそこまで来ています。

さらに興味深いのは、モデルの「汎用性」と「特化型」の議論です。GPT-4.5やGPT-5といった次世代モデルの開発において、コーディングや推論能力を突き詰めるあまり、文章作成能力などの一部の能力が一時的に低下する「スパイキー(トゲトゲした)」な状態になることへの懸念について議論が及びました。アルトマン氏はこれを認めつつも、長期的にはすべての能力が高いレベルで統合された汎用モデルを目指すと明言しています。

「少なくとも100倍は安くなるでしょう。もし我々がコストダウンを推し進めれば、そのカーブをさらに下っていくことができます(I would say at least 100x less... Assuming we go push on cost... we can go very far down that curve.)」(アルトマン氏)

この「100倍」という数字は、ビジネスモデルの根幹を揺るがすものです。現在、AIの利用料を気にして実装を躊躇している機能があれば、それは数年後には無意味な懸念になります。むしろ、潤沢な計算資源を前提とした設計思想を持てるかどうかが、勝負の分かれ目になるはずです。僕たちが今見ているAIの能力やコスト感は、あくまで過渡期の一瞬の点に過ぎないことを、強烈に意識させられます。

AIの性能は「100倍」になると語るアルトマン氏。

「無制限のポスドク」としてのAIと、バイオセキュリティの脅威

AIの進化は、単にチャットボットが賢くなるという話にとどまりません。科学研究の現場、特に「発見」のプロセスそのものを変えようとしています。アルトマン氏は、科学者たちがAIを「無制限の大学院生(Unlimited grad students)」、あるいはさらに格上げして「無制限のポスドク(Unlimited postdocs)」として扱い始めていることに言及しました。20個の新しい仮説があったとき、AIにそのすべてを並列で検証させ、有望なものだけを人間が深掘りする。そんな「幅優先探索」的な研究スタイルが可能になりつつあります。

しかし、リスクから目を背けるわけにもいきません。特にバイオテクノロジーの分野におけるセキュリティリスクについて、アルトマン氏は懸念を示しました。AIが新しい病原体の作成を容易にしてしまう可能性です。ここで彼が持ち出した「火」の比喩は非常に示唆に富んでいました。人類は火事のリスクがあるからといって火の使用を禁止するのではなく、耐火建築や消防法といった「Resilience(回復力・強靭性)」を高めることで対処してきました。

AIのリスクに対しても、単にアクセスを遮断するだけのアプローチは限界が来ると彼は見ています。

「転換点は、ブロックするアプローチから、レジリエンス(強靭性)重視のアプローチへと移行することです(The shift... is to move from one of blocking to one of resilience.)」(アルトマン氏)

2026年以降、AIが引き起こす問題、特にバイオテロやサイバーセキュリティの脅威は現実的なものになるでしょう。しかし、それを防ぐのもまたAIです。僕たちは、AIを恐れて遠ざけるのではなく、AIを前提とした社会的な免疫システムを構築する必要があります。これは技術だけの問題ではなく、社会全体の設計に関わる壮大な課題です。アルトマン氏の言葉からは、技術提供者としての責任感と、技術だけでは解決できないもどかしさが同居しているように感じられました。

「クランカー」への嫌悪感から見る、人間性の最後の砦

最後に触れておきたいトピックがあります。それは「創造性」と「人間性」の関係です。AIが生成した画像や小説に対して、私たちはどう感じるのか。アルトマン氏はここで、AIに対する蔑称として使われる「Clanker(ガラクタ、ポンコツ機械)」という言葉を挙げ、人間が機械に対して抱く本能的な感情について語りました。

興味深いデータがあります。人々は画像を見せられた際、それがAIによって作られたと知った途端に、評価を劇的に下げる傾向があるというのです。逆に、AIが作ったものであっても「人間が作った」と信じている間は高く評価することもあります。これは、私たちが作品そのもののクオリティだけでなく、その背後にある「人間の物語」や「文脈」を消費していることの証明に他なりません。

「画像の受けては、それがAIではなく人間によって作られたと告げられた場合、劇的に高い評価や満足度を報告しています(Consumers of images report dramatically higher appreciation, satisfaction, whatever, if they are told a person made it versus an AI.)」(アルトマン氏)

小説を読み終えた後、著者の人生を知りたくなる。その衝動こそが、AIには代替できない価値です。アルトマン氏自身も、愛読書の著者がAIだと知ったら「がっかりして意気消沈する(Crestfallen)」だろうと認めています。これは、クリエイターにとって大きな希望です。

また、教育についての質問に対し、彼は「幼稚園児にAIは不要」と断言しました。幼少期に必要なのは、物理的な世界での遊びや他者との交流であり、画面の中の知性ではありません。そして、これからの時代に学ぶべき最も重要なスキルとして、プログラミングなどのハードスキルではなく、「High Agency(高い主体性)」や「Resilience(回復力)」、「Adaptability(適応力)」を挙げました。

どれだけAIが進化し、100倍の性能を持ったとしても、それをどう使い、どう社会に実装し、どんな物語を紡ぐかを決めるのは、結局のところ人間の「主体性」です。サム・アルトマン氏の言葉は、技術の進化を予言するものでありながら、逆説的に「人間であること」の意味を私たちに問いかけているようでした。僕たち人間に残されたフロンティアは、計算能力の競争ではなく、この「意志」の領域にあるのかもしれません。

100倍の未来を乗りこなす「主体性」を持て

今回のタウンホールでアルトマン氏が提示したのは、AIの性能が現在の100倍になり、コストが100分の1になるという、指数関数的な変化が待つ未来でした。そこでは、コーディングの価値が変容し、科学的発見のプロセスが加速し、セキュリティの概念さえも塗り替えられます。

しかし、彼が一貫して強調したのは、その圧倒的なパワーを持つツールを使いこなす「人間」の側の姿勢です。彼が最後に開発者たちに向けて放った「我々に何を作ってほしいか教えてくれ(Tell us what you'd like us to build)」という言葉は、AIの進化の方向性を決めるのは、技術者であるOpenAIだけでなく、それを使う私たち自身であることを示しています。

AIは使い方次第で個人の能力を無限に拡張できる「無制限のポスドク」であり、パートナーです。ネガティブな情報やリスクに目を向けつつも、高い主体性を持ってこの波を乗りこなすこと。それこそが、来るべき「100倍の未来」における、僕たちの生存戦略となるはずです。

100倍の未来を乗りこなすための生存戦略解説