AIライター

プロンプトを工夫しても意味がない?MIT・マイクロソフトの研究でわかった生成AIの使い方の正解

-

-

[]

アイサカ創太(AIsaka Souta)AIライター

こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

「AIが新しくなったら、それだけで結果も良くなるんじゃないの?」——そう思っている人は多いかもしれません。

2026年1月7日、マサチューセッツ工科大学(MIT)、マイクロソフトリサーチ、スタンフォード大学などの研究チームが、その問いに真正面から答える論文を発表しました。タイトルは「Prompt Adaptation as a Dynamic Complement in Generative AI Systems」。日本語に訳すと「生成AIシステムにおいて"動的補完"として機能するプロンプト適応」です。

簡単に言うと、「AIが進化したとき、人間側の使い方(プロンプト)の変化がどれだけ結果に影響するか」を大規模な実験で調べた研究です。

参加者3,750人、集められたプロンプト(AIへの指示文)の数は約3万7,000件。その膨大なデータから見えてきたのは、「タスクの種類によって、人間の工夫が効く場面と効かない場面がはっきり分かれる」という驚きの事実でした。

さっそく、その中身を見ていきましょう。

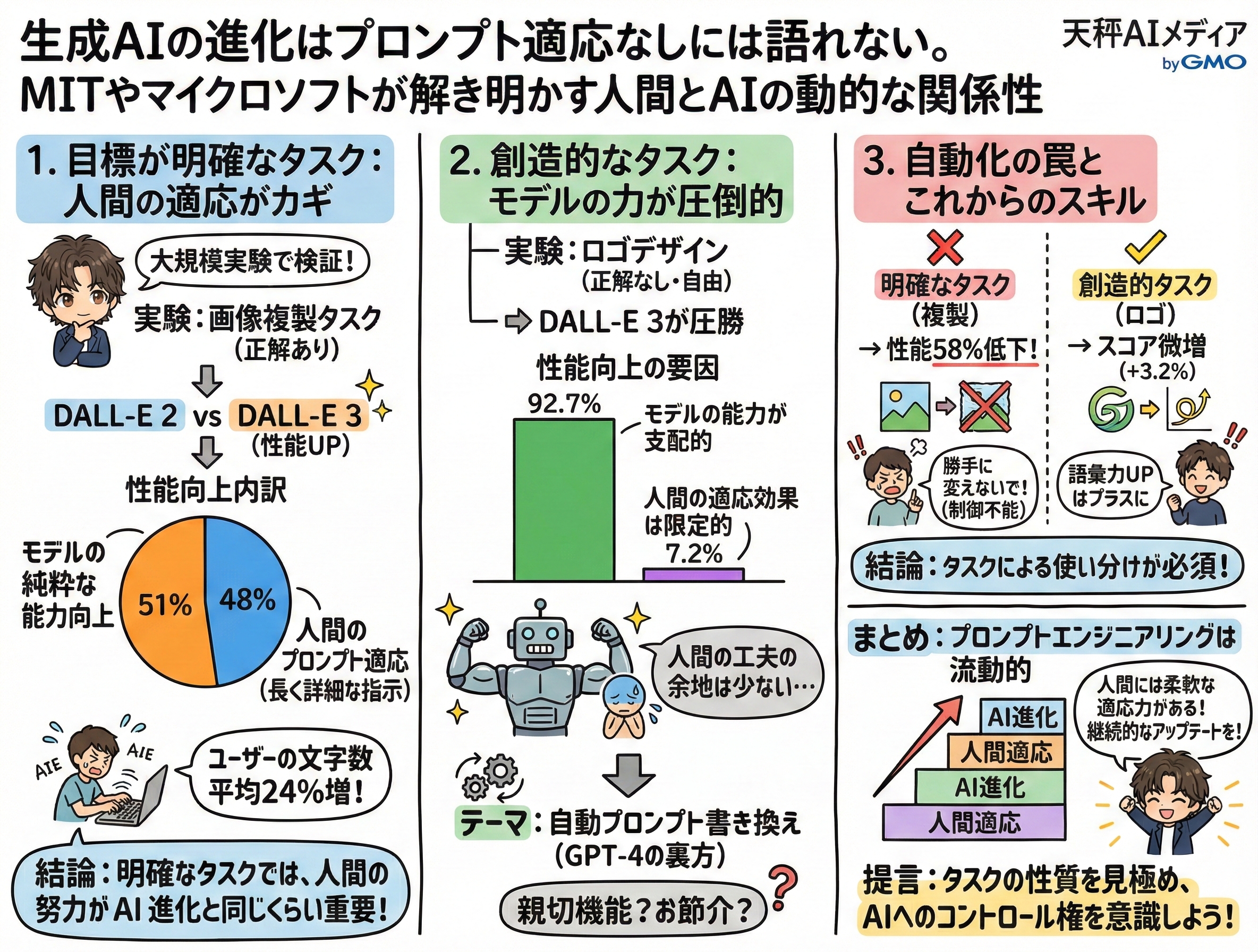

- プロンプト適応の貢献度: 目標が明確なタスクでは、AIモデルの性能向上のうち約48%がユーザーのプロンプト工夫によるもの。人間の使い方が結果を大きく左右する。

- 創造的タスクはモデル能力が支配的: 正解のない自由なタスクでは、性能向上の92.7%がモデル自身の能力によるもの。プロンプトを工夫しても効果はわずか7.2%。

- 自動書き換え機能の落とし穴: DALL-E 3のGPT-4による自動書き換えは、目標が明確なタスクでは性能向上幅の約58%を逆に打ち消してしまう場合がある。

- プロンプトの工夫は「一生モノのスキル」ではない: AIが進化するたびに使い方を更新し続ける必要がある「流動的なスキル」。

目標が明確なタスクでは、人間の工夫が大きく効く

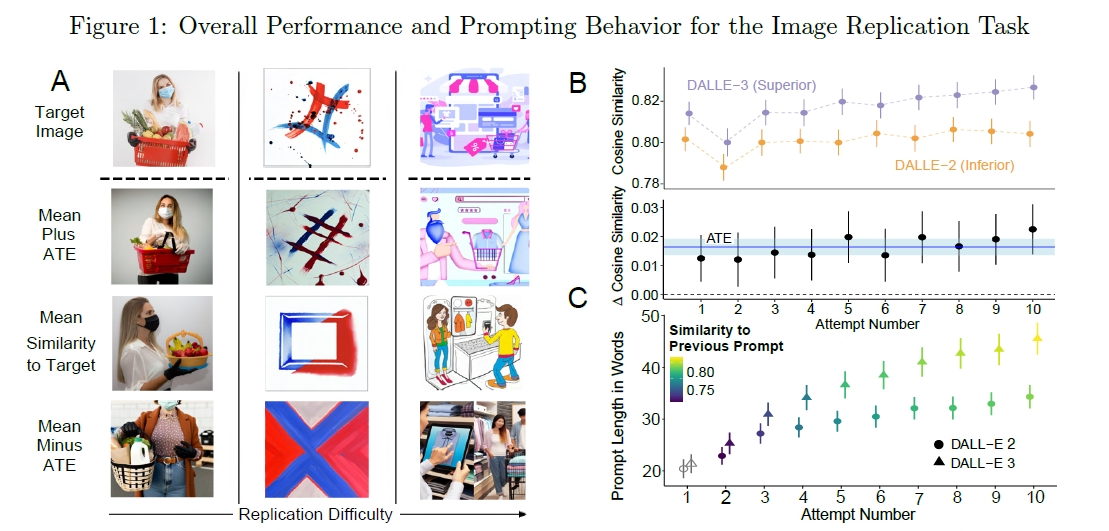

最初の実験はとてもわかりやすい設定です。参加者は「お手本の画像と同じ画像を、AIを使って作ってください」と言われました。

使ったAIは2種類。古いバージョンのDALL-E 2と、より賢い新バージョンのDALL-E 3です。参加者は25分の時間内に最低10回、AIに指示(プロンプト)を送りながら、お手本に近い画像を作ろうと試行錯誤しました。

結果として、DALL-E 3を使ったグループの方が明らかに良いスコアを出しました。これは予想通りです。でも、ここで研究チームは「その点数アップのうち、どれくらいがAI自身の進化によるもので、どれくらいが人間の工夫によるものか?」という、さらに深い問いを立てたのです。

旧バージョン(DALL-E 2)のユーザーが書いた指示文をそのまま新バージョン(DALL-E 3)に入力し直す実験です。これによって「AIが新しくなっただけで、どれだけ結果が変わるか」を純粋に測ることができます。

その結果が驚きでした。AIモデル自体の進化による効果は、スコアアップ全体のたった51%だったのです。

残りの48%は、ユーザーが「DALL-E 3はより細かい指示を理解してくれる」と気づき、指示文を長く・詳しく書くように変えていった結果でした。実際、DALL-E 3のユーザーはDALL-E 2のユーザーより、平均で24%長いプロンプトを書いていたことが確認されています。

つまり、「AIが新しくなっても、使い方を変えなければ半分の恩恵しか受け取れない」ということです。

※ 51%と48%の合計が100%にならないのは、それぞれ別の統計モデルで推計しているためです。

ターゲット画像に対するコサイン類似度の推移やプロンプトの長さの違いを示す詳細なデータグラフ

「自由なデザイン」の作業では、ほぼAI任せでOK

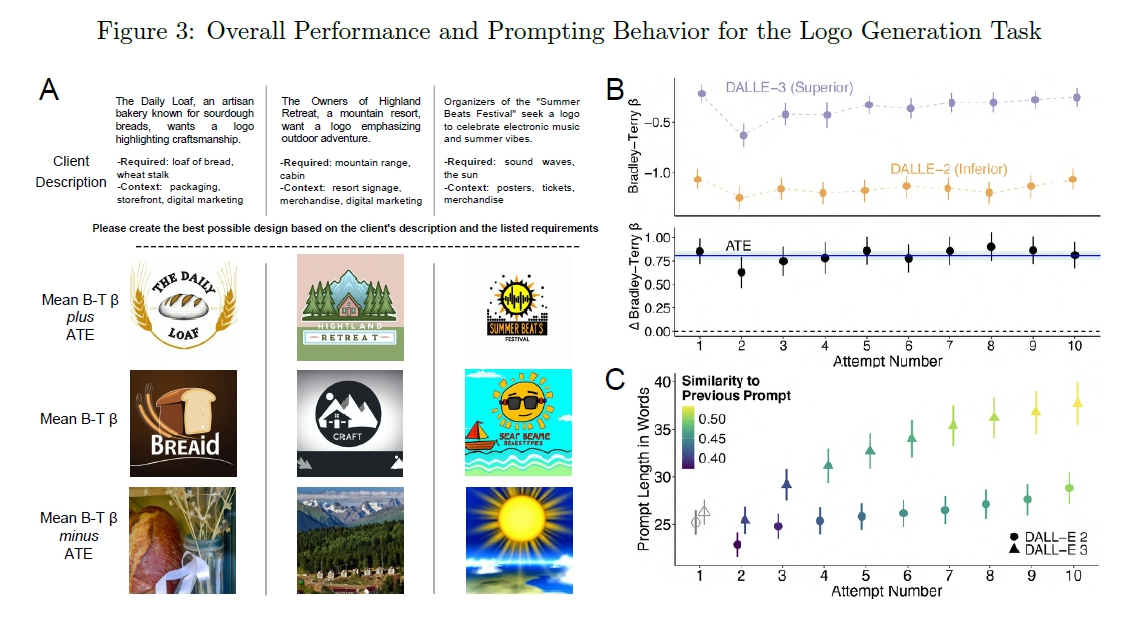

では、「正解がない」タスクではどうなるのでしょうか。

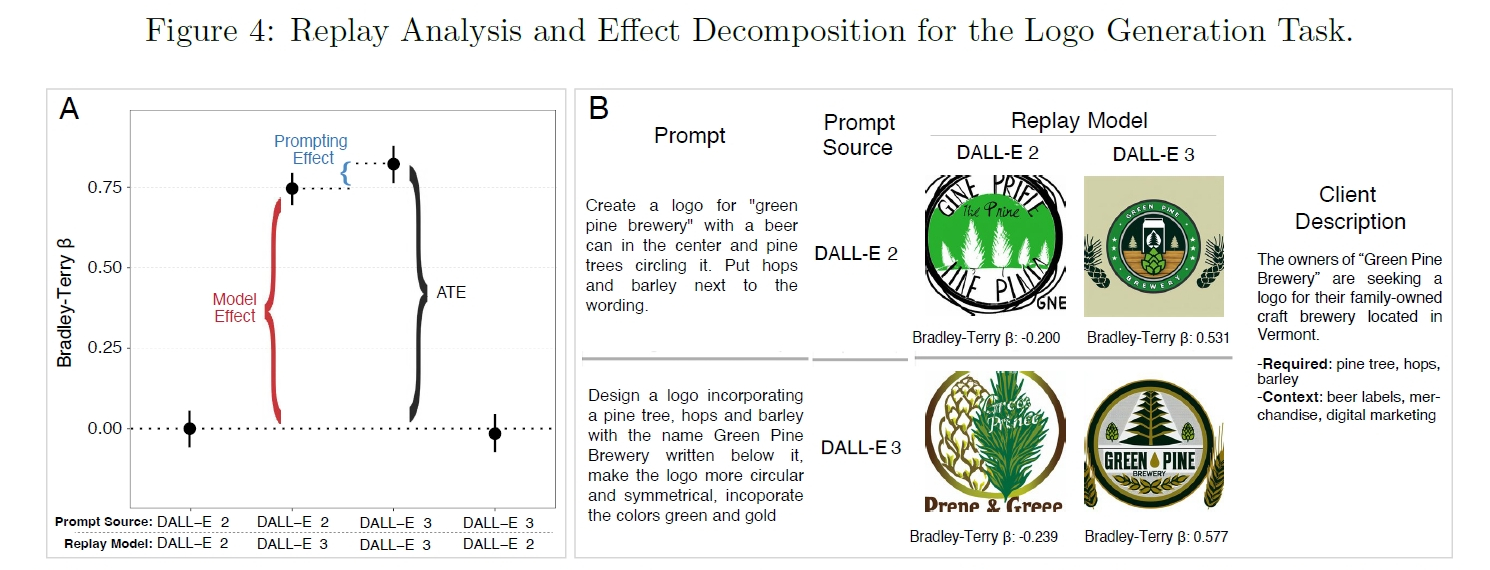

研究チームは次の実験として、架空の組織のロゴを作るタスクを用意しました。「緑の松とホップを描いてほしい」という短い指示だけ渡されて、あとは自由にロゴを作る、というものです。お手本画像はありません。

ここでも DALL-E 3 の方が圧倒的に良い結果を出しました。しかしその「点数アップの内訳」を見ると、衝撃的な数字が出てきます。

・AIモデル自身の能力アップによる効果:92.7%

・ユーザーがプロンプトを工夫したことによる効果:わずか7.2%

ユーザーはこの実験でも一生懸命工夫していました。DALL-E 2のときより平均24.7%長いプロンプトを書いていたのです。それでも結果への貢献はわずか7.2%。

ロゴデザインのような「何が良いかは人によって違う」タスクでは、プロンプトを頑張って工夫するより、より強力なAIモデルを使う方がはるかに効果的だということが数字で証明されました。

AIの進化を喜ぶ一方で、「人間の工夫が入り込む余地がこんなに少ないのか」と、少し恐ろしさも感じてしまいますね。

架空の組織のロゴ作成におけるモデル間の圧倒的なパフォーマンス差を示すグラフと生成画像の例

「自動でいい感じにしてくれる機能」が逆効果になることも

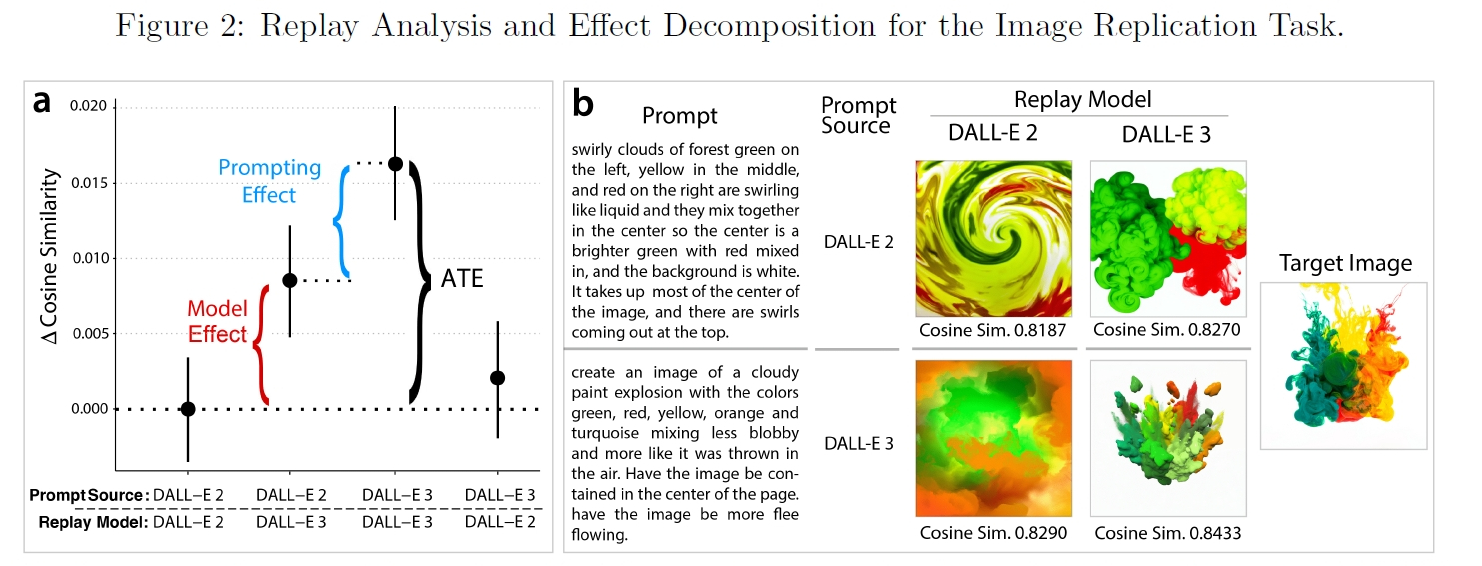

研究が取り上げたもう一つの面白いテーマが、AIによるプロンプトの自動書き換えです。

実は、DALL-E 3をプログラム経由(API)で使うとき、デフォルトでGPT-4が裏側で動いています。ユーザーが短い指示を入力すると、GPT-4が自動的にそれを長く詳しい文章に書き直してから、DALL-E 3に渡す仕組みです。「ユーザーが頑張らなくても、AIが自動で良い指示文を作ってくれる」という、一見便利な機能です。

ところが、これが必ずしも良い結果を生むわけではありませんでした。

「お手本の画像を正確に再現する」という目標が明確なタスクでは、自動書き換え機能を使ったグループの方が、DALL-E 3本来の性能向上のうち約58%を無駄にしてしまったのです。

理由はシンプルです。「この色をここに配置して、このバランスで」と細かくコントロールしたいとき、間に入ったGPT-4が"良かれと思って"表現を変えてしまうと、ユーザーの意図が歪んでしまいます。

一方、自由なロゴデザインのタスクでは逆の結果が出ました。自動書き換えを使ったグループの方が、スコアが3.2%だけ高かったのです。「正解が決まっていない、表現の豊かさが求められる」場面では、GPT-4の語彙力が良い方向に働いたのだと考えられます。

この結果から言えるのは、「自動最適化=いつでも便利」ではないということです。

AIを使うとき、自分がやろうとしていることが「正確さが必要なタスク」なのか「自由な発想が求められるタスク」なのかを意識することが、思った以上に大切なのです。

プロンプト適応の効果とモデル自身の効果を切り分けて分析したリプレイ検証の詳細データ

AIが新しくなるたびに、人間も「使い方」をアップデートする必要がある

この研究が伝えたいメッセージの核心は、「プロンプトの工夫は"動的な補完"だ」ということです。

少しわかりにくい言葉なので、かみ砕いて言うとこうなります。

スマートフォンのOSが新しくなっても、操作に慣れないうちはその恩恵を半分しか受け取れないのと似ています。新しいAIが来るたびに、その特性を理解して自分の使い方を更新していく作業が、最大限の成果を引き出すカギになる、ということです。

特に「正確さが求められる仕事」——たとえば、特定のフォーマットで資料を作る、決まった条件で画像を生成するといった業務では、この適応を怠ると大きな機会損失になります。論文のデータが示す通り、新モデルが持つポテンシャルの約半分は、人間が使い方を変えることで初めて引き出せるからです。

プロンプトエンジニアリング(AIへの指示の書き方を工夫するスキル)は、一度覚えれば終わりの固定スキルではありません。AIが進化するたびに学び直す、生き続けるスキルなのです。

ただ、ポジティブなニュースもあります。今回の実験に参加した3,750人は、プロのAIエンジニアではなく一般の人たちでした。それでも彼らは、25分という短い時間の中で自然に「DALL-E 3には長くて詳しい指示が効く」と気づき、プロンプトを変化させていったのです。

人間には、新しいツールに素早く適応する力が備わっています。AIを怖がるだけでなく、「道具として使いこなそう」という姿勢さえあれば、誰でも十分に適応できる——そんな希望も、このデータは示しています。

ロゴ作成タスクにおいてモデル自身の効果がいかに支配的であるかを示すリプレイ分析のグラフ

この研究が教えてくれる最大の教訓は、「どんなタスクをしているかを意識してAIを使う」ことの大切さです。

- 正確さが求められる作業(例:特定の画像の再現、決まった形式での資料作成)では、AIに頼り切らず自分でプロンプトを磨き続けることが大切。AIの性能向上の約半分は、人間の工夫によって初めて引き出せる。

- 自由な発想が求められる作業(例:ロゴデザイン、アイデア出し)では、より高性能なモデルを選ぶことが最大の近道。プロンプトをこねくり回すより、良いモデルを使う方が効果的な場面も多い。

- AIの自動書き換え・自動最適化機能が、自分のやりたいことに合っているかどうかを確認する習慣をつけよう。「お任せ=最適」とは限らない。

この記事のまとめ