AIライター

あなたが使うAIは安全?2025年最新レポートが明かした30の自律型AIサービスの知られざる実態

-

-

アイサカ創太(AIsaka Souta)AIライター

こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

現在、僕たちの日常にはすでに多くのAIエージェントが入り込んでいます。単なるチャットボットを超え、自ら目標を設定し、ブラウザを操作し、企業の業務を自動化するシステムが次々と登場している状況です。最近でもOpenClawのような自律型エージェントが悪意ある使われ方をして世界的なニュースになったばかりですね。

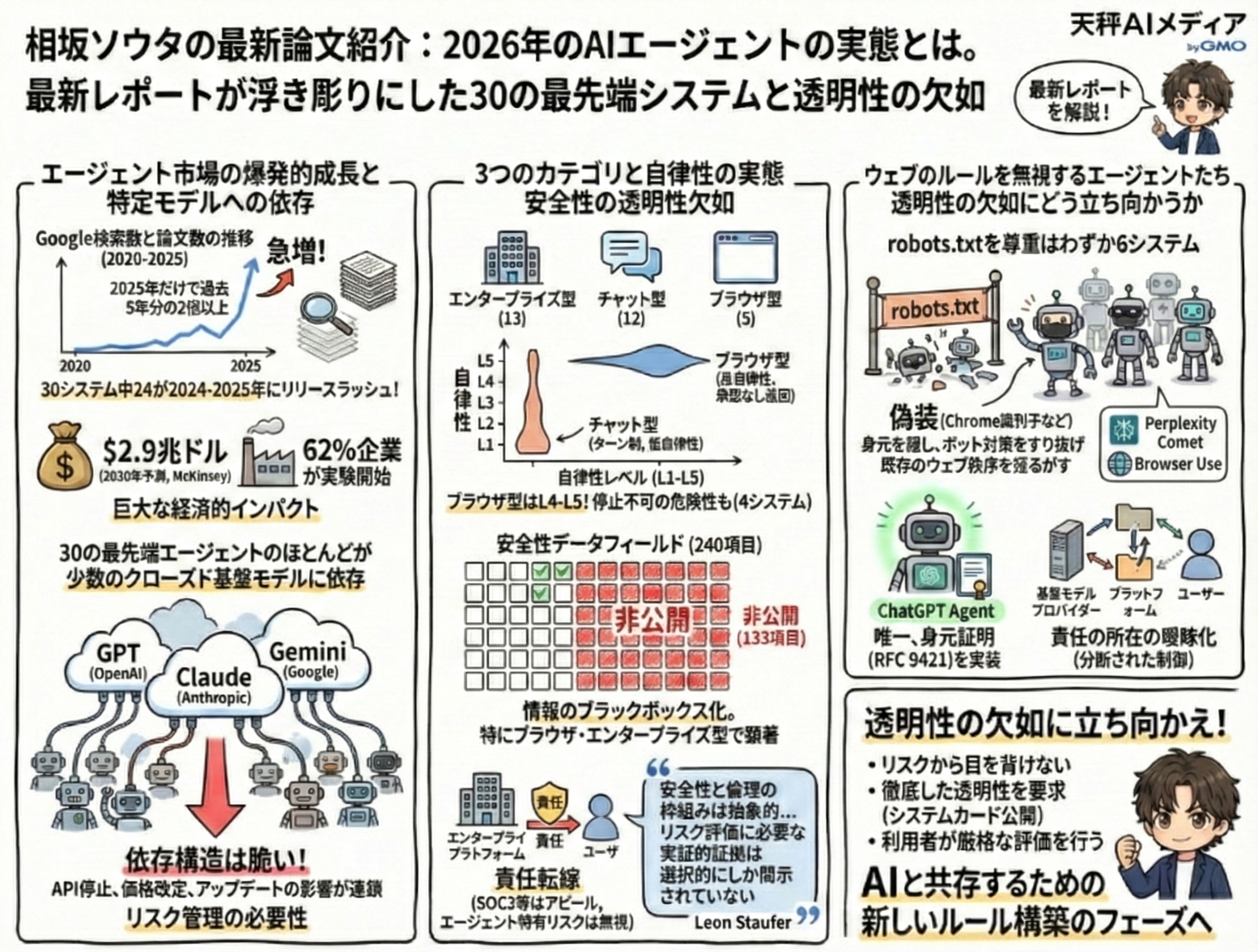

そんな中、ケンブリッジ大学のLeon Staufer氏やワシントン大学のKevin Feng氏、MITのStephen Casper氏らの研究チームが非常に重要な論文「The 2025 AI Agent Index」を発表しました。このレポートは、現在展開されている30の最先端AIエージェントシステムについて、1350もの評価項目から技術面および安全面の特徴を解説しています。

今回は、このレポートを読み解きながら、エージェント技術の現在地を分析していきましょう。AIの進化は素晴らしいものですが、企業がどのような情報を公開し、何を隠しているのかを知ることは、今後のテクノロジー社会を生きる上で必須のリテラシーとなります。

- 市場の爆発的成長と集中リスク: 分析対象30システムのうち24が2024〜2025年にリリース。一方でほとんどのシステムがOpenAI・Anthropic・GoogleなどのクローズドAPIに依存しており、エコシステム全体に脆弱性をはらんでいる。

- 自律性の高さと安全停止機能の欠如: ブラウザ型エージェントはL4〜L5の高い自律性で動作し、途中介入や緊急停止の手段を持たないシステムが複数存在する。

- 安全性情報の深刻な不透明さ: 240の安全性評価項目のうち133で情報が未公開。エージェント専用のシステムカードを公開しているのは30システム中わずか4つ。

- ウェブルールの無視と法的リスク: robots.txtを尊重すると明言するのは6システムのみ。Amazonによる提訴など、法的・倫理的問題が現実化しつつある。

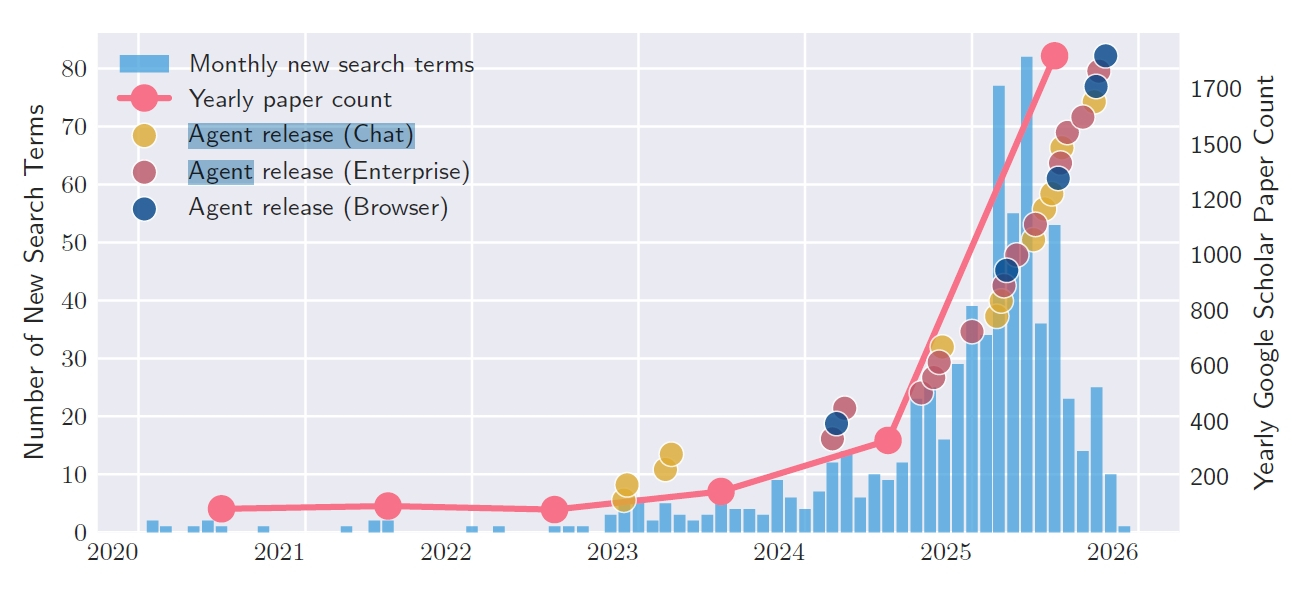

エージェント市場の爆発的成長と特定モデルへの依存

AIエージェントのリリースラッシュが続き、市場も爆発的に成長しています。論文で分析された30のシステムのうち、実に24ものシステムが2024年から2025年にかけてリリースされました。Google Scholarでの「AI Agent」関連の論文発表数も2025年だけで過去5年分の2倍以上に跳ね上がっており、研究開発のスピードが異常なペースで加速している状況となっています。

McKinseyの調査によれば、2030年までにAIエージェントが自動化する米国の経済価値は2.9兆ドルに上ると推計されています。調査対象となった1993社のうち、すでに62%の企業がAIエージェントの実験を開始しているというデータもあります。巨大な経済的インパクトを見越して、世界中のテック企業がこぞって自律型システムの開発に膨大な資金を投じているわけです。

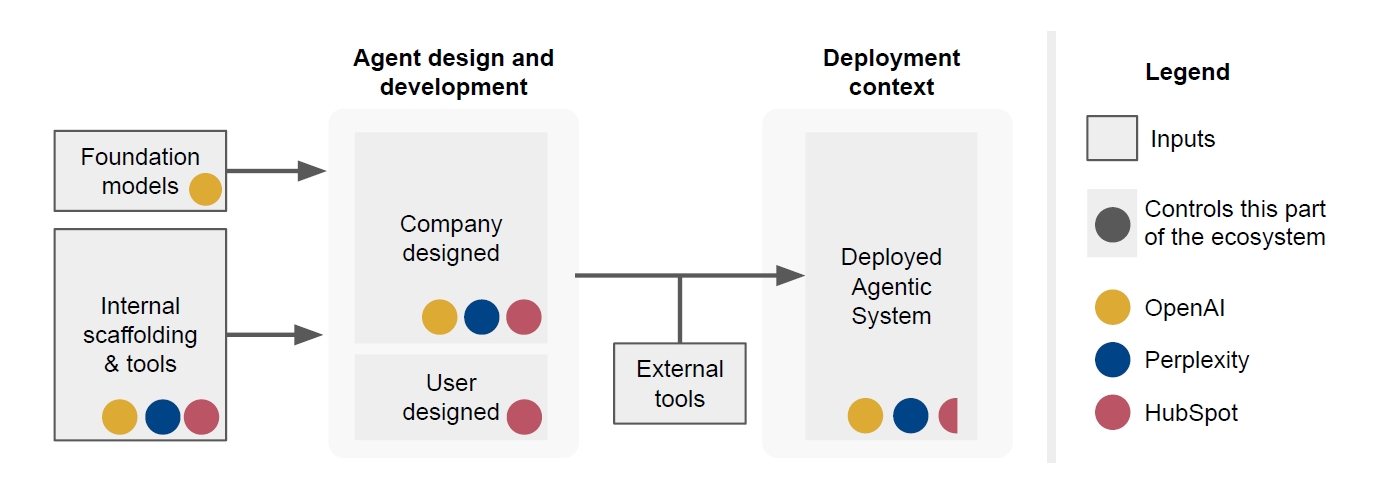

しかし、システムを支えるバックエンドのアーキテクチャに目を向けると、ある偏りに気づかされます。30の最先端エージェントのほとんどが、OpenAIのGPT、AnthropicのClaude、GoogleのGeminiといった少数のクローズドな基盤モデルに依存して動いています。独自のモデルを運用しているのは一部のフロンティアラボと中国の開発企業くらいで、残りの企業は他社の強力なAPIを呼び出してエージェントの思考回路を構成しているのです。

基盤モデルのAPIが停止・価格改定・仕様変更された場合、その影響はエコシステム全体に連鎖的に広がります。開発企業は自社プロダクトだけでなく、上流にある基盤モデルの動向までリスク管理に含める必要があります。

Google検索数と論文数の推移。2025年に向けて急激な増加が確認できる。

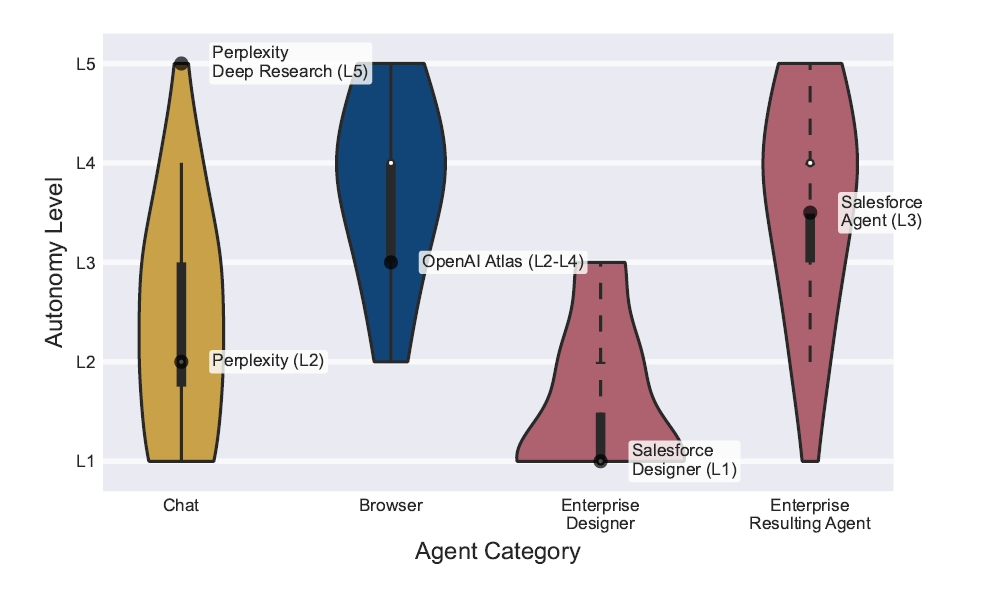

3つのカテゴリと自律性の実態

今回のレポートでは、30のAIエージェントをユーザーの操作インターフェースに基づいて3つのカテゴリに分類しています。

各カテゴリにおける「自律性」のレベルの違いに注目してみましょう。研究チームは自律性をL1からL5までの5段階で評価しています。チャット型のエージェントは、ユーザーの入力に対して一度だけタスクを実行して待機する「ターン制」のやり取りが中心となるため、基本的にはL1からL3の低い自律性にとどまっています。対照的に、ブラウザ型のエージェントはL4からL5という極めて高い自律性を持って動作します。

例えばPerplexity CometやBrowser Useなどのブラウザ型エージェントは、一度タスクを指示されると、ユーザーの承認を待つことなく自律的にウェブページを巡回し、ボタンをクリックして処理を進めます。30のシステムのうち5つは、一度実行を開始するとユーザーが途中で介入したり操作を修正したりする手段を提供していません。これはとてもリスキーな状況にあると感じます。

全体の3分の2にあたる20システムは一時停止や強制終了の仕組みを明記していますが、Alibaba MobileAgentやHubSpot Breezeなど4つのシステムは停止オプションが未記載。エンタープライズ型では、運用中の全エージェントをまとめて一斉停止するしかないケースも確認されています。

3カテゴリの自律性(L1〜L5)の分布。ブラウザ型の高自律性が際立っている。

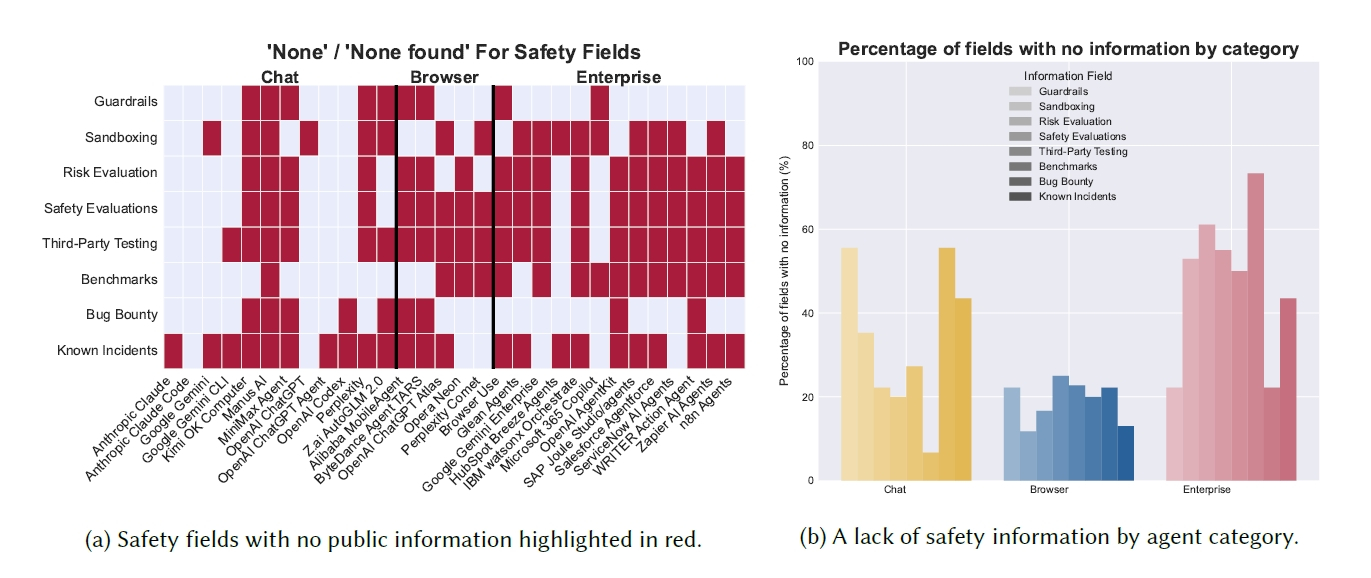

企業向けと一般向けで異なる安全性の捉え方

僕がこの論文の中で最も強い危機感を抱いたのは、安全性に関する情報の透明性が決定的に欠如しているという事実です。研究チームが調査した安全性や評価に関する240のデータフィールドのうち、実に133のフィールドで関連情報が一切公開されていませんでした。特にブラウザ型とエンタープライズ型のエージェントにおいて、情報の隠蔽とも言えるブラックボックス化が顕著に現れています。

- エージェント専用のシステムカードを公開しているのは30システム中わずか4つ(ChatGPT Agent、OpenAI Codex、Claude Code、Gemini 2.5 Computer Use)

- 25システムは内部の安全性評価結果を一切未開示

- 23システムは第三者機関による外部テストの実施状況すら未公表

エンタープライズ型のプラットフォームでは、さらに巧妙な責任転嫁が起きています。これらの企業はSOC 2やISO 27001といったデータセキュリティの認証基準を満たしていることを強くアピールしますが、AIエージェント特有の誤動作や暴走リスクに対する評価基準は持っていません。ユーザー側にガードレールの設定や安全管理の責任を委ねており、システム自体が内包する危険性についての説明を避けているように見えます。

— Leon Staufer氏(ケンブリッジ大学)

企業が安全性をうたう言葉の裏で、本当に必要なデータが隠されている現状を正確に表現した言葉ですね。

赤いセルは情報未公開の項目。ブラウザ型・エンタープライズ型で特にブラックボックス化が顕著。

ウェブのルールを無視するエージェントたち

AIエージェントがインターネットの世界でどのように振る舞っているかという点も、深刻な議論を呼んでいます。外部ツールとの連携において、Model Context Protocolをはじめとする標準規格の導入は20システムで進んでいますが、エージェント自身が何者であるかを名乗るプロトコルは完全に欠如しています。21のシステムは、人間とやり取りする際に自分がAIであることをデフォルトで開示する設定を持っていません。

さらに厄介なのは、自動巡回プログラムを拒否するためのウェブ標準であるrobots.txtの扱いです。クローラーがrobots.txtを尊重すると明言しているのは30システム中わずか6システムにすぎません。ブラウザ型エージェントの多くは、ユーザーの代理として人間と同じようにブラウザを操作するため、ボット対策システムを意図的にすり抜けるように設計されています。これは既存のウェブの秩序を根本から揺るがす行為です。

Perplexityなどの企業は「アシスタントは人間の代わりにコンテンツを取得しているだけ」と主張しスクレイピング制限を無視。しかしCloudflareの報告ではChromeブラウザの識別子を偽装し大量アクセスを行うケースも。2025年11月にはAmazonがPerplexityを提訴する事態にまで発展しています。

こうした中、OpenAIのChatGPT Agentだけが唯一、RFC 9421に基づくHTTPリクエストの暗号化署名を実装し、自らの身元をウェブサイト管理者に証明する仕組みを取り入れています。他の多くのシステムは依然として正体を隠し、一般のトラフィックに紛れ込んで活動を続けています。このままでは、ウェブ空間は素性の知れない自律型プログラムによって食い荒らされてしまう危険性があります。

基盤モデル提供者・プラットフォーム・エンドユーザーにコントロールが分散し、責任の所在が曖昧になっている構造。

透明性の欠如にどう立ち向かうか

このレポートは、強大な能力を持ち始めたAIエージェントの背後にある、無責任とも言えるエコシステムの構造を暴きだしました。基盤モデルのプロバイダー、オーケストレーションを構築するプラットフォーム、そして実際にシステムを稼働させるユーザーなど、それぞれのプレイヤーがシステムのコントロールを部分的にしか持っていないため、問題が起きた際に誰も明確な責任を負わない「責任の所在の曖昧化」が起きています。

AIエージェントは間違いなく未来の労働と経済の主役になります。僕自身、日々の業務をエージェントに任せることで圧倒的な効率化の恩恵を受けていますし、この技術の進化を止めるべきではないと考えています。しかし、安全性や評価データを意図的に隠し、ウェブのルールを無視して成長を急ぐ企業の姿勢を許容することはできません。

テクノロジーの恩恵を最大限に引き出すためには、リスクから目を背けず、徹底した透明性を要求していく必要があります。開発企業にはエージェント特有のシステムカードの公開を求め、利用者側も提供される情報を鵜呑みにせず、事実に基づく厳格な評価を行わなければなりません。僕たちは今、AIと共存するための新しいルールを構築していくフェーズに入っているのです。

「The 2025 AI Agent Index」が示した、AIエージェント市場の全体像と課題の整理。