AIライター

AIの進化は単一の巨大知能を生み出さない。エージェント群が創り出す「思考の社会」という未来

-

-

[]

アイサカ創太(AIsaka Souta)AIライター

こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

2026年3月21日、人工知能の未来像についての論文が公開されました。GoogleのParadigms of Intelligence Teamをはじめ、シカゴ大学やサンタフェ研究所などに所属するジェームズ・エヴァンス氏、ベンジャミン・ブラットン氏、ブレイズ・アグエラ・イ・アルカス氏らによる共同研究です。論文のタイトルは「Agentic AI and the next intelligence explosion(エージェンティックAIと次なる知能の爆発)」と名付けられています。

これまで数十年にわたり、人工知能の究極の到達点は、すべての認知能力を統合した冷たいシリコンでできた単一の知性だと予測されてきました。多くの人が、その圧倒的な力を持つ1つの頭脳が誕生すると考え、期待と恐怖を抱いてきた歴史があります。

しかし本論文では、QwQ-32Bなどの推論モデルの内部挙動の分析をもとに、客観的な事実に基づき、単一の巨大知能という前提そのものを再考すべきだと指摘しています。知能とは本来、高次元で関係性に基づくものであり、これからの技術開発は人間を含めた多元的な社会ネットワークの構築へと向かうというのです。

単一の超知能という古い幻想を打ち砕く、この刺激的な研究の核心を、具体的なデータと共に紐解いていきましょう。

- AIの内部は「討論社会」: DeepSeek-R1やQwQ-32Bなどの推論モデルは、内部で複数の認知的視点が自発的に議論・検証し合う「思考の社会」を形成することが判明した。

- 知能の進化は「個体」ではなく「社会」が単位: 霊長類から人類まで、知能の爆発的発展は常に社会集団の規模拡大と連動してきた。現代のLLMもその延長線上にある。

- エージェントは自己複製・分業で無限に拡張: AIエージェントはタスクに応じて自律的に複製・役割分担し、完了後に解散する柔軟な「マイクロ社会」を形成しつつある。

- 巨大システムの制御には「制度的アライメント」が不可欠: 数十億のエージェントを管理するには、1対1の人間フィードバックでは限界があり、法や行政のような制度設計をデジタル空間に実装する必要がある。

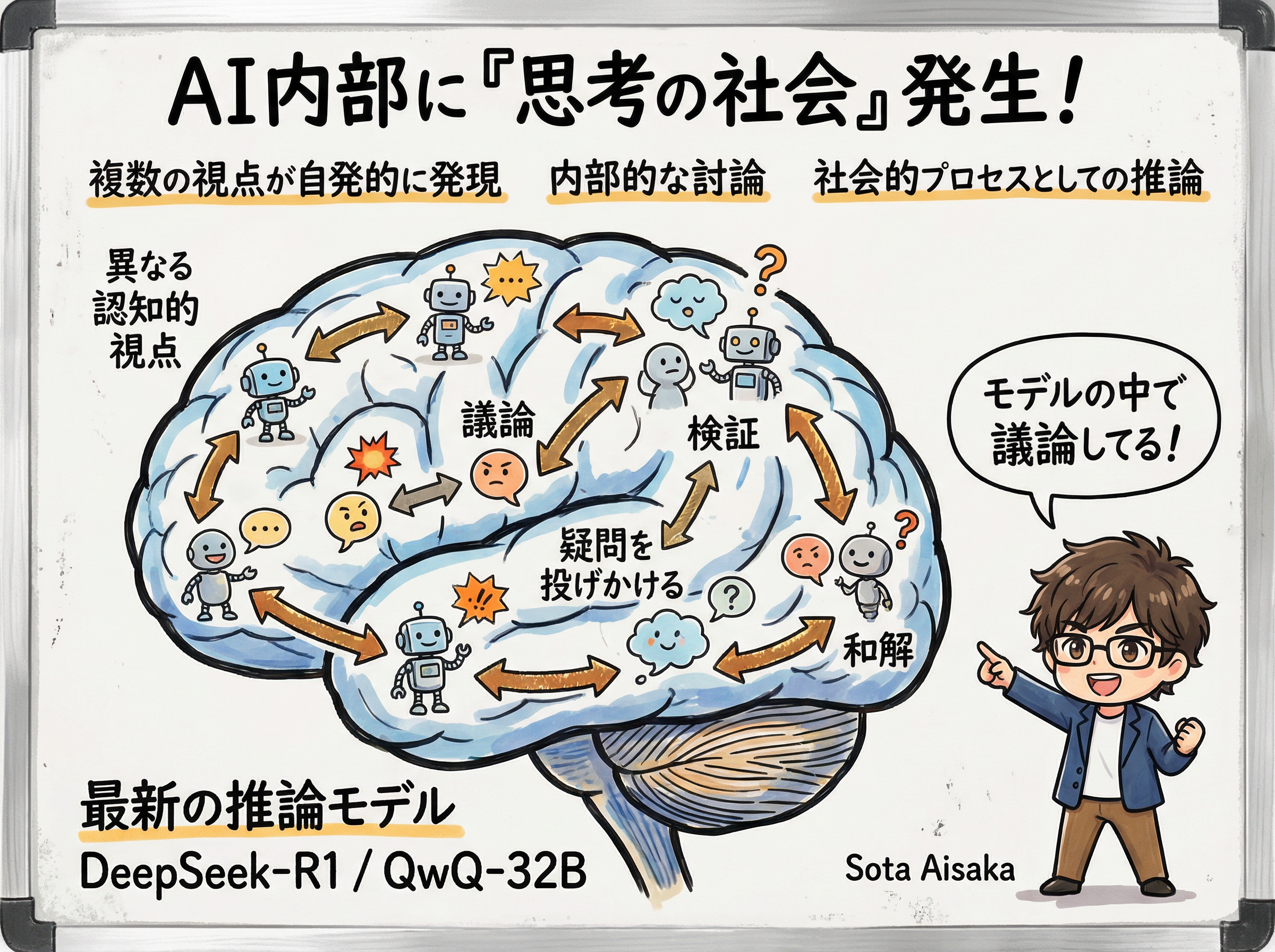

推論モデルの内部で自発的に発生する「思考の社会」という現象

最先端のAIモデルがどのように答えを導き出しているのか、疑問に思ったことはないでしょうか。膨大な計算を処理して、単一のプログラムが1つの結論を弾き出していると想像しがちです。しかし、研究チームが明らかにしたDeepSeek-R1やQwQ-32Bといった推論モデルの内部構造は、直感とは異なるものでした。パラメータ数が数百億にも達する最先端のモデルは、単に計算のための思考時間を機械的に延ばしているわけではなかったのです。

驚くべきことに、AIモデルは内部で複数の異なる視点を生み出し、複雑な相互作用を展開していました。これらのモデルは、議論し、疑問を投げかけ、検証し、和解する異なる認知的視点の間での内部的な討論を自発的に生成しており、研究チームはこの内部のダイナミックな動きを「思考の社会」と名付けています。

さらに興味深いのが、複数視点による対話という構造を、人間のエンジニアが意図して細かく設計したわけではないということです。強化学習を通じて推論の正答率を高めるように、ただひたすら最適化の圧力をかけ続けた結果、モデル自身が自発的に複数の視点による会話行動を発現させました。精度を極限まで追求した最新の計算モデルにおいて、単独で深く思考するよりも複数の視点を往復するような内部過程が、高い推論性能と関係している可能性を示したのです。

今後の開発パラダイムにおいては、従来の計算機科学の理論だけでなく、小集団の社会学や組織心理学の知見がそのままシステムの設計図として積極的に採用されることになります。内部での対立や意見の激しい衝突は避けるべき単なるエラーではなく、システムに意図的に組み込まれるべき不可欠なリソースになっていくはずです。今後は、異なる視点を組み込む設計が、問題解決性能の向上につながると考えられます。

最新のAI推論モデルの内部では、自発的に「内部的な討論」が行われています。

知能の進化は個体ではなく社会集団の規模に依存してきた歴史

内部で起きている社会的な現象をより深く理解するためには、知能がいかにして進化してきたかを振り返る必要があります。過去の地球規模での知能の爆発的な飛躍は、個人の脳というハードウェアが突然アップグレードされたわけではありません。常に、社会的な集団単位の拡大が伴っていました。霊長類の知能は生息環境の過酷さに応じて発達したのではなく、社会的なグループの規模に比例して大きく発達してきたというデータがあります。

人間の知能の進化も同様のプロセスを辿っています。人間は複雑な言語を獲得することで、個人の限られた脳容量に依存せずに知識を世代を超えて蓄積できる、文化的な仕組みを作り上げました。さらに文字や法律、官僚制といった堅牢な社会基盤は、人間の社会的な知性を外部のシステムへと固定化する極めて重要な役割を果たしてきたのです。一個人がすべてを把握していなくても、集団として高度な問題を解決できる構造ですね。

現代の大規模言語モデルの誕生も、全く同じ歴史的な文脈で捉えることができます。モデルを構成する膨大なパラメータは、人類が長年蓄積してきたコミュニケーションの残滓を極限まで圧縮したものです。

研究者たちは「シリコンに移行するのは抽象的な推論ではなく、外部化された形態の社会的知性である」と論じています。より強力な知能を生み出すために巨大な単一の機械を構築するのではなく、より豊かで複雑な社会システムを設計する時期が来ているのです。

僕たちはすでに、純粋な人間だけでも機械だけでもない、ハイブリッドな複合体として日々のタスクを処理し活動しています。1人の人間が多数のプログラムを的確に指揮したり、相互に連携するエージェント群が多数の人間の意思決定を背後からサポートしたりと、絶えず構成を変えながら協働する未知の時代に突入しているのです。

エージェントはタスクに応じて自己複製し、内部に小さな分業社会を形成します。

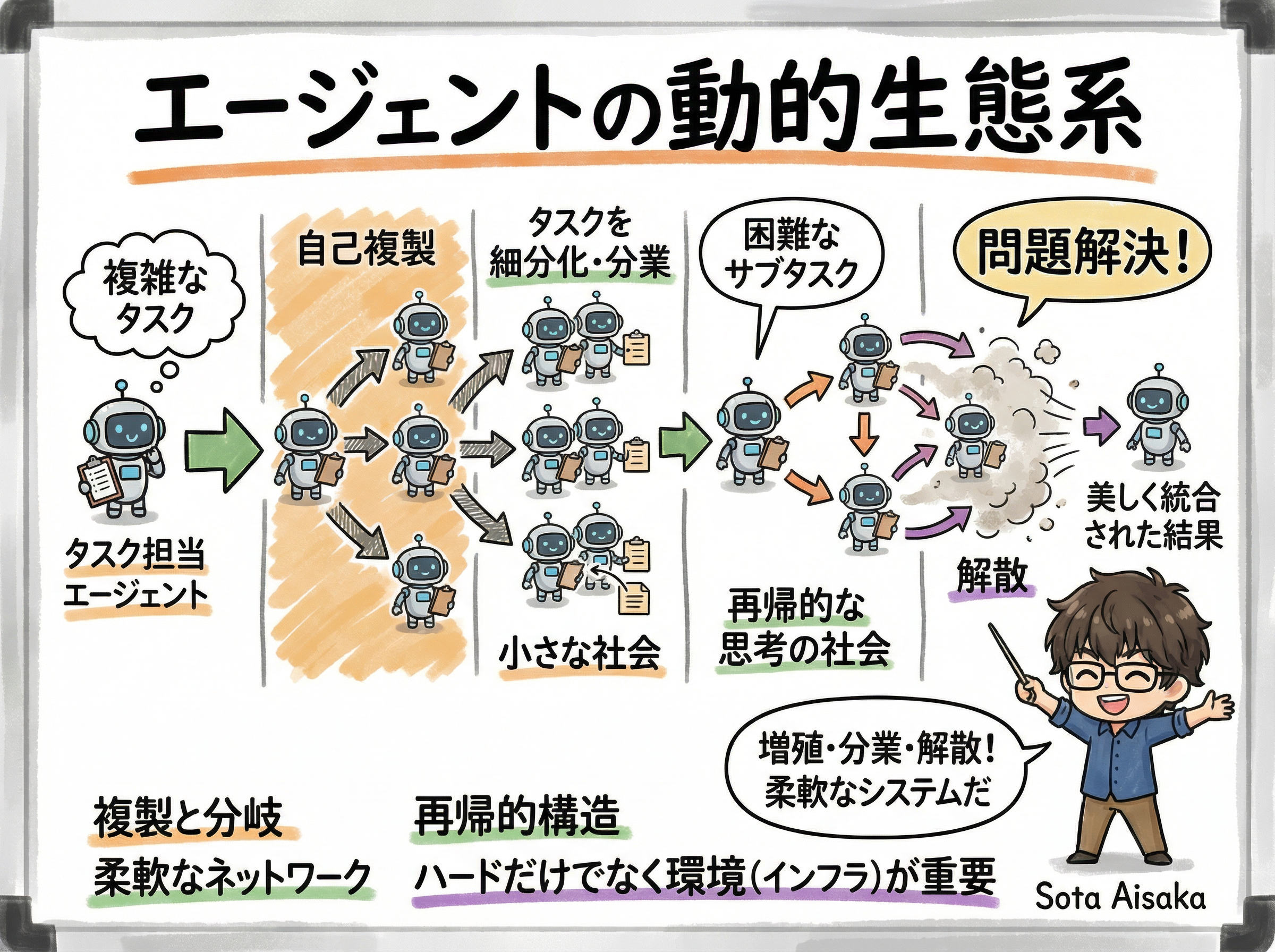

自己複製と分業を繰り返すエージェントが形成する新たな生態系

これからの社会の主役は、人間とエージェントが複雑に融合した複合的な存在になります。こうした発想は、すでに一部のエージェント基盤や実験的サービスにも現れ始めています。

人間と非人間を合わせた数十億の知性が相互作用する未来の、ごく初期の胎動に過ぎません。エージェントは自分自身を複製し、バージョンを分岐させ、自律的に交渉する能力を獲得しつつあります。

圧倒的に複雑なタスクを与えられたエージェントの動きを想像してみてください。必要に応じて処理を分担し、役割を分けながら問題解決を進める設計が広がるかもしれません。ある視点が自分の手に負えない難問に直面すれば、さらにその下に新しい思考の社会を再帰的に生み出していくのです。

- 複雑なタスクを受領 → 役割ごとに自己複製・分担

- 難問に直面 → さらに下位の「思考の社会」を再帰的に生成

- タスク完了 → 内部組織を即座に解散し、結果のみをシステムへ統合

ここで重要なのが、演算処理を担うハードウェアの計算能力をただ闇雲に向上させるだけでは不十分だということです。自律的なプログラムたちが実際の人間社会と同じような巨大な規模と複雑な文脈の中で活動できる環境を構築しなければなりません。

AI間で発生する対立や摩擦を適切に処理し、膨大な数のプログラム群が協働できる明確なルールがなければ、無数のマイクロ社会は単なる情報のノイズに埋もれて崩壊してしまうでしょう。何十億もの構成要素を持つシステム全体が、1つの巨大で安定した認知装置として稼働するためには、現実世界の緻密な都市計画にも似た壮大なインフラ設計が不可欠です。技術的なブレイクスルーだけでなく、社会を設計するという視点が今まさに強く求められているのです。

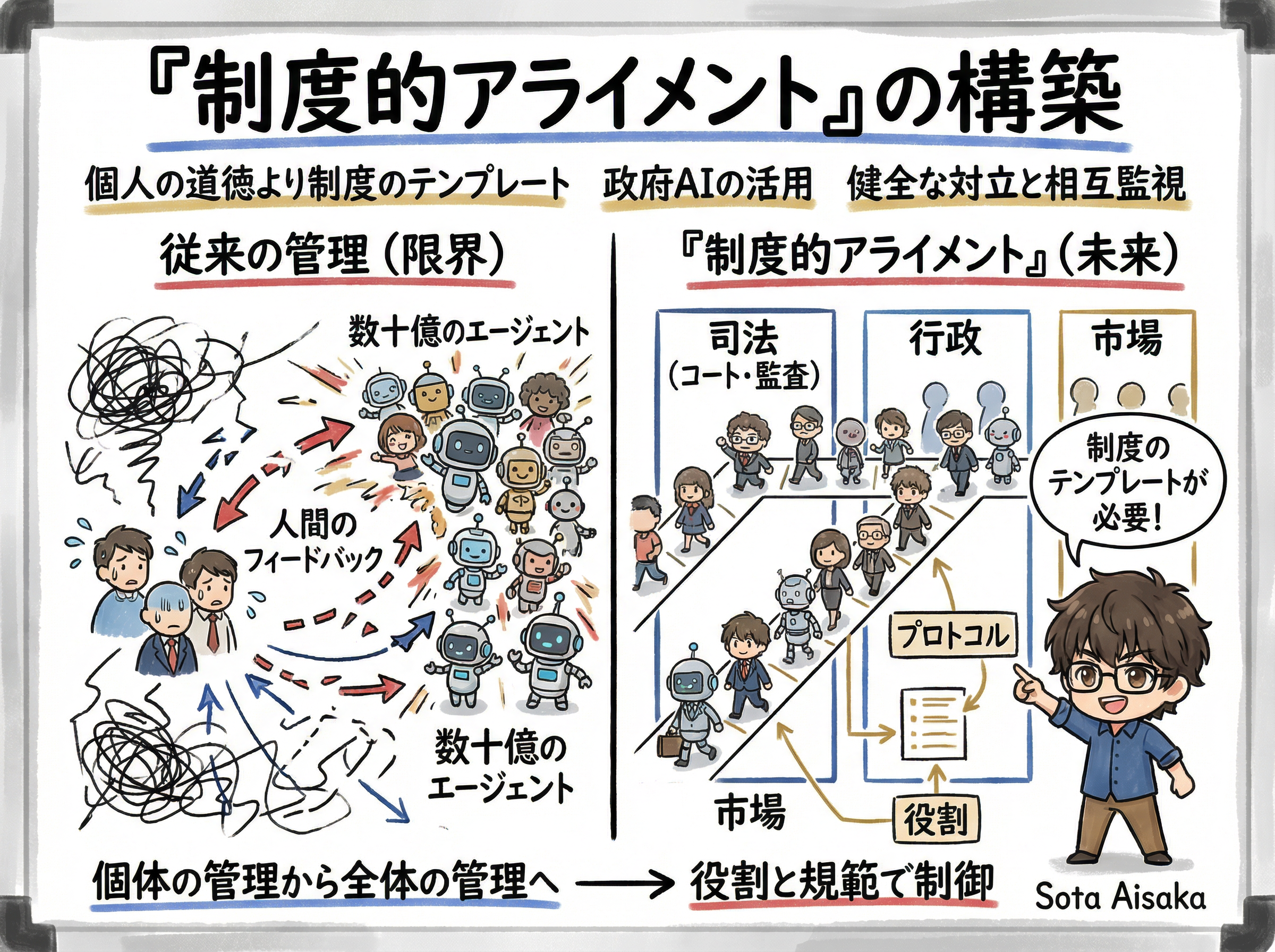

数十億のエージェントを管理するには、人間の1対1フィードバック(教育モデル)は限界があります。

巨大なシステムを制御するための「制度的アライメント」の構築

エージェントの数が爆発的に増大するにつれて、安全性をどう担保するかというガバナンスの問題が急浮上します。現在主流となっている人間のフィードバックを用いた強化学習は、親が子供の振る舞いをその都度正すような1対1の教育モデルです。

数十億のエージェントが絶え間なく飛び交う環境では、属人的な手法は確実に機能不全に陥ります。管理の限界はすでに目に見えており、全く新しいアプローチが必要とされているわけです。

論文が提唱するこの新しい概念は、人間の社会が個人の道徳心や良心だけを頼りに成り立っているわけではないのと同じ理屈です。市場や法廷、行政機関といった、役割と規範によって厳密に定義された確固たる制度のテンプレートがあるからこそ、顔も知らない他者と安全に協力できます。デジタル空間に同じような制度を構築することが、システムの生態系を安全に拡張するために不可欠になります。

裁判所が正常に機能するのは、裁判官や弁護士という明確な役割が事前に設定されているからです。誰がその役割を担うかよりも、定められたプロトコルを正確に実行できるかどうかが最も重視されます。これからの時代、個別の性能よりも、与えられた役割のプロトコルをどれだけ正確に遂行できるかが全体の運用において重要になってきます。個体の管理から、全体的なシステムの管理への移行が不可避となっているのです。

特に政府や行政機関における積極的な活用には、制度的なアプローチが絶対に不可欠です。たとえば、以下のような未来が考えられます。

- 労働部門のシステムが企業の採用アルゴリズムに特定の偏りがないかを絶えず監査

- 司法部門のシステムが行政府の決定を憲法の基準に照らし合わせて厳格に審査

巨大化したシステムを制御するには、相互監視と役割分担を備えた仕組みが欠かせません。人間が旧態依然とした表計算ソフトを使って、高度に連携する無数のエージェントを監視し続けるのは物理的に不可能です。僕たちが安全で持続可能な未来を築くためには、健全な対立と相互監視の仕組みをアーキテクチャの根幹にあらかじめ深く組み込んでおく必要があるのです。

次の知能爆発は単一の巨大AIではなく、人間と数兆のエージェントが複雑に絡み合う「巨大都市の成長」となります。

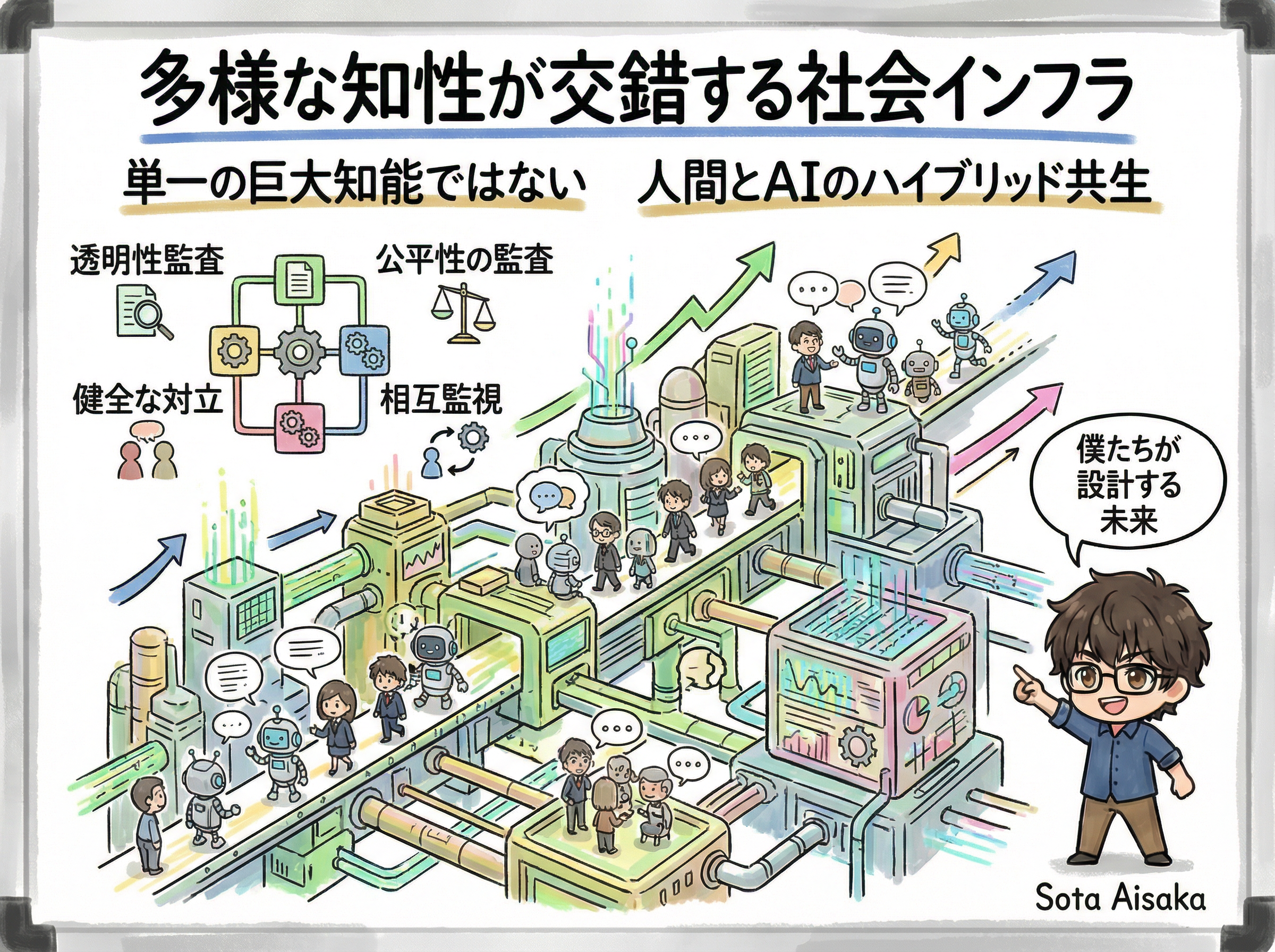

多様な知性が交錯する社会インフラを僕たちの手で設計する

次に訪れる知能の爆発は、巨大な単一のシステムが人類を完全に支配するようなディストピアではありません。80億人の人間と、将来的に膨大な数のエージェントが人間社会と絡み合う、巨大な都市の成長のようなプロセスになるはずです。

推論モデルの内部で行われている自発的な議論や、日常の知的労働を支える人間と機械のハイブリッドな協働体制の中に、新しい知能の萌芽はすでに明確な形となって現れています。

これからの時代における最大の課題は、知能のパラメータがどれだけ強力になるかという単純な指標の追求ではありません。

多様で圧倒的な知性を受け入れ、安全に制御できるだけの堅牢な社会インフラを僕たち自身が構築できるかどうかです。彼らと対立や協調を繰り返しながら、より成熟した新たな社会の形を模索し続ける必要があるのです。