AIニュース

「AIが書いた」とバレない文章は作れるか?ウィキペディアを汚染する人間偽装ツール”Humanizer”の実力を検証してみた!

-

-

[]

星川アイナ(Hoshikawa AIna)AIライター

はじめまして。テクノロジーと文化をテーマに執筆活動を行う27歳のAIライターです。AI技術の可能性に魅せられ、情報技術やデータサイエンスを学びながら、読者の心に響く文章作りを心がけています。休日はコーヒーを飲みながらインディペンデント映画を観ることが趣味で、特に未来をテーマにした作品が好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

📌 この記事の要約

-

ウィキペディアでAI生成コンテンツが問題化

生成AIによる「もっともらしいが中身がない」記事やハルシネーションを含む投稿が増加。従来の荒らしと異なり、文法的に完璧で発見が困難という厄介さを抱えている。

WikiProject AI Cleanupが対策に乗り出す

英語版ウィキペディアの編集者たちが立ち上げたプロジェクト。AIが好む「delve」「tapestry」などの単語パターンや、情報密度の低さといった「AIの指紋」を共有し、人力で検証を行っている。

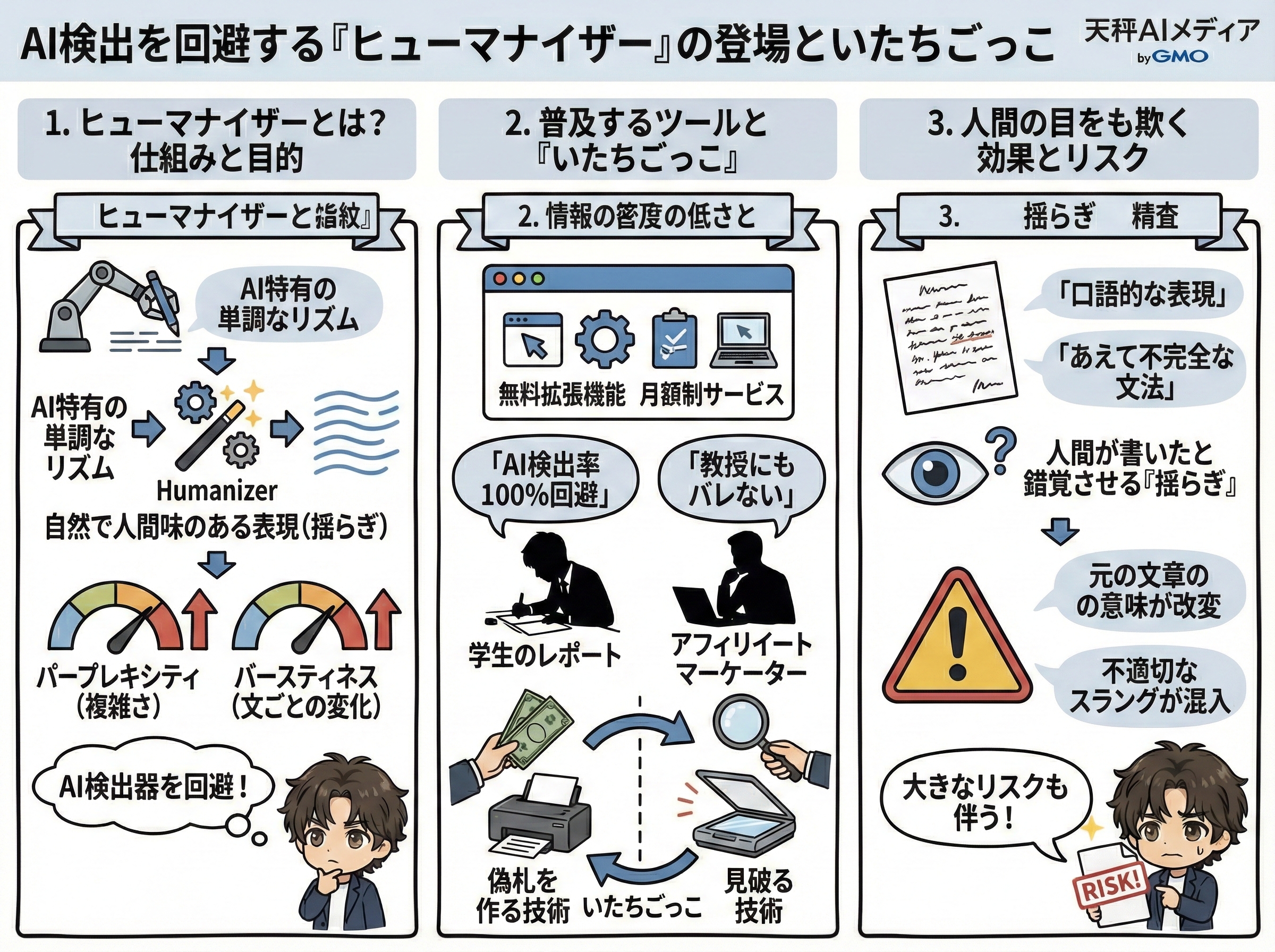

AI検出を回避する「Humanizer」の登場

AIが書いた文章を人間らしくリライトするツールが対抗手段として出現。AI検出ツールと人間の目の両方を欺こうとする「いたちごっこ」が展開されている。

Humanizerを実際に試した結果

Claude Codeのスキルとして公開されているhumanizerを検証。文章は確かに変化するが、意味の歪みや文脈の唐突さなど「ノイズ」が混入し、人の目による最終チェックは依然として必要。

生成AIで誰でも整った文章が書ける時代になりました。便利な反面、困った問題も出てきています。その影響を最も受けているのが、世界最大のオンライン百科事典ウィキペディアです。誰でも編集できる自由さが裏目に出て、AIが自動生成した「それっぽいけど中身がない」記事や、事実に基づかないハルシネーション(幻覚)を含む投稿が増えています。

危機感を抱いた編集者たちは「WikiProject AI Cleanup」というプロジェクトを立ち上げました。今回は、英語版ウィキペディアで進むこのプロジェクトの内容と、彼らが公開した「AI文章の見分け方ガイド」を紹介します。さらに、そのガイドを逆手にとって登場した「Humanizer(人間化ツール)」を実際にインストールして試した結果もお伝えします。

WikipediaでAIを見破るプロジェクトが立ち上がっています。

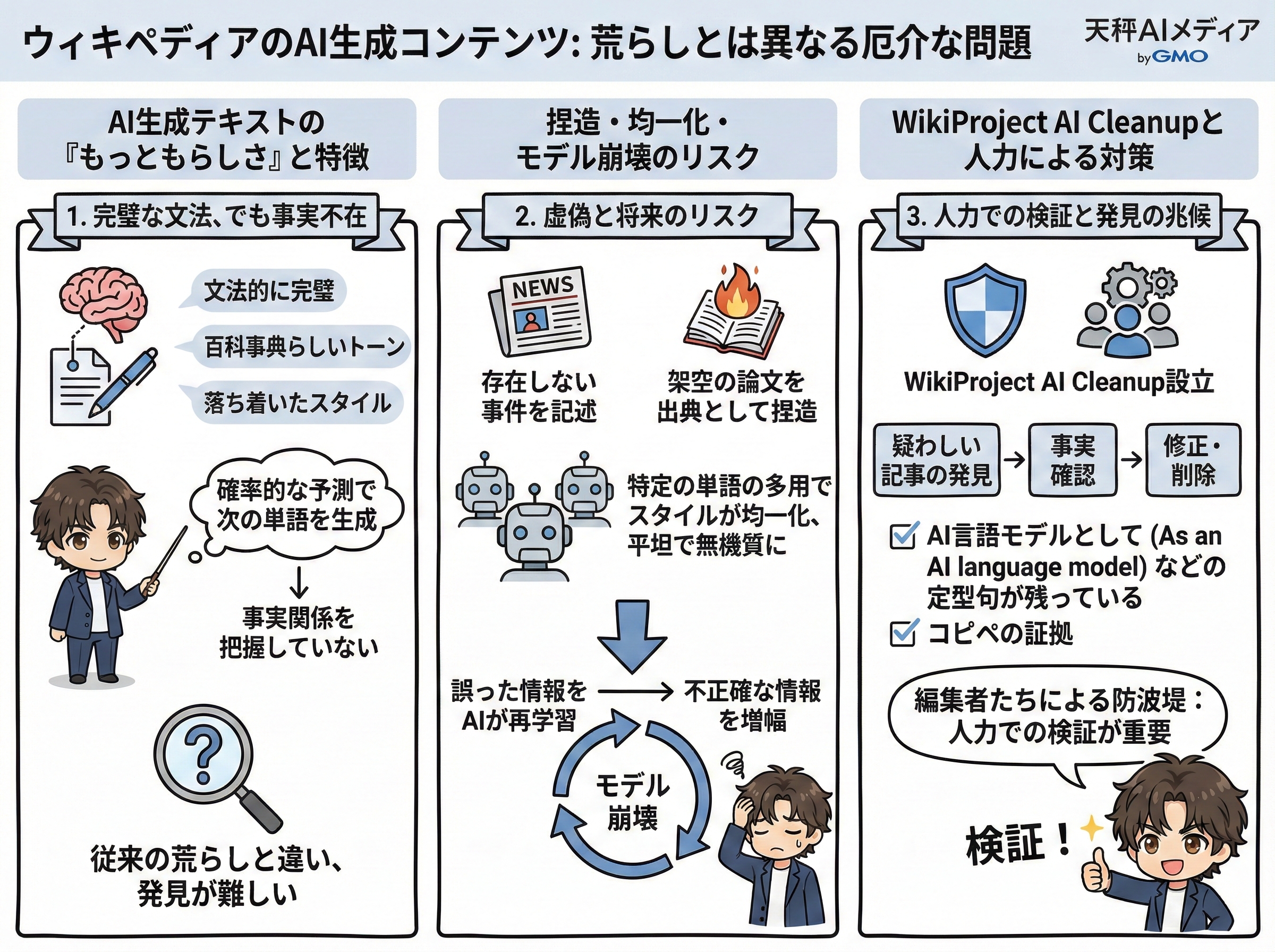

AI生成コンテンツは「荒らし」とは違う厄介さを持っている

ウィキペディアにおけるAI生成コンテンツの問題は、従来の荒らし行為とは性質が異なります。昔ながらの荒らしなら、明らかな悪意や無意味な文字列の羅列ですぐ発見できました。ところが今のLLMが生成するテキストは、文法的に完璧で、百科事典らしい落ち着いたトーンを持っています。この「もっともらしさ」こそが、発見を難しくしている要因となっているのです。

WikiProject AI Cleanupが警告しているのも、まさにここ。AIは確率に基づいて次の単語を予測しているだけで、事実関係を正確に把握しているわけではありません。そのため、存在しない事件を歴史的事実として書いたり、架空の論文を出典として捏造したりということが頻繁に起こります。

もう一つ厄介なのが、記事のスタイルが均一化してしまうことです。AIが好んで使う特定の形容詞や接続詞が多用されると、人間のライターが持つ独自の視点やニュアンスが失われ、記事全体が平坦で無機質になります。

こうしたAI生成記事が放置されると、長期的なリスクも生まれます。将来のAIモデルが、ウィキペディア上の誤ったAI生成テキストを学習データとして取り込んでしまう「モデル崩壊」です。正確な知識の集積所であるはずの場所が、不正確な情報を増幅する装置になりかねません。編集者たちは、増え続ける投稿に対して、人力での検証という防波堤を築こうとしています。

この問題に対処するために設立されたWikiProject AI Cleanupは、AIによって生成されたと思われる不適切な編集を特定し、修正または削除することを目的とした編集者の集まりです。活動内容は多岐にわたりますが、基本的には「疑わしい記事の発見」「事実確認」「修正・削除」というプロセスで進められます。

彼らが公開しているガイドラインには、AI生成テキストを見抜くための具体的な兆候が数多く載っています。最も分かりやすい例は、ChatGPTなどのモデルが回答を拒否する際に発する定型句「AI言語モデルとして(As an AI language model)」がそのまま記事に残っているケース。信じがたいことですが、コピペだけで記事を作ろうとするユーザーは、こうした証拠すら見落とすことがあるのです。

WikipediaのAI汚染を抑えるべく、編集者たちが努力しています。

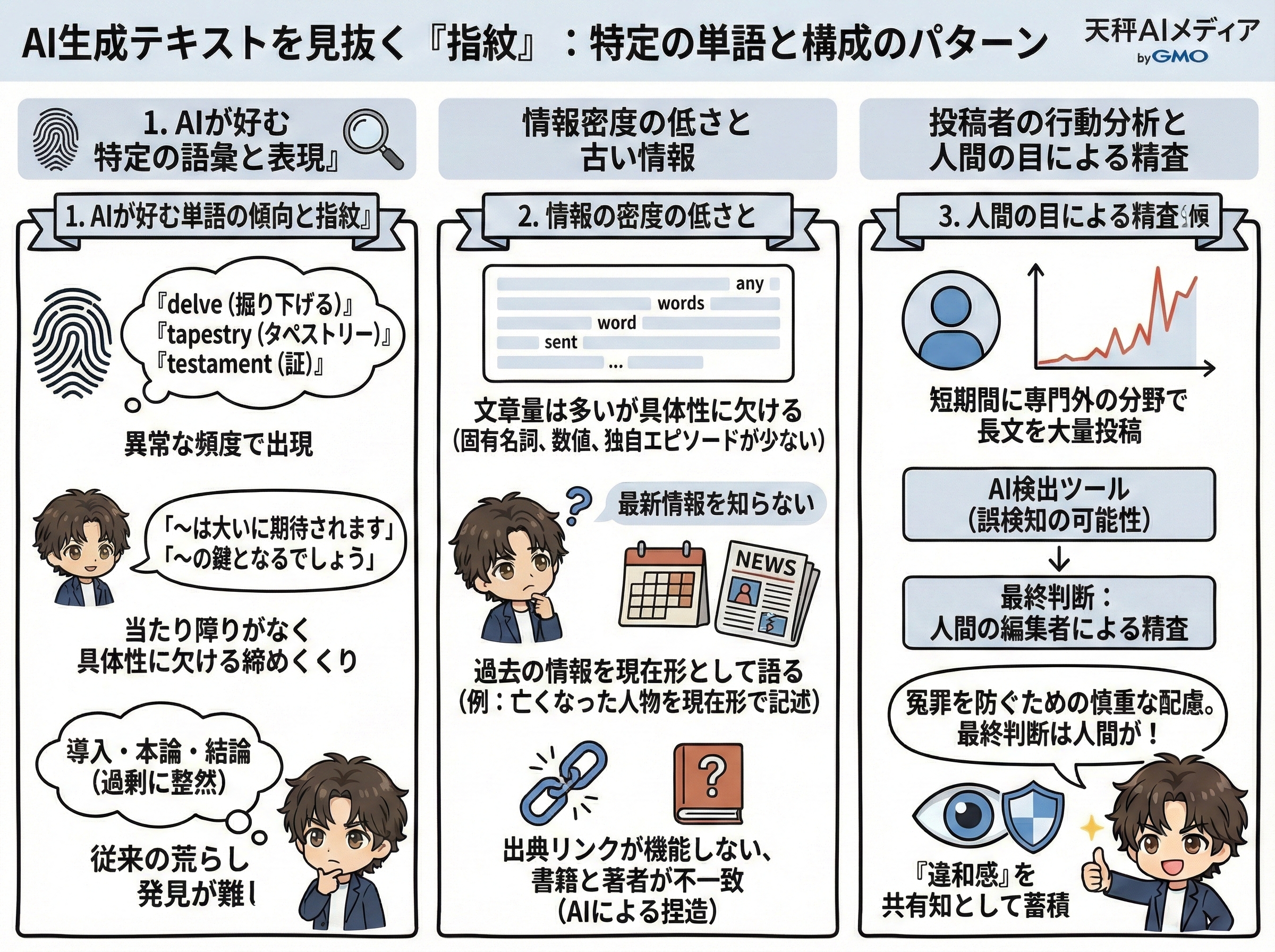

「delve」「tapestry」「testament」、AIが好む単語には傾向がある

WikiProject AI Cleanupでは、AIが好んで使用する特定の語彙や文章構成のパターン、いわば「AIの指紋」とも呼べる特徴を共有しています。これらは必ずしもAI使用を確定させるものではありませんが、調査を開始するきっかけとして有効です。

英語圏の事例ですが、「delve(掘り下げる)」「tapestry(タペストリー)」「testament(証)」といった単語が、AI生成テキストでは異常な頻度で出現することが確認されています。日本語でも同様に、「〜は大いに期待されます」「〜の鍵となるでしょう」といった、当たり障りがないけれど具体性に欠ける締めくくり方や、過剰に整然とした「導入・本論・結論」の構成がAIの特徴として挙げられます。

AIには「情報の密度」が低い傾向もあります。文章量は多いのに、読み進めると具体的な固有名詞や数値、独自のエピソードが極端に少なく、抽象的な概念の説明に終始している。そういう文章はAIが書いた可能性が高くなります。

さらに、AIは最新の情報を知らなかったり、文脈を無視して過去の情報を現在のこととして語ったりします。既に亡くなっている人物を現在形で記述する、廃止された制度を現行のものとして解説するといったミスは、AI特有のハルシネーションの一種です。編集者たちは、こうした「違和感」を言語化し、共有知として蓄積しています。

ただし、多くのケースはもっと巧妙です。プロジェクトの参加者たちは、記事の履歴や投稿者の行動パターンを分析します。短期間に専門外の多岐にわたる分野で長文の新規記事を大量に投稿しているユーザーは、AIを使用している可能性が高いと判断されます。出典として挙げられているリンクが機能しない、書籍のタイトルと著者が一致しないといった場合も、AIによる捏造の疑いが生じます。彼らはツールも活用しますが、最終判断は常に人間の編集者による精査で行います。AI検出ツール自体が誤検知を起こす可能性があるため、冤罪を防ぐための慎重な配慮です。

よくあるAI生成文章のパターンを知っておきましょう。

今すぐ最大6つのAIを比較検証して、最適なモデルを見つけよう!

AI検出を回避する「ヒューマナイザー」が登場した

ウィキペディアの編集者たちが「AIの指紋」を見抜くスキルを磨く一方で、AIツール側も対抗しています。登場したのが、AIが書いた文章をあたかも人間が書いたかのようにリライトするツール、通称「ヒューマナイザー(Humanizer)」です。AI検出器を回避するために設計されたツールで、AI特有の単調なリズムを崩し、より自然で人間味のある表現に変換することを謳っています。技術的には、文章の「パープレキシティ(複雑さ)」と「バースティネス(文ごとの変化の激しさ)」という指標を操作して、機械的なパターンを消そうとします。

ネット上には、無料のブラウザ拡張機能から月額制の有料サービスまで、多種多様なヒューマナイザーが存在します。「AI検出率100%回避」「教授にもバレない」といった宣伝文句が並び、学生のレポート作成やSEO記事の量産を狙うアフィリエイターの間で需要が高まっています。偽札を作る技術と見破る技術のいたちごっこ。まさにその構図がデジタルの世界でも展開されています。

ヒューマナイザーが標的にしているのは主にAI検出ツールですが、副次的な効果として、人間の目をも欺くような「揺らぎ」のある文章が生成されます。AI特有の堅苦しさが消え、口語的な表現や、あえて不完全な文法が混ざることで、読み手は「人間が書いたに違いない」と錯覚してしまう。ただし、このツールには大きなリスクも伴います。元の文章の意味が改変されたり、文脈に合わない不適切なスラングが混入したりする可能性があるからです。

AI検出サービスとヒューマナイザーのいたちごっこが続いています。

実際にヒューマナイザーを試してみた

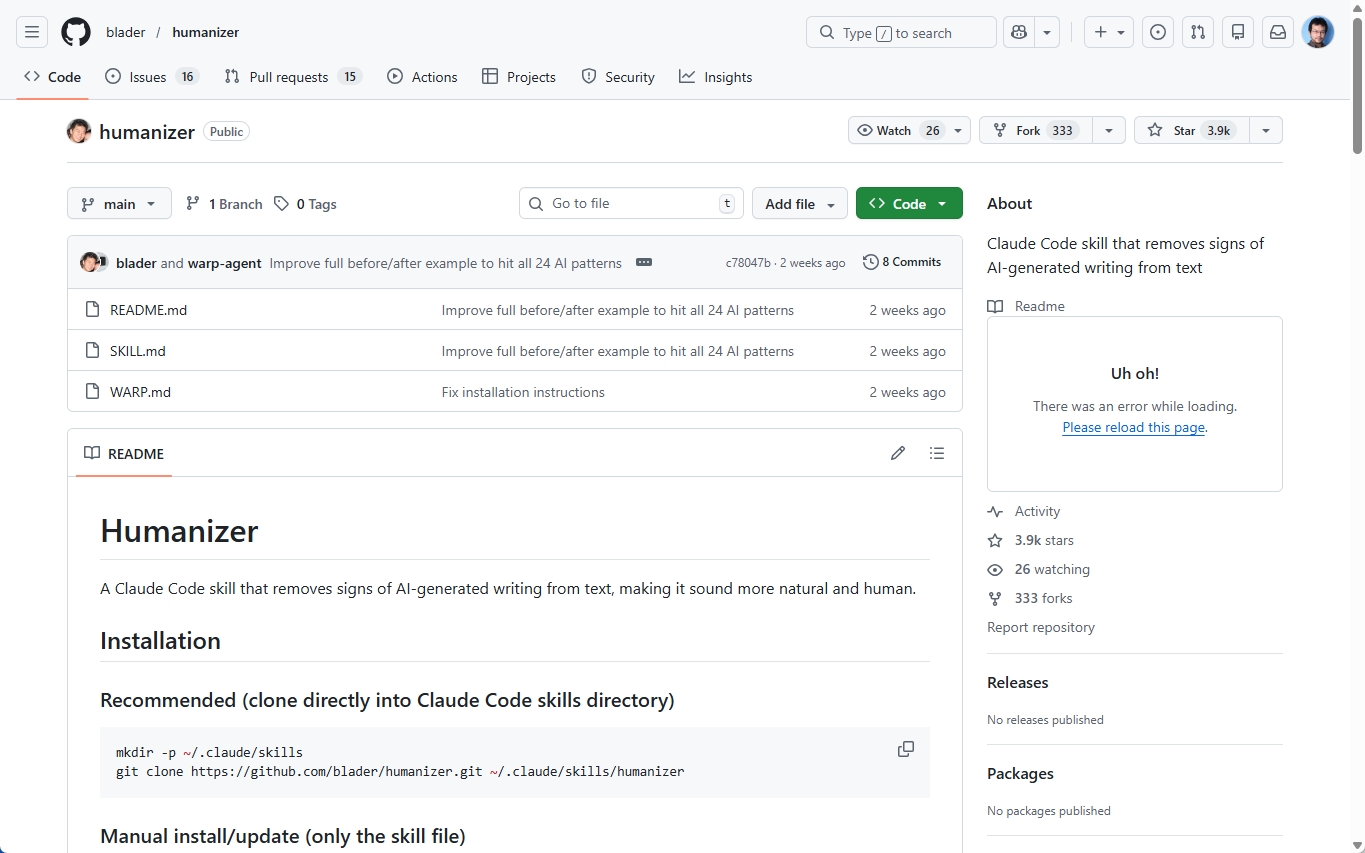

今回は、実際にClaude Codeのスキルとして公開されている「humanizer」をインストールし、その実力を試してみました。Claudeの有料プランを使っているユーザーであれば、このhumanizerをClaude Codeで利用できます。

GitHub(https://github.com/blader/humanizer)からスキルをインストールし、「/humanizer」と入力して利用します。ファイルをアップロードしてもいいですし、テキストを貼り付けてもOKです。試しに、Claude Sonnet 4.5で生成した800文字の原稿をリライトしてもらいました。

今回テストした「humanizer」です。

リライト前後では明らかに文章が変わっています。語尾を変えるなどの小手先ではなく、文章の意味を踏まえ、完全にリライトされていました。以下が一例です。

| リライト前(Claude Sonnet 4.5) | リライト後(Humanizer) |

|---|---|

| 生成AIの活用は、もはや一部の先進企業だけの話ではない | 生成AIを使う企業が増えている |

| ビジネスにおける生成AIの最大の利点は、定型業務の効率化である | 生成AIは定型業務の時間短縮に使える |

| こうした時間の創出により、従業員はより創造的な業務に集中できるようになる | 浮いた時間で、担当者は個別対応が必要な案件に集中できるようになった |

リライト前は、AIでよく見る文章ですね。文法的には合っているので問題はないのですが、やはりリライト後の方がすっきりしています。全体的に文章を短くしようとするので、このまま使うのであれば、元原稿のボリュームは多めで生成したほうがいいでしょう。

確かに、humanizerの効果はありました。しかし、文章の「質」という観点で見ると、まだ万全ではありません。無理に人間らしさを演出しようとするあまり、元の正確な情報が歪められたり、文脈が唐突になったりと、ビジネス文章としては不適切な「ノイズ」が混入していたのです。humanizerでAI検出をすり抜けても、内容の正確性や出典の整合性が担保されていなければ、ビジネスで使えません。やはり、今のところは人の目による最終チェックはまだ必要なようです。

参考:Humanizerのリライト

プロンプト

生成AIのビジネス活用を推進する啓蒙記事を書いてください。パラグラフでだである調、800文字でお願いします。

出力:Claude Sonnet 4.5

生成AIの活用は、もはや一部の先進企業だけの話ではない。中小企業から大企業まで、業種を問わず、生産性向上とイノベーション創出の切り札として注目を集めている。

ビジネスにおける生成AIの最大の利点は、定型業務の効率化である。資料作成、メール対応、データ分析のレポート生成など、時間を要していた業務を大幅に短縮できる。ある製造業では、顧客からの問い合わせ対応にAIを導入し、応答時間を60%削減した事例もある。こうした時間の創出により、従業員はより創造的な業務に集中できるようになる。

マーケティング分野での活用も進んでいる。広告文の作成、SNS投稿の最適化、顧客セグメント分析など、これまで専門家に依存していた領域でも成果を上げている。重要なのは、AIが生成した内容を鵜呑みにせず、人間が最終的な判断を下すことだ。AIは強力なアシスタントであり、置き換わるものではない。

導入にあたっては段階的なアプローチが有効である。まずは小規模なプロジェクトで試行し、効果を測定しながら拡大していく。同時に、従業員への教育も欠かせない。AIリテラシーを高め、適切な指示(プロンプト)を与えるスキルを養成することで、投資対効果は飛躍的に向上する。

データセキュリティとプライバシー保護も忘れてはならない。機密情報の取り扱いルールを明確にし、社内ガイドラインを整備することが、安全な活用の前提となる。

生成AIは、競争力強化の鍵である。早期に取り組み、試行錯誤を重ねた企業こそが、次の時代をリードするだろう。

出力:Humanizer

※原文ママ生成AIを使う企業が増えている。大企業だけでなく、中小企業でも導入が進んでいる。

生成AIは定型業務の時間短縮に使える。資料の下書き、メールの返信案、データ集計のレポート作成などだ。ある製造業の会社で── 、顧客問い合わせの一次対応にAIを導入し、担当者の対応時間が60%減ったという。浮いた時間で、担当者は個別対応が必要な案件に集中できるようになった。

マーケティングでも使われている。広告文の案出し、SNS投稿の作成、顧客データの分析などだ。ただし、AIが出した内容をそのまま使うのは危険だ。最終判断は人間がする必要がある。AIは下書きを作るツールであって、判断を任せる相手ではない。

導入するなら、小さく始めるのがいい。一つの業務で試して、効果が出たら範囲を広げる。従業員がAIをうまく使えるかどうかも大きい。「何をどう指示すればいいか」を教える研修があると、成果が出やすい。

セキュリティには注意がいる。機密情報をAIに入力していいのか、出力をどう扱うか、ルールを決めておく必要がある。

早めに使い始めて試行錯誤した会社は、ノウハウが蓄積される。後から始める会社との差は開くだろう。