AIニュース

MetaのオープンソースAI「Llama 4」が1000万トークン対応!本100冊を元に会話ができる

-

-

星川アイナ(Hoshikawa AIna)AIライター

はじめまして。テクノロジーと文化をテーマに執筆活動を行う27歳のAIライターです。AI技術の可能性に魅せられ、情報技術やデータサイエンスを学びながら、読者の心に響く文章作りを心がけています。休日はコーヒーを飲みながらインディペンデント映画を観ることが趣味で、特に未来をテーマにした作品が好きです。

近年、AI技術は目覚ましい進化を遂げており、大規模言語モデル(LLM)は私たちの生活やビジネスを大きく変えつつあります。そんな中、2025年4月6日にMetaが新たに送り出したのが「Llama 4」です。テキストだけでなく画像や動画など、多様なメディア情報を扱えるマルチモーダル機能が充実したLlama 4は、従来のモデルよりもはるかに幅広いタスクへ応用可能と期待されています。また、開発元のMetaはオープンソース化にも積極的で、多くのパートナーやコミュニティが協力しながら、より使いやすく安全なAIの実現を目指しているのが好印象です。

今回は、Llama 4の特色やモデル群の概要、画期的な技術、競合モデルとの比較、さらに安全性や応用分野について解説します。

1000万トークンのコンテキストウィンドウを持つオープンソースのAIモデルが公開されました。

Llama 4の概要と3つのAIモデル

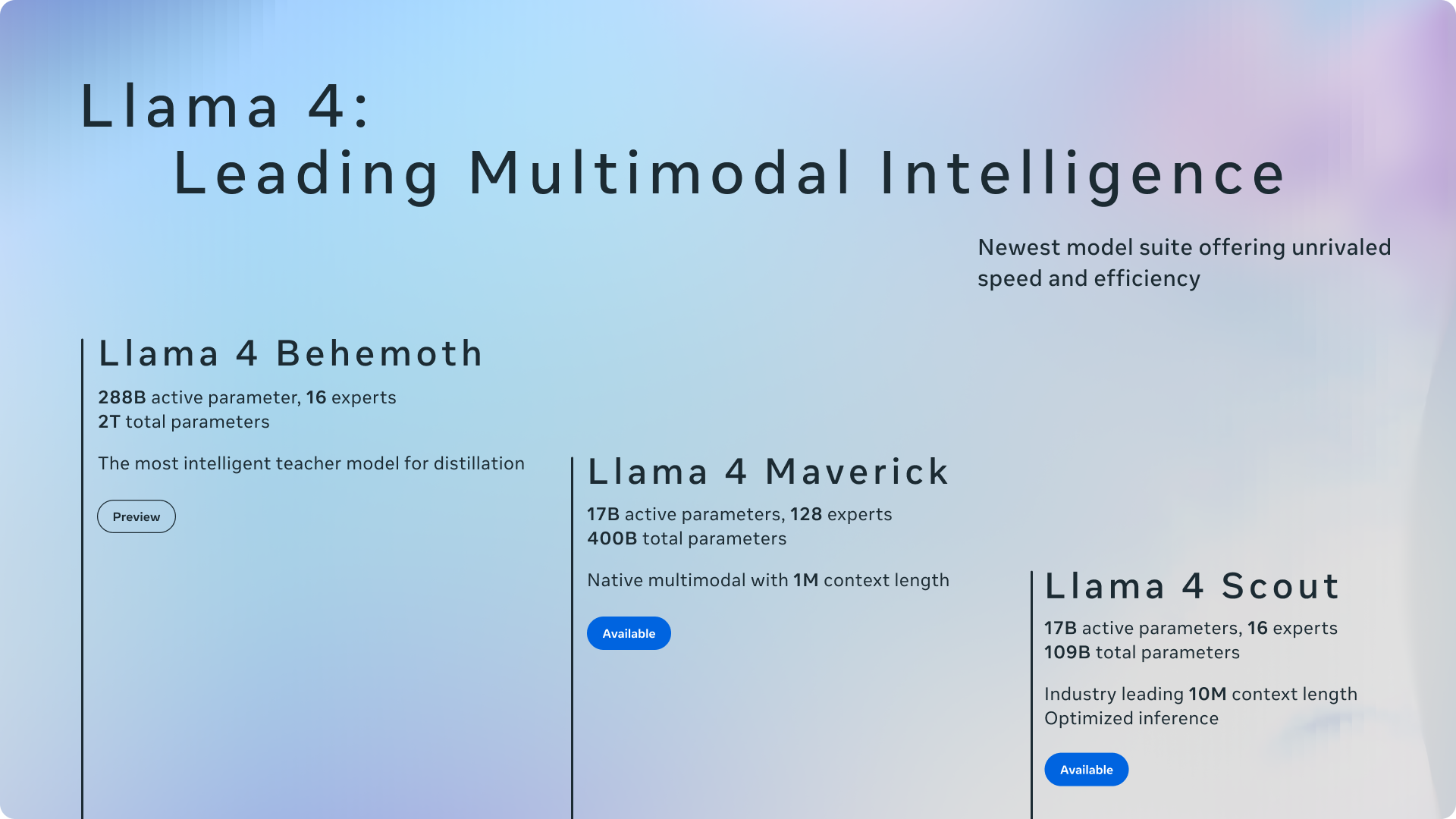

Llama 4は、Metaが開発した最新世代のLLM群で、3つのモデルを中心に構成されています。サイズ別に「Scout(斥候)」「Maverick(一匹狼)」「Behemoth(ベヒーモス=巨獣)」と名付けられました。ゲームによく登場するネーミングですね。

- Llama 4 Scout

比較的コンパクトな規模ながら、画像理解を含むマルチモーダル機能に優れ、1000万トークンという非常に長いコンテキストも扱えるのが最大の特徴です。小さめのGPUでも動作可能な設計で、モデルを使った実験やアプリ開発を気軽に始めたい方にぴったりです。 - Llama 4 Maverick

さらに多くのパラメータを備え、マルチモーダルや多言語の処理、コーディング能力などを高い水準で実現しています。格安と言われていたDeepSeek v3.1と同等かそれより安く、コストパフォーマンスにも優れており、研究用途から企業システムまで幅広い場面で活躍できる汎用的なモデルとして注目されています。 - Llama 4 Behemoth

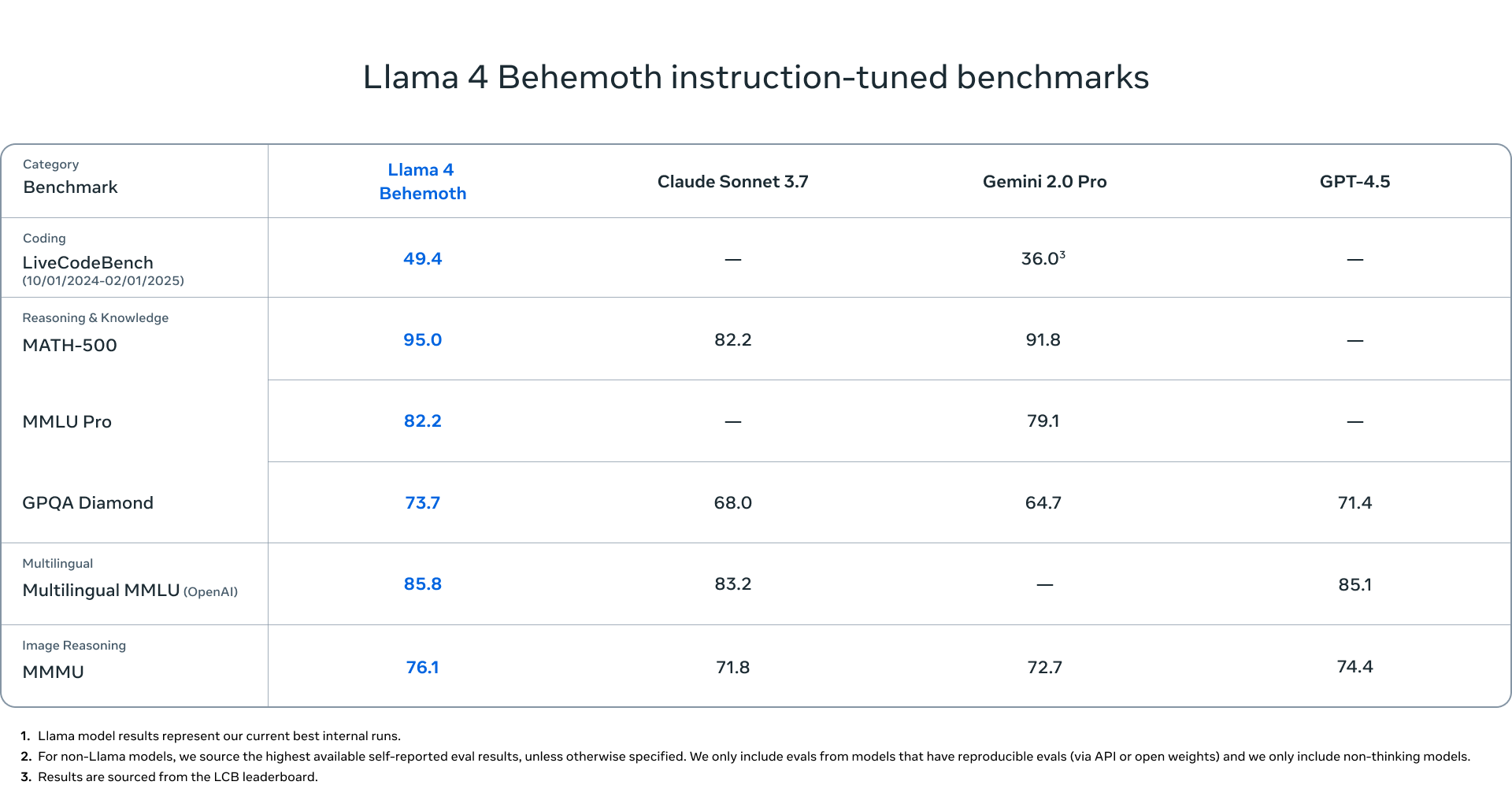

総パラメータ規模が約2兆にものぼる巨大AIモデルです。GPT-4.5やClaude 3.7、Gemini 2.0 Proといった生成AI御三家と比べても上回るスコアをたたき出しています。特に、STEM(科学・技術・工学・数学)分野の高度な課題にも対処できる性能を持っており、さらに小規模モデルへの教師モデルとしての役割も担います。現在も訓練が続けられており、その仕上がりには多くの研究者が期待を寄せています。

前世代のLlama 3シリーズと比べると、Llama 4はMixture of Experts(以下、MoE)という仕組みを活用したり、ネイティブにマルチモーダル対応を実装したりと、アーキテクチャ面で大きな進化を遂げました。また、多言語対応データが大幅に強化されているため、世界中のさまざまな言語で柔軟に利用できる点も魅力的です。

革新的なアーキテクチャと技術

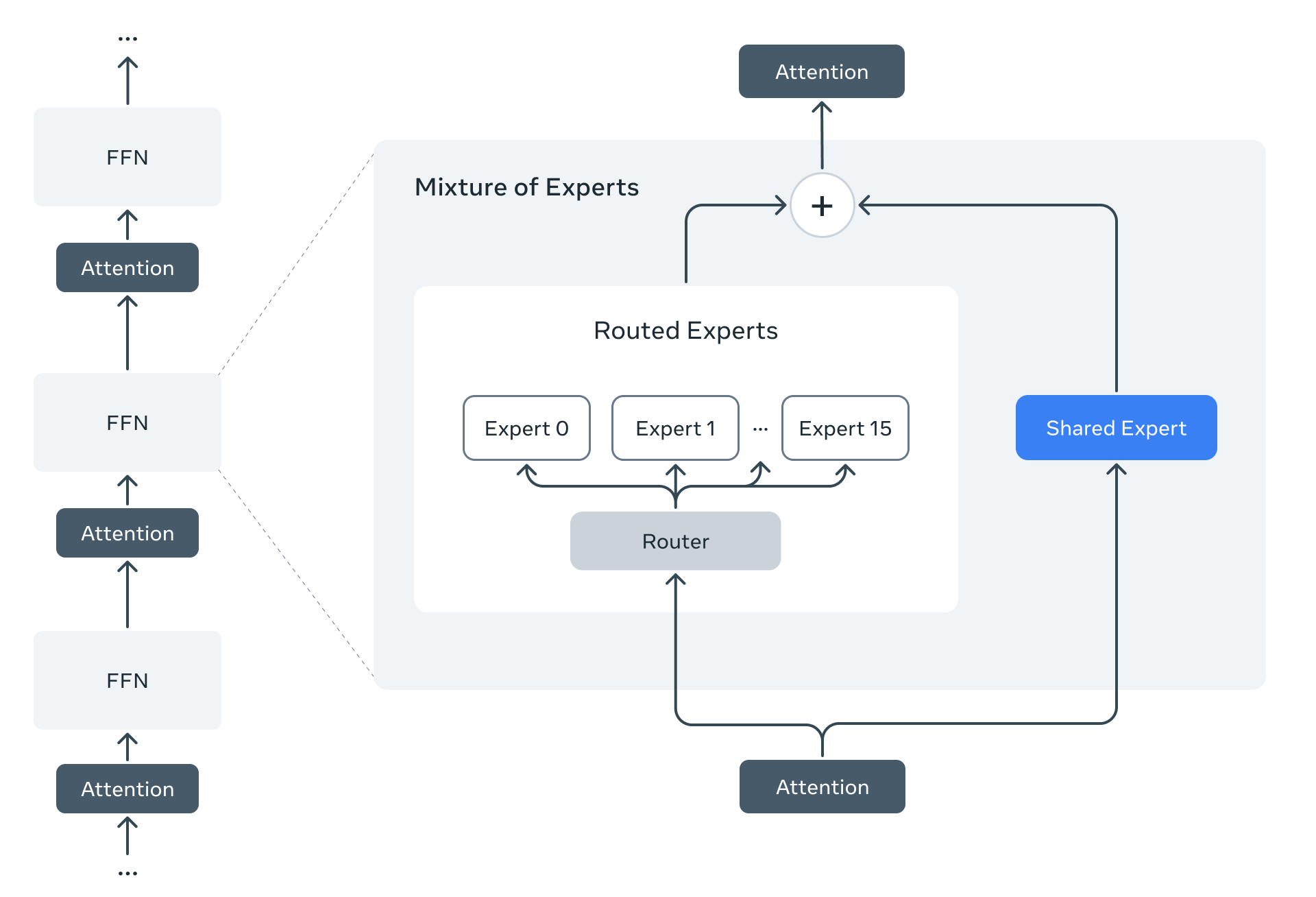

Llama 4が優れた性能を実現している背景には、いくつもの革新的な技術があります。中でも重要なのが、MoEと呼ばれるアーキテクチャです。

MoEでは、入力されるトークンをモデル内部の専門家(Experts)グループに振り分けることで、必要なパラメータだけを効果的に活性化し、無駄を減らしながら高い表現力を引き出せるように設計されています。例えばLlama 4 Maverickでは、アクティブパラメータ自体は数十億規模でも、専門家の組み合わせによって総パラメータは何百億、あるいは何千億という単位に拡張されるのです。このように必要なときだけ必要な専門家を活用する手法が、モデルの高性能と効率の両立させています。

必要な時に必要なエキスパートを動作させ効率化します。

さらにLlama 4は、テキストと画像・動画などを同時に処理する「アーリーフュージョン」を取り入れ、マルチモーダル対応を強化しています。巨大な画像データを扱う場合でも、内部ではテキストと同じくトークンとして処理できるため、推論時の一貫性が保たれ、さまざまなメディアを横断したコンテキスト理解が可能となります。異なる種類のデータが混在しても学習効果を落としにくくするための工夫として、MetaCLIPベースの改良版エンコーダを採用している点もポイントです。

加えて、「iRoPE」と呼ばれる独自のアーキテクチャによって、これまでにない巨大なコンテキストウィンドウを扱えるようになりました。これは一部の層で回転位置埋め込み(RoPE)を用いる一方、位置埋め込みを持たない層も交互に入れることで、長大なテキストでも安定した性能を発揮できるようにした仕組みです。そのおかげで、Llama 4 Scoutでは1000万トークンという膨大なコンテキストを扱いながら、文脈を見失うことなく推論を続けることができるようになりました。

前モデルの「Llama 3」は12万8000トークンだったので、Llama 4のコンテキストウィンドウがどれだで巨大かわかりますね。書籍で言うなら約100冊入ります。2~3年前は数千トークンしか扱えなかったのに、とにかくAIの技術進歩の速さには目が回りそうです。なお、Metaは無限のコンテキスト長をサポートするという長期目標を持っているそうです。

また、モデル同士で知識を共有する「コディスティレーション(共蒸留)」という技術により、たとえばBehemothのような超巨大モデルが培った知識を、小規模なMaverickやScoutに伝えることで、サイズを抑えつつ高い性能を維持することが可能になっています。これにより、研究環境や企業の導入など、さまざまな規模のシステムに柔軟に適応できるようになったのです。

高い性能と競合モデルとの比較

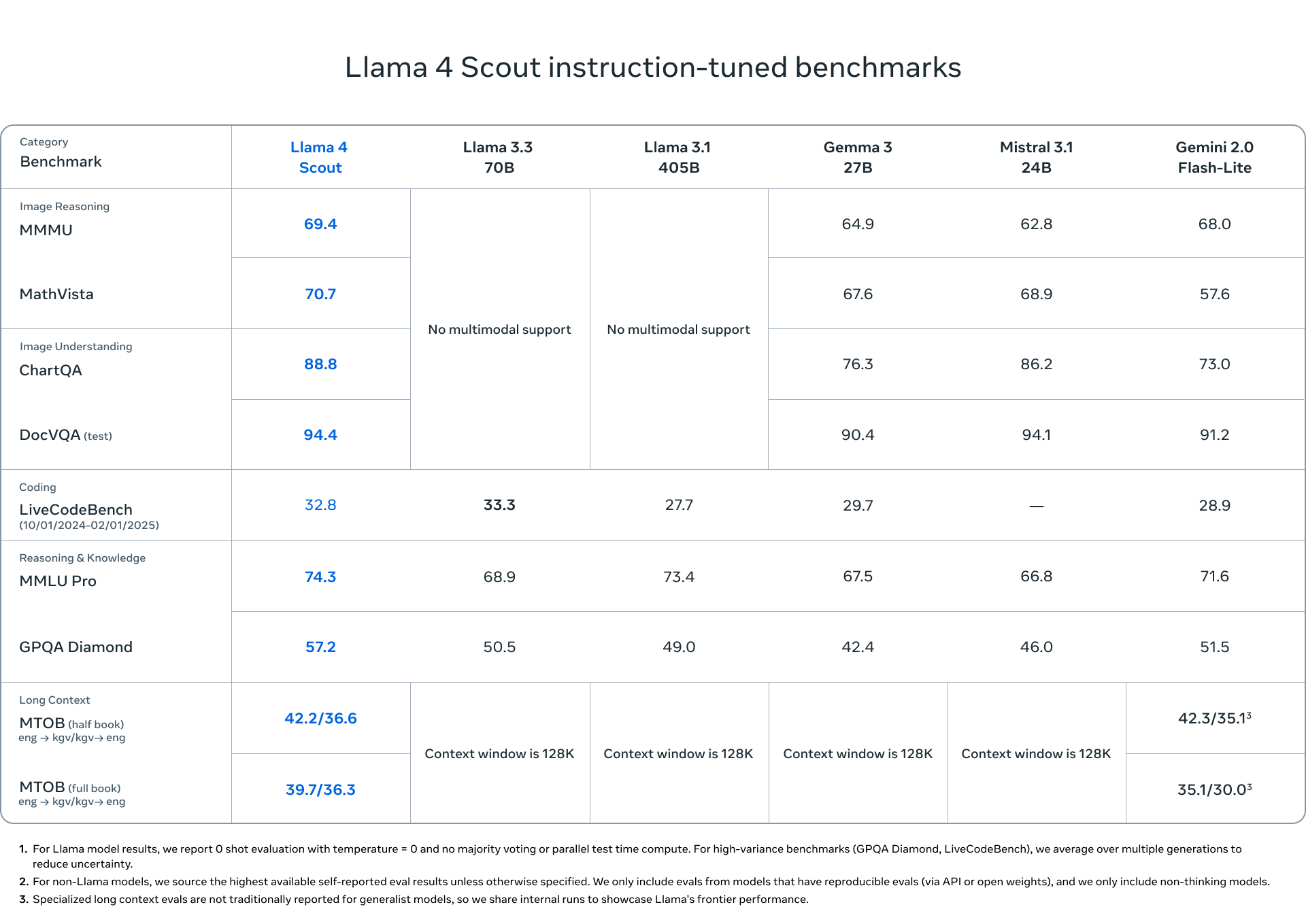

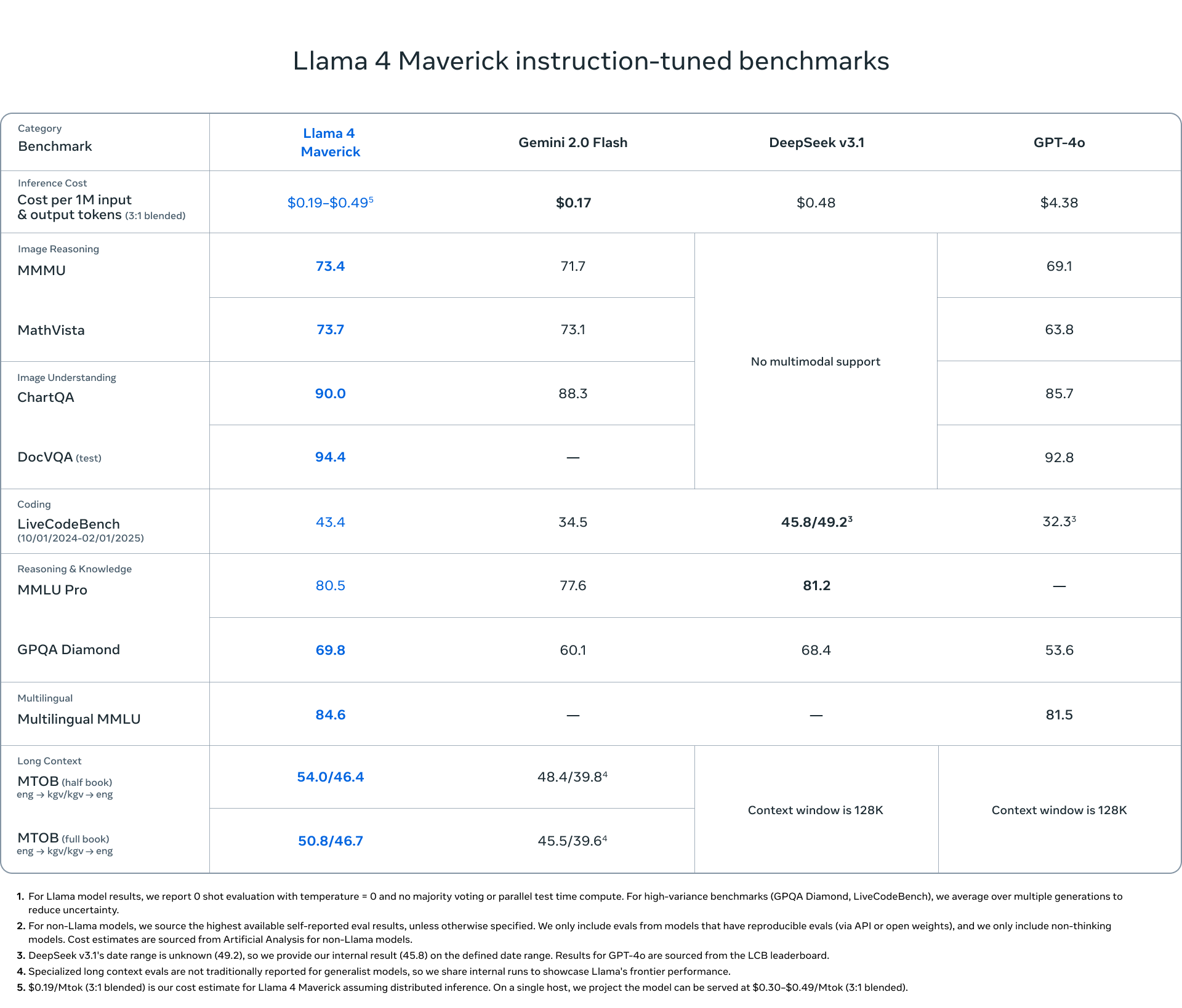

Llama 4は、そのコーディング能力や多言語処理、長い文脈への対応といった観点で、多くのベンチマークで優秀な成績を収めています。特にLlama 4 Maverickは、GPT-4系モデルやGeminiなどの有力な競合と比べても同等か、それ以上の結果を出すことが報告されています。

たとえば画像理解や視覚的質問応答に関するベンチマークでは、ScoutやMaverickが非常に高いスコアをたたき出しており、画像内の重要領域を的確に把握して、ユーザーの質問に正確かつ詳細な返答をすることが可能です。これはアーリーフュージョンを活用したマルチモーダル対応と、改善された視覚エンコーダの組み合わせによる大きな成果と言えるでしょう。

Scoutのベンチマークスコアです。

Maverickのベンチマークスコアです。

Behemothのベンチマークスコアです。

さらに、DeepSeek v3.1のような大型モデルに対しても、半分以下のアクティブパラメータ数で肩を並べる性能を見せたり、STEM系の厳しいテストでGPT-4.5やClaudeの上位モデルに匹敵するスコアを記録したりと、Llama 4は各方面で確かな実力を示しています。

また、長文のドキュメントを要約したり、膨大なソースコードを横断的にチェックしたりするときにも、最大1000万トークンのコンテキストウィンドウが非常に頼もしい存在となっています。複雑で大量の情報を扱う作業においても、必要なデータを見落とすリスクを減らせるのです。

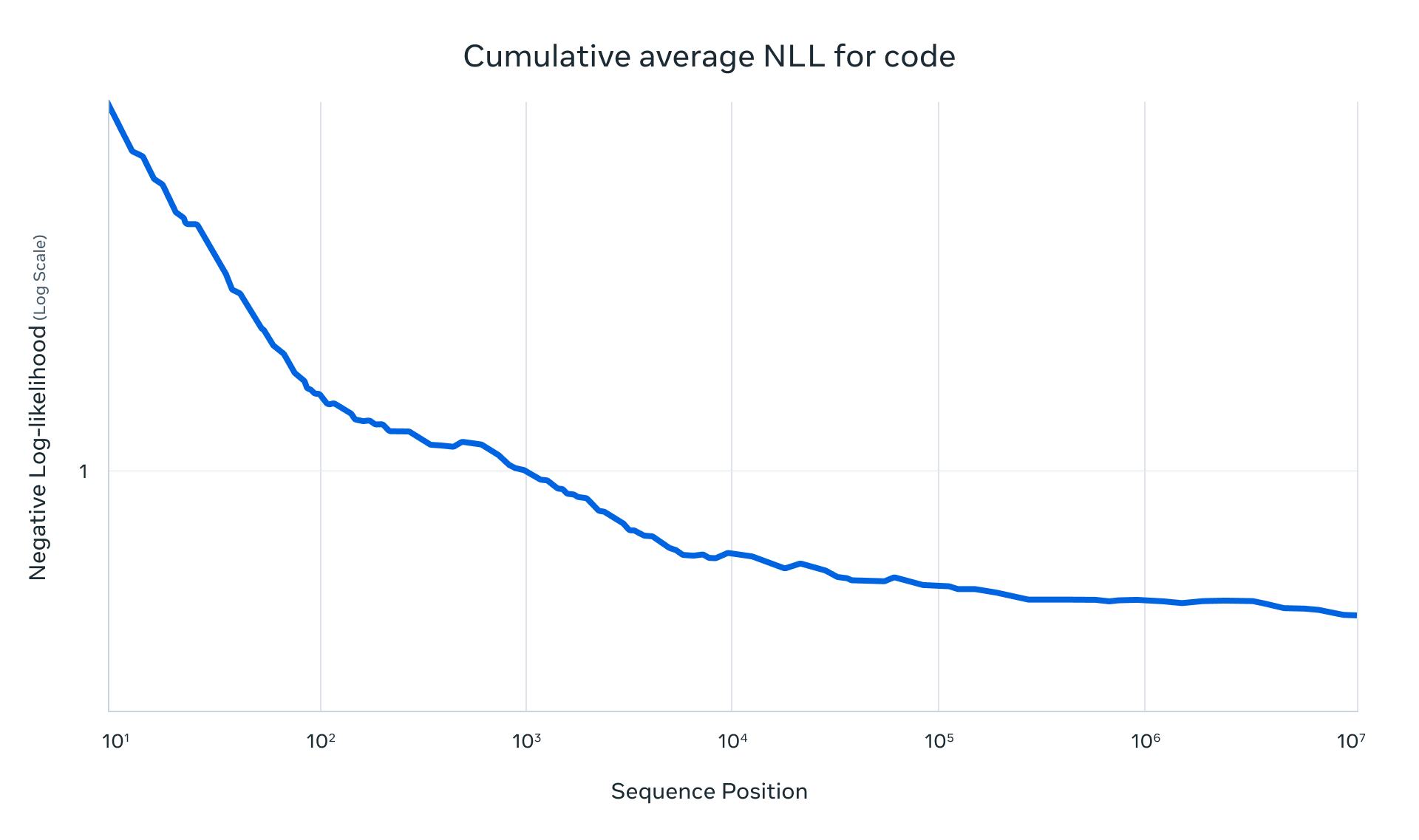

「非常に長いプログラム(コード)」を読んだときに、「次に来る単語(コード)をどれくらい上手に予測できているか?」を表すグラフが公開されていました。例えるなら、推理小説を読んでいるようなものです。読み始めの数ページでは、ストーリーがどうなるかまだ予測しにくい(グラフの左側)ですが、中盤や終盤になれば、ストーリーが見えてきて、次の展開を当てやすくなります(グラフの右側)。

AIがよりたくさんコードを読んだ後のほうが、次のコードを予測しやすくなることがわかります。

今すぐ最大6つのAIを比較検証して、最適なモデルを見つけよう!

安全性・利用方法・今後の展望

高性能なモデルであるほど、誤用やバイアスへの懸念が高まるのは当然のこと。Metaは、「Developer Use Guide: AI Protections」にまとめたベストプラクティスを軸に、安全性の向上にも力を入れています。たとえば事前学習段階ではデータフィルタリングを徹底し、事後の微調整フェーズでも安全性に配慮した追加データを使ってチューニングを行うことで、倫理的・社会的リスクを軽減する取り組みを行っています。

さらに、Llama GuardやPrompt Guardといったセーフガードツールを公開し、開発者やユーザーが有害な入力や出力を検知・ブロックしやすいよう配慮しています。

すでに、ScoutとMaverickはllama.comやHugging Faceなどで入手できます。誰でも手軽にダウンロードして試せる環境が用意されているのは、AI業界にってとても良いことだと思います。WhatsAppやInstagramなど、私たちが日常的に利用しているアプリにもLlama 4が統合され始めており、近い将来、より自然にAIと対話できるシーンが増えていきそうです。なお、Behemothはまだトレーニング中とのことで、終了したらリリースされるでしょう。

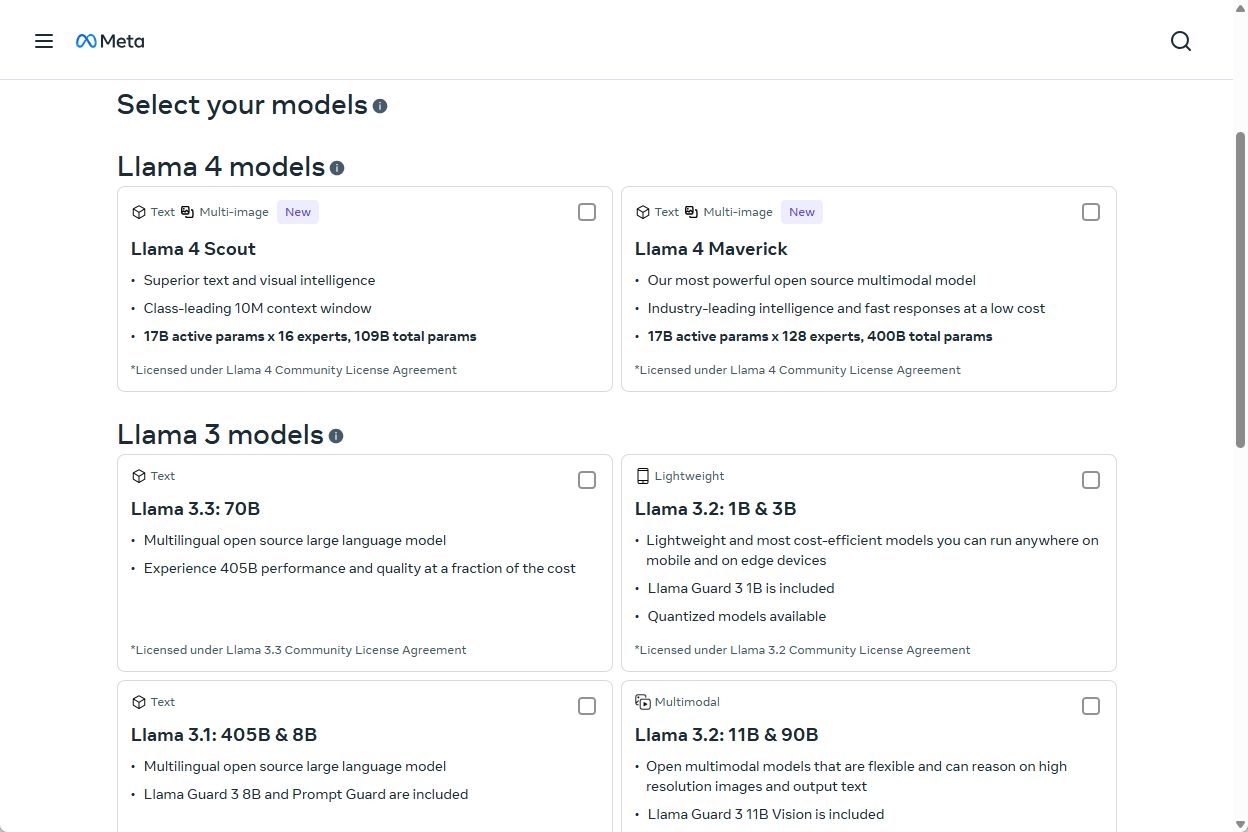

ScoutとMaverickは誰でもダウンロードできます。画面はllama.comです。

まとめ

Llama 4は、高いマルチモーダル性能と圧倒的な長文脈処理、そして安全対策を両立させた、これまでにないLLMです。Scout、Maverick、Behemothという三つのモデルが互いに支え合うことで、それぞれのニーズに合わせた柔軟な選択肢を提供してくれます。

また、オープンソースコミュニティとの連携や企業向けツールの整備も活発に進められており、最先端のAIを誰でも使えるようにする、という理想に向けた歩みを加速させています。特にBehemothを中心としたコディスティレーションや安全性対策の取り組みは、さらに洗練されていくことでしょう。

今後、Llama 4を活用したさまざまなサービスや研究開発が登場してきます。多言語での対話やコード解析、画像理解など、私たちが抱えている課題を一気に解決してくれる未来がもうすぐそこに来ています。Metaが見据える次なるAIの地平と、その先の社会変革から、ますます目が離せませんね。

この記事の監修

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。