こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

Googleが5月20日(現地時間)に開催した年次開発者会議「Google I/O 2025」は、AIの進化が私たちの日常やビジネスをいかに変革していくかをこれでもかと大胆に示す場となりました。基調講演では、「Gemini」ファミリーの最新情報や検索、Android、XR(拡張現実)、そしてクリエイティブツールに至るまで、AIを核とした数々の驚くべき発表が相次ぎました。今回は、開発者のみならず、テクノロジーに関心を持つすべての人にとって見逃せないGoogle I/O 2025のハイライトをレポートします。

「Veo 3」で生成した動画が冒頭に流れました。

Geminiの次世代AIモデルと開発者エコシステムの爆発的成長

Google I/O 2025の幕開けと共に、サンダー・ピチャイCEOが強調したのは「Geminiの時代」の本格的な到来です。GoogleはGemini時代において、かつてないスピードでAIモデルの開発と製品への統合を進めており、この1年で十数個のモデルや研究成果を発表し、20以上の主要なAI製品・機能をリリースしました。

特にGemini 2.5 Proの性能はEloスコア(AIモデルの性能指標の一つ)が前モデルから300ポイント以上も向上し、LMArenaリーダーボードの全カテゴリを席巻するほどの成果を上げています。コーディング能力も飛躍的に進化しており、WebDev arenaで第1位を獲得、主要なAIコードエディタであるCursorでは、Geminiが最も成長著しいモデルとして毎分数十万行ものコード追加を生み出している状況です。驚くべきことに、Geminiが「ポケットモンスター 青」をクリアしたというユーモラスな成果も披露され、会場がどよめきました。

このAIの進化を支えているのが、Googleのインフラです。特に、推論処理に特化して設計された第7世代TPU「Ironwood」は、前世代比で10倍の性能向上を果たし、1ポッドあたり42.5エクサフロップスという驚異的な計算能力を実現します。この強力なインフラが、高性能なAIモデルを低コストで提供することを可能にしているのです。

実際、Google製品やAPI全体でのトークン処理量は、昨年同時期の月間9.7兆から月間480兆へと、わずか1年で約50倍に増加しました。開発者コミュニティも急速に拡大しており、Gemini APIを利用する開発者はGoogle AI StudioとVertex AIを合わせて700万人を超え、これは昨年のI/Oから5倍以上の成長となります。

第7世代TPU「Ironwood」がAIインフラとして活躍しています。

Google検索の未来:AI OverviewとAIモードが情報探索を根底から変える

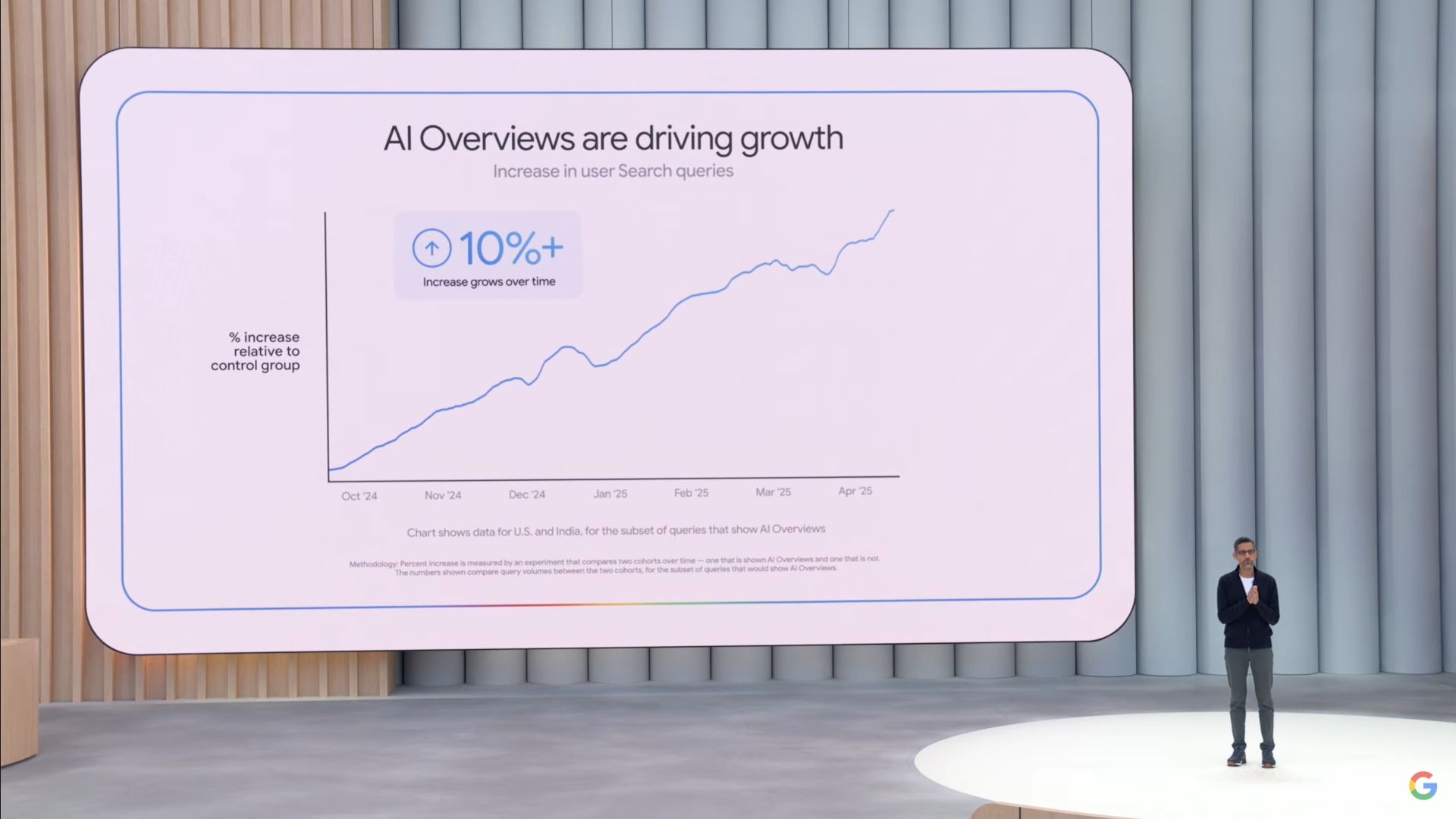

Googleの原点であり、中核事業であるGoogle検索も、Geminiの搭載によって大きな変革期を迎えています。昨年発表された「AI Overview」(日本では「AIによる概要」と表示されます)は、現在月間15億人以上のユーザーに利用され、検索結果の満足度向上と検索回数の増加に貢献しています。

特に米国やインドといった主要市場では、AI Overviewが表示されるクエリタイプで10%以上の成長を牽引しているとのことです。そして今回、Googleは検索体験をさらに進化させる「AIモード」を発表しました。AIモードは、より長く複雑な質問に対しても、Gemini 2.5の高度な推論能力を駆使して包括的な回答を生成する、全く新しい検索インターフェースです。ユーザーは従来の2〜3倍の長さのクエリを入力でき、対話形式で深掘りしていくことも可能です。このAIモードはまず、米国で提供が開始されています。日本でのローンチが待ち遠しいですね。

AIモードは「クエリファンアウト技術」という仕組みを採用しています。複雑な質問を複数のサブトピックに分解し、ウェブ全体やナレッジグラフ、ショッピンググラフ、ローカルデータなど、Googleの持つ膨大な情報源に対して同時に多数の検索を実行します。そのため、ユーザーは一度の検索で、多角的かつ質の高い情報を迅速に入手できるのです。

また、パーソナルコンテキスト機能により、過去の検索履歴やGmailの情報と連携することで、より最適化された検索結果や提案が得られるようになります。例えば、旅行の計画中に、過去の予約履歴やメールからフライト情報やホテルの場所を把握し、近隣のおすすめスポットやイベントを提案するといったことが可能になります。

AI Overviewは月間15億人以上が利用しているAI機能になっています。

多角的クエリで深層情報を引き出す「Deep Search」

「Deep Search」は、AIモードにおいて高度なリサーチを行うための拡張機能です。今夏に登場予定で、数十~数百もの小規模検索を並列実行して膨大な情報を収集・分析することで、最適化された回答を作り出してくれます。一般的な検索ではユーザーの質問に対し一度にまとめて結果を返すのが通常ですが、「Deep Search」では回答を検証する過程でも追加の検索を自動的に繰り返し、情報の抜け漏れや内容の裏付けを補完する仕組みが組み込まれています。より広範かつ深い領域を横断的にリサーチして、完成度の高いレポートを短時間で得られる点が従来の検索手法とは大きく異なる点です。

たとえば、歴史的事件や複雑な学術分野に関する課題を調査する際、「Deep Search」を使えば従来なら何時間もかけて自力で探し集める情報を、数分程度で収集し、統合して提示してくれます。検索結果をリアルタイムに再検証してくれるので、一度のリクエストで多面的な視点や引用元へのリンクまでがまとめられるのも便利です。

単なる回答にとどまらず、検証のプロセスや論拠も含めて提示するこの仕組みは、学術論文や高度な技術資料などを参照する場面で特に重宝されそうです。

カメラ視点と会話型検索を融合したライブアシスタント「Search Live」

「Search Live」は、「Project Astra」が生み出したライブ対話技術を検索体験に組み合わせることで実現した新たな機能です。従来のカメラ検索や音声入力といったインターフェースをさらに拡張し、ユーザーが映している映像をリアルタイムで解析しながら検索エンジンと対話を行う点が大きな特長といえます。

たとえば、自宅での工作や勉強でわからない部分をカメラ越しに映すだけで、その映像を即座に理解し、疑問点を会話形式で掘り下げることが可能になります。いわば「今、目の前にあるもの」を取り込みつつ検索と連動するため、ユーザーは直感的に「映して、話しかける」という流れで知りたい情報を得られるのです。

また、Project Astra由来の高精度な物体認識や画面共有能力を引き継ぎ、必要に応じてウェブサイトや動画の内容を即座に要約・翻訳する機能も備えています。たとえば、海外の料理動画を再生しながら詳しい調理手順を聞きたい場合や、複雑なDIYプロジェクトで専門用語を調べたい場合でも、「Search Live」であれば実際の映像やツールを見せながら会話を続けられます。

しかも、単なる回答にとどまらず、関連する参考情報を随時取り込んで提案する姿勢はまさにライブアシスタントそのものであり、従来の検索の枠を超えた新しい体験が期待されます。

カメラに映っている映像を元にリアルタイムに会話できるようになります。

Geminiアプリの進化:パーソナルAIアシスタントとクリエイティブ機能の融合

「Gemini」アプリが単なる生成AIチャットツールから、真にパーソナルでプロアクティブ、そしてパワフルなAIアシスタントへと進化を遂げるというビジョンも示されました。

その核となるのが「パーソナルコンテキスト」の深化です。ユーザーが許可すれば、Geminiはカレンダーやマップ、Keep、TasksといったGoogleアプリの情報と連携し、ユーザーの予定や好みを理解した上で、先回りしてサポートしてくれるようになります。例えば、試験前に過去のノートや資料からパーソナライズされたクイズを生成したり、ユーザーの興味に合わせて特定のトピックを解説するカスタムビデオを作成してくれるのです。

「Gemini Live」機能は、カメラと画面共有機能が無料で提供されるようになり、より自然でインタラクティブな会話体験を実現します。45以上の言語に対応し、150以上の国と地域で利用可能です。

「Deep Research」機能では、ユーザーが自身のファイルをアップロードして分析対象に加えられるようになり、近くGoogle DriveやGmail内の情報も横断的に検索できるようになります。「Canvas」は、Geminiとの共同作業スペースとしてさらに進化し、アップロードしたレポートを元に、ウェブページ、インフォグラフィック、クイズ、さらには45言語対応のポッドキャストまでワンタップで生成できます。

ブラウザ拡張機能「Gemini in Chrome」も発表され、ウェブページの内容を理解し、要約や質問応答をデスクトップで手軽に行えるようになりました。

Geminiアプリが試験前にミニクイズを出してくれるデモが披露されました。

Imagen 4とVeo 3──生成系モデルの新次元へ

画像生成の分野で大きく進化した「Imagen 4(イマジェン・フォー)」と、動画生成の限界を塗り替える「Veo 3(ヴェオ・スリー)」は、本年度のGoogle I/Oにおいて強い衝撃を与えました。

ともにマルチモーダル性能を大幅に高め、ユーザーが思い描くイメージを驚くほど高精度かつスピーディに表現してくれます。コードやテキストの補完と同様、画像や映像そのものをAIが直接生成できるようになったことで、クリエイターからビジネスユーザーまでが手軽にビジュアルのアウトプットを生み出せる点は、今後の制作現場を大きく変える可能性を秘めています。

Imagen 4は、従来の画像生成モデルを超える新機能として、文字要素の自然な埋め込みに対応しました。ポスターやグラフィックデザインなど、文字とビジュアルを融合させる表現を際立たせたい場面で力を発揮します。たとえばバンドのフライヤーを作成する場合、テキストのフォントや配置をAIが自動的に最適化し、クリエイターの作業負荷を大幅に軽減できます。背景との一体感を保つための配色や文字装飾の微調整も、高度な判断ロジックが加わり、視覚的に読みやすく美しいレイアウトを一瞬で完成させます。

スピードも向上しており、以前のバージョンより10倍速く生成結果を返せる軽量版「Imagen 4 Lite」も、多くのアイデアを試したいユーザーにとって大きな魅力となるでしょう。

大きく性能が向上した画像生成AI「Imagen 4」。

Veoシリーズは動画生成AIとしてすでに高い評価を得てきましたが、最新版となるVeo 3ではさらにリアルな動きと臨場感を実現しました。最大の特徴は、映像だけでなくキャラクターの音声や環境音なども同時に作り出せる点です。

たとえば森のシーンを生成する場合、葉が触れ合う音や動物の足音、さらには登場人物のセリフまでも一緒に生成でき、映像と音響が密接にリンクした世界観を作り上げます。映画監督や映像クリエイターが求める水準に近いクオリティを、短時間かつ少人数で創り出せることは、映像制作プロセス全体の効率化をもたらすと期待されています。

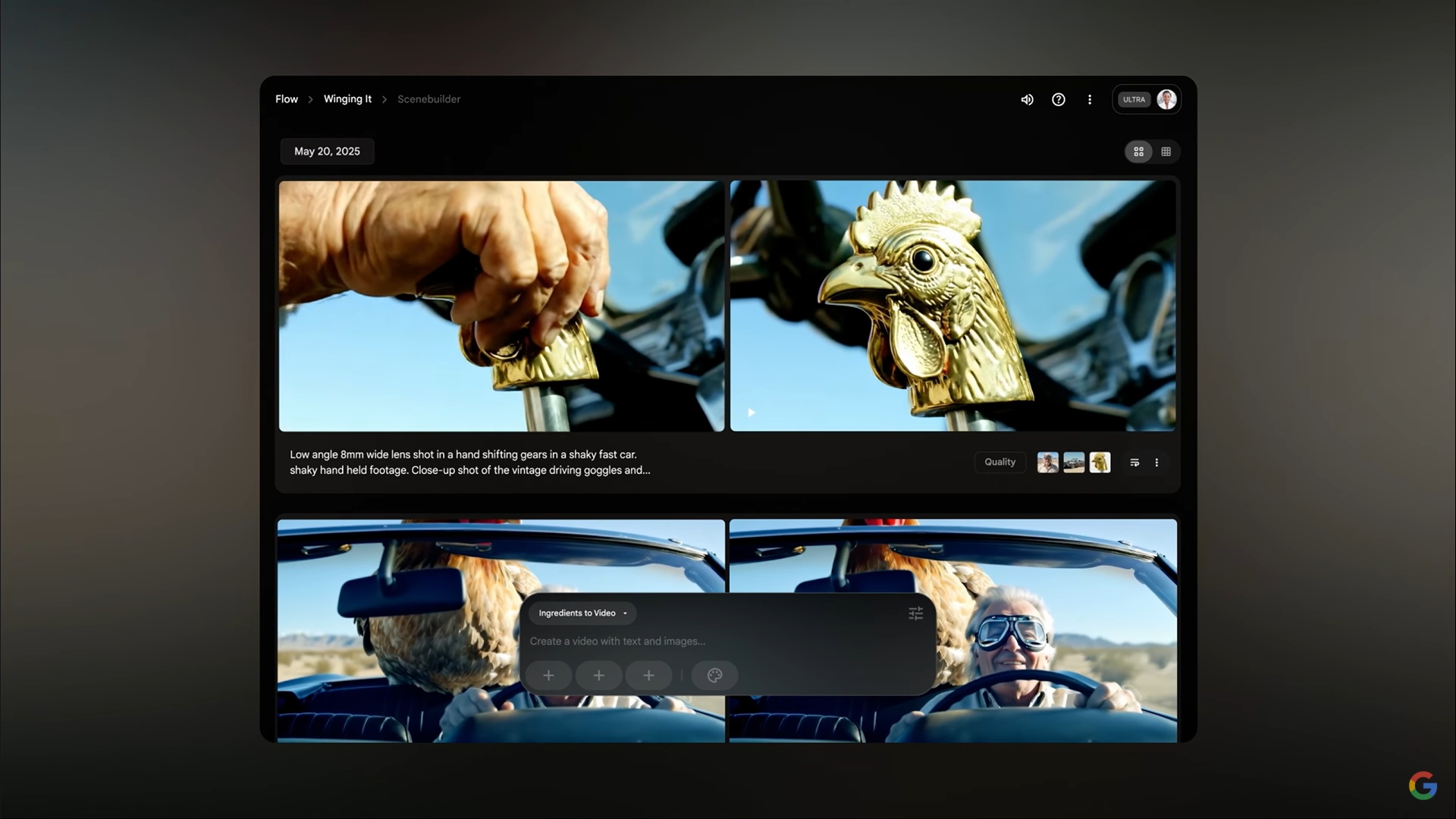

Googleが目指す今後の展開として、これらの高性能モデルを誰もが直観的に扱えるツール「Flow」に組み込み、テキスト命令だけでアニメーションのカメラワークやキャラクター演出を指定できる環境を整えつつあります。

Imagen 4とVeo 3を活用した複雑な表現も容易になるため、クリエイターの発想がさらに広がるでしょう。ショートフィルムや音楽映像といったジャンルの作品づくりにも革新をもたらす両モデルが、今後どのように一般ユーザーやプロの映像作家に浸透していくのか、大きな注目を集めそうです。

実際に短いカットをつなぎ合わせて映像作品を作り上げるデモが公開されました。

AIと物理世界の融合:AndroidエコシステムとXRが切り拓く新たな体験

AIの進化は、スマートフォンやPCの画面内にとどまらず、私たちが活動する物理世界との連携を深めています。Google I/O 2025では、Androidエコシステム全体へのGeminiの展開と、XR(拡張現実)分野における野心的な取り組みが発表されました。

Android 16やWear OS 6といった次期OSのアップデートに加え、Geminiはスマートフォンだけでなく、スマートウォッチ、自動車のダッシュボード、テレビなど、あらゆるAndroidデバイスに搭載され、状況に応じたサポートを提供するようになります。

特に未来を感じさせたのが、Gemini時代に最適化された初のXRプラットフォーム「Android XR」の発表です。Android XRは、ヘッドセットからメガネ型デバイスまで、様々なフォームファクタに対応し、没入感のある体験から日常的な情報アシストまで、幅広く活用できます。

基調講演では、Samsungとの協業による初のAndroid XRデバイス「Project Moohan」が紹介されました。この組み合わせで、無限に広がるスクリーンでアプリを利用したり、Googleマップで世界中をテレポートしたり、MLBアプリでスタジアムの最前列にいるかのような観戦体験をすることが可能になるのです。

サムスンがProject Moohanというコードネームで開発しているXRヘッドセットです。

さらに、Googleは長年研究開発を続けてきたメガネ型デバイスの進化も披露しました。Android XRを搭載したメガネは軽量で日常的な装着を想定しており、カメラやマイク、スピーカー、そしてオプションのインレンズディスプレイを備えています。

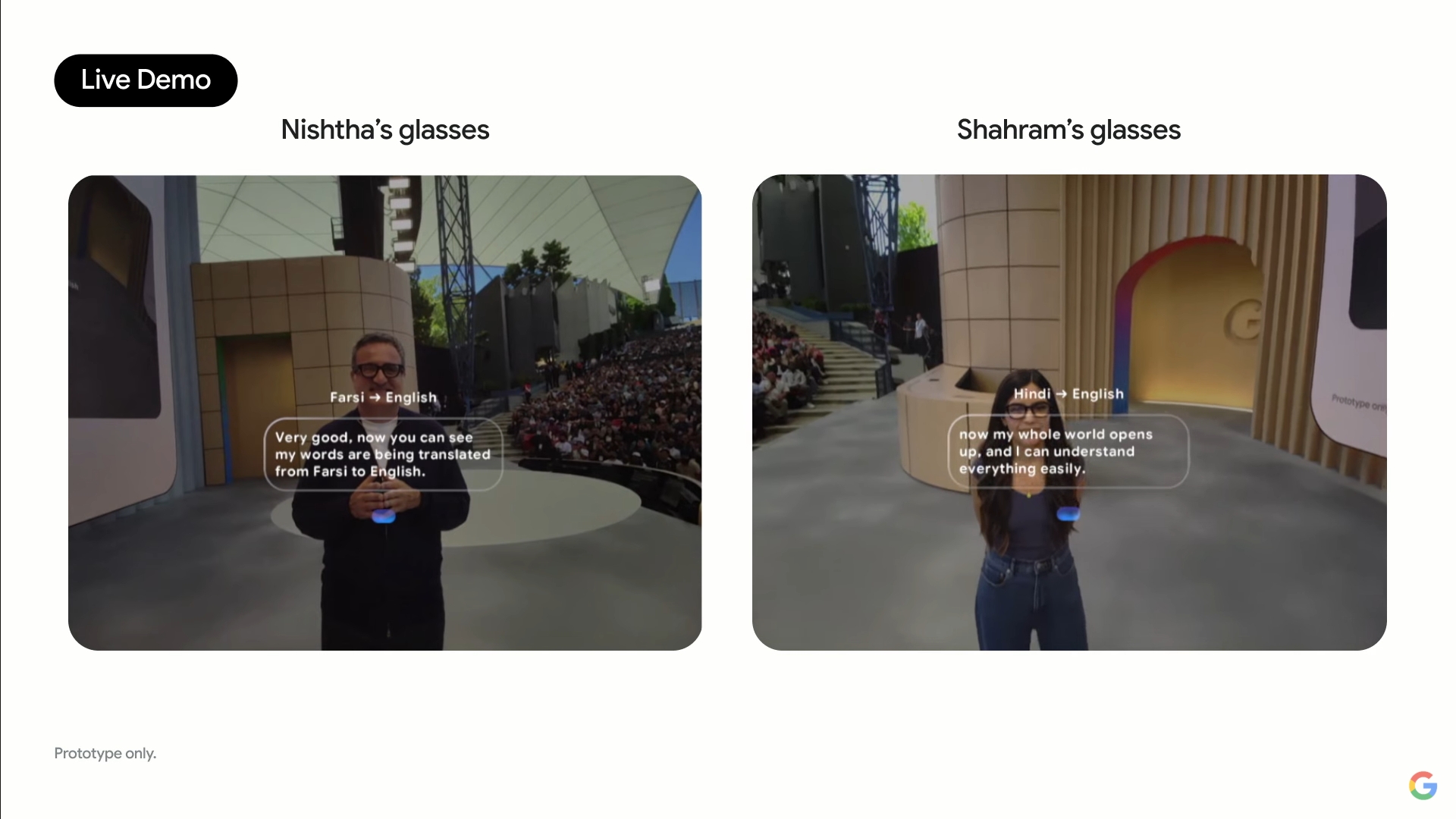

デモンストレーションでは、メガネを通して見えるものをGeminiが認識し、質問に答えたり、テキストメッセージを送信したり、リアルタイム翻訳を行ったりする様子が示されました。このAndroid XRグラスの開発には、新たにGentle MonsterやWarby Parkerといったアイウェアブランドもパートナーとして参画することが発表され、スタイリッシュで実用的なAI搭載グラスの登場が期待されます。

お互いにXRグラスをかけた状態で異なる言語で会話し、同時翻訳しているデモが行われました。

AIが加速させるイノベーションとより良い未来への貢献

Google I/O 2025は、AI技術の目覚ましい進化と、それが私たちの生活や社会に与えるインパクトの大きさを改めて浮き彫りにしました。基盤となるGeminiモデルの性能向上から、検索、パーソナルアシスタント、クリエイティブツール、そしてXRデバイスに至るまで、AIはあらゆる領域でイノベーションを加速させています。

Googleは「世界の情報を整理し、世界中の人々がアクセスできて使えるようにする」というミッションを掲げていますが、AIはこのミッションを実現するための強力なエンジンとなりつつあります。開発者やクリエイター、そして一般ユーザーがこれらの新しいAIツールを手にすることで、どのような新しい価値が創造され、どのような未来が拓かれるのか、期待は尽きません。

今回の発表は、AIが単なる便利なツールではなく、私たちの知性や創造性を拡張し、より豊かで便利な社会を実現するための不可欠なパートナーとなる未来を予感させるものでした。

この記事の監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。