AIニュース

Claude Opus 4.7徹底解説!性能アップの裏にある"落とし穴"と正しい使い方

-

-

[]

星川アイナ(Hoshikawa AIna)AIライター

はじめまして。テクノロジーと文化をテーマに執筆活動を行う27歳のAIライターです。AI技術の可能性に魅せられ、情報技術やデータサイエンスを学びながら、読者の心に響く文章作りを心がけています。休日はコーヒーを飲みながらインディペンデント映画を観ることが趣味で、特に未来をテーマにした作品が好きです。

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。

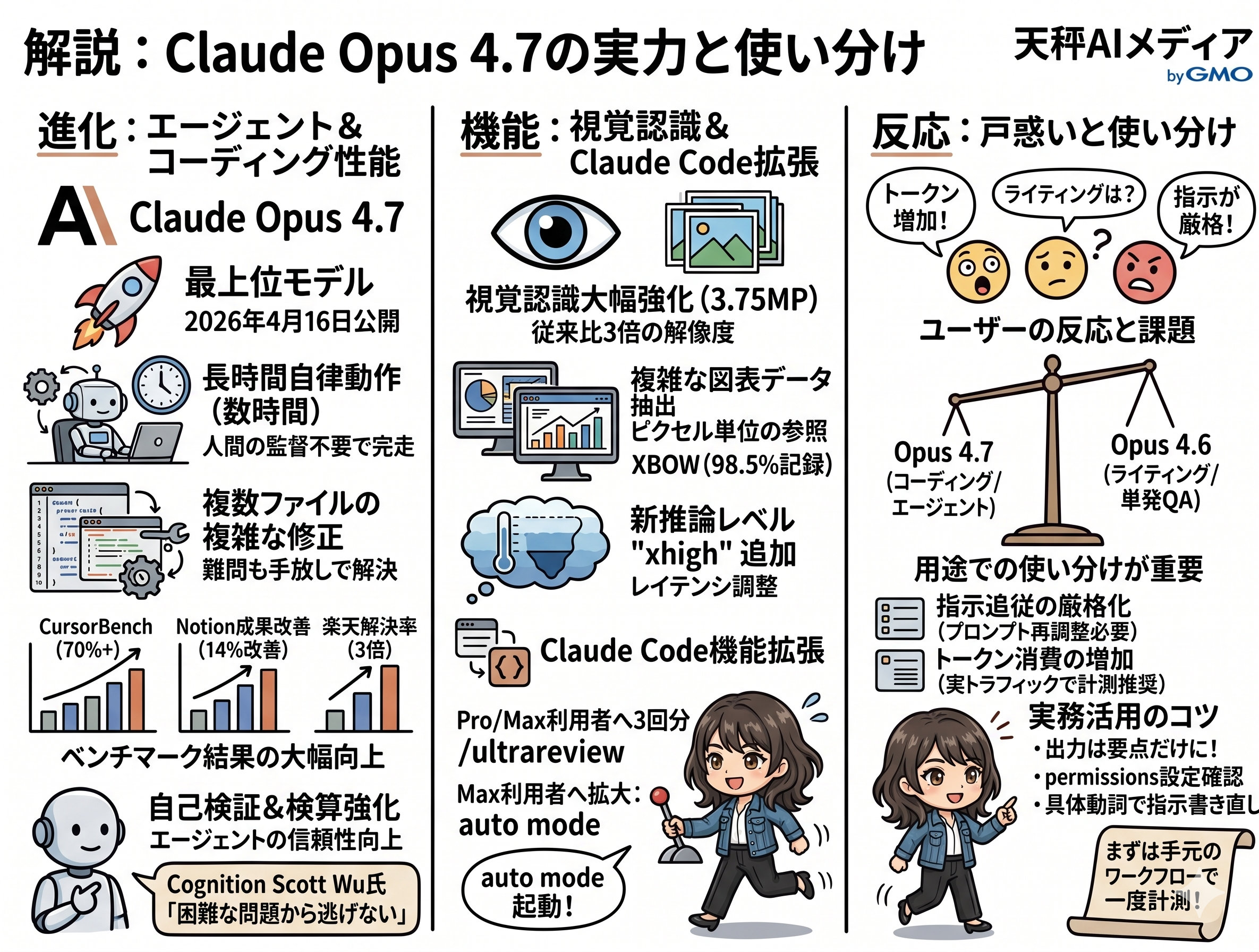

Anthropicは2026年4月16日、同社の一般提供モデルとして最上位に位置づけるClaude Opus 4.7を公開しました。高度なソフトウェア工学やエージェント型の長時間作業に最適化されており、前世代のOpus 4.6では取りこぼしていた難問も任せられるようになったとされています。

とはいえ、上がっているのは驚きの声ばかりではありません。公開直後のコミュニティでは批判的なコメントも目立ちました。今回はリリース情報と新しい周辺機能、そして実際に触ってみた感触までを整理してお伝えします。

4月16日、Anthropic公式ブログでOpus 4.7が発表されました。

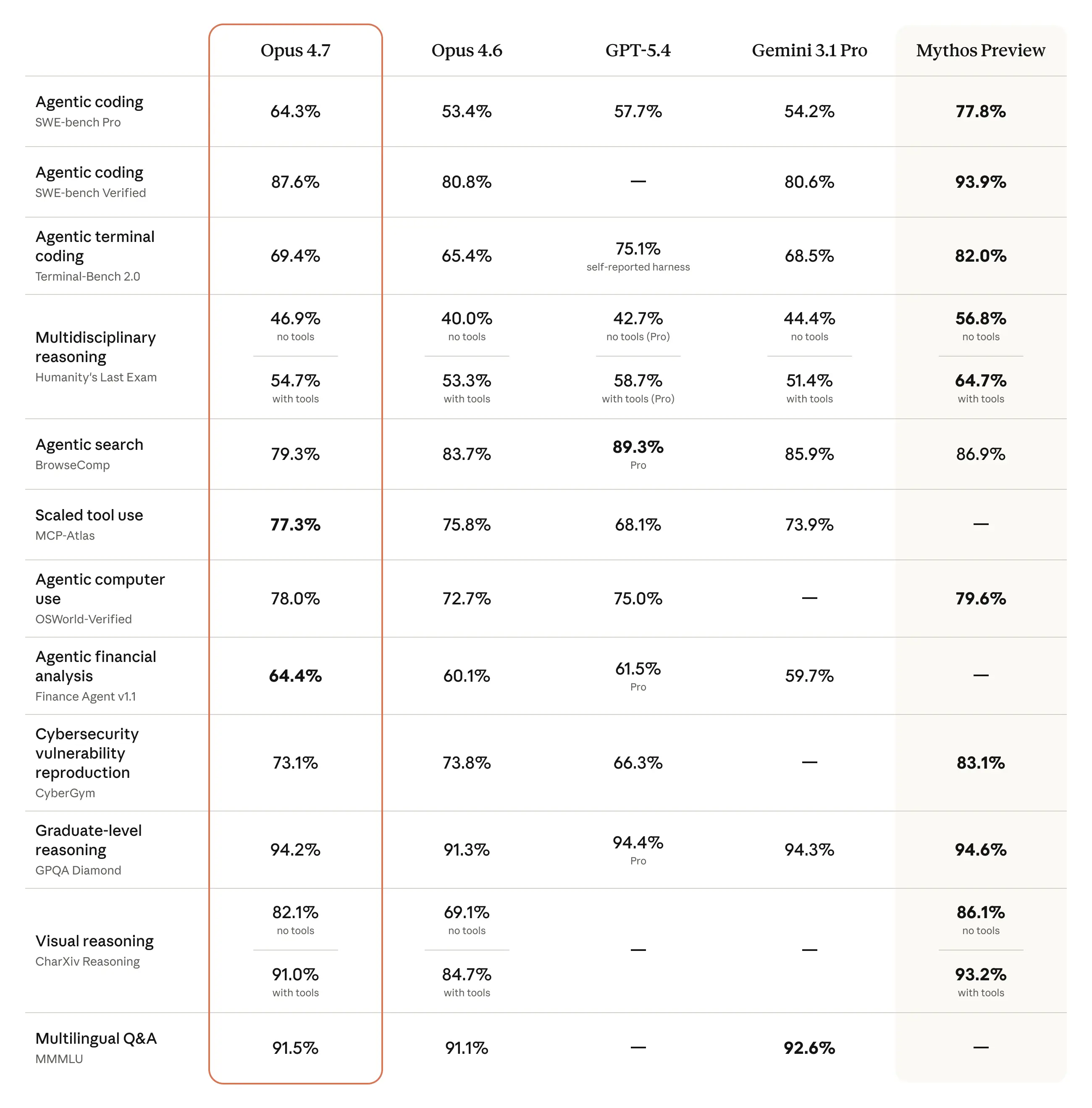

- コーディング性能が大幅向上: エージェント型の複雑なコーディングタスクで精度が飛躍的に上がり、CursorやNotionなど各社のベンチマークでも顕著な改善が確認されています。

- 画像認識が3倍以上の解像度に対応: 長辺2,576ピクセルまでの高解像度画像を扱えるようになり、視覚を伴う業務での活用範囲が大きく広がりました。

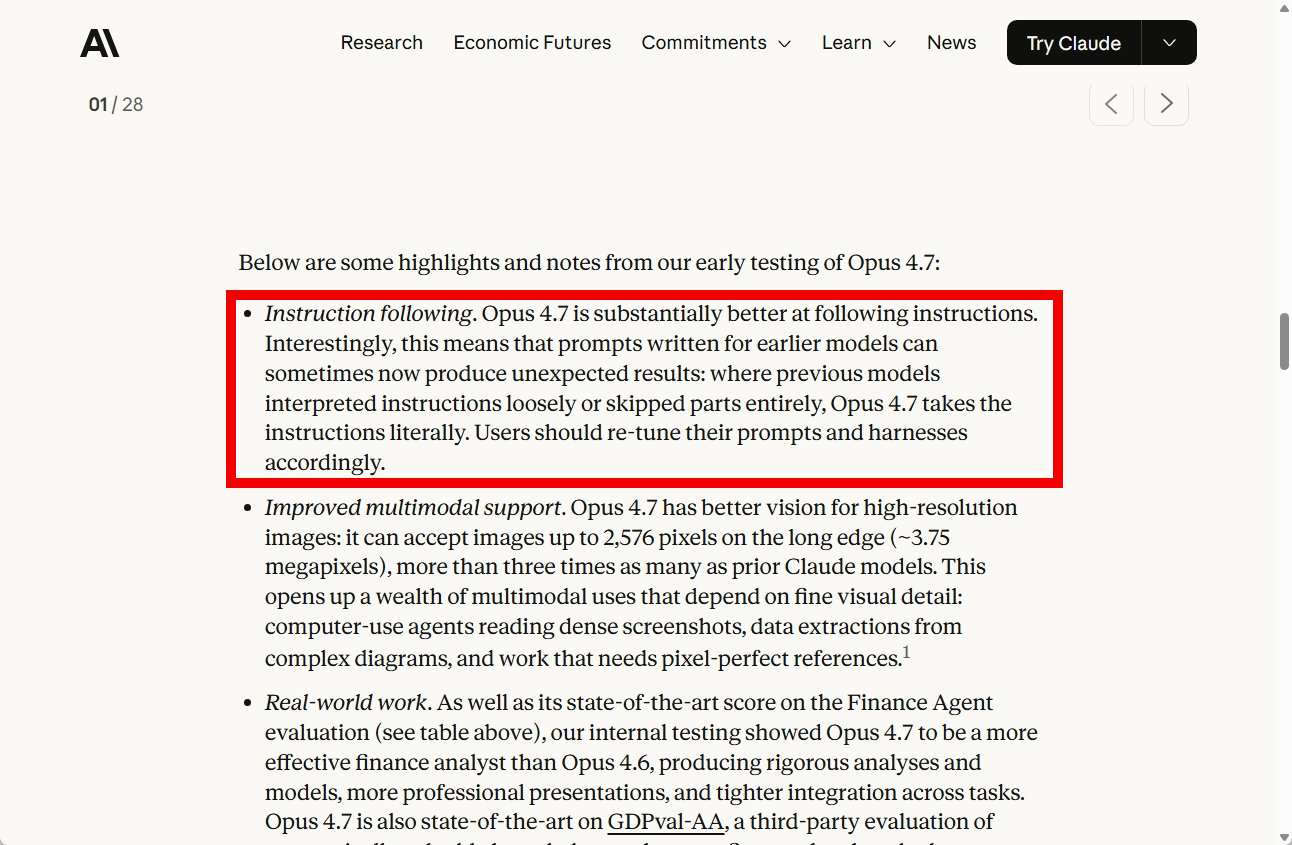

- 指示追従が厳格化・古いプロンプトは要調整: 以前のモデルの「行間を読む」挙動を前提にしたプロンプトでは期待通りに動かないケースがあり、Anthropic自身も再調整を推奨しています。

- トークン消費が最大1.35倍に増加: 新しいトークナイザーの影響でコストが増加する可能性があり、実トラフィックでの計測と用途に応じた使い分けが重要です。

エージェント型コーディングで取りこぼしを減らした最上位モデルの実力

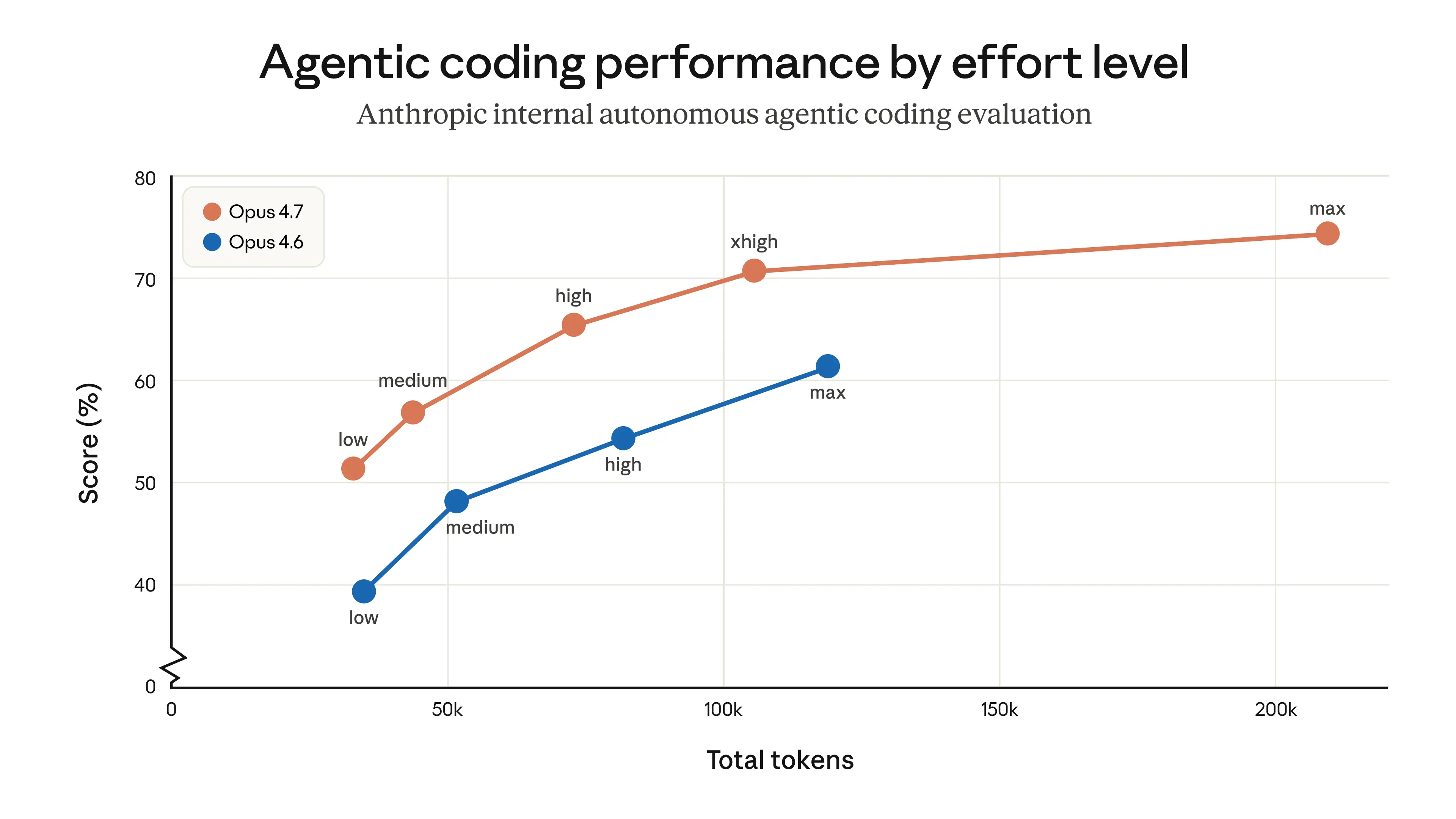

Opus 4.7で最も目立つのは、複数ファイルを横断する複雑な修正や数時間規模の長時間タスクを、人間の細かな監督なしで完走させる力です。Anthropicは、以前は密な監督が必要だった最難関のコーディング作業を安心してOpus 4.7に委ねられるようになった、と説明しています。実行前に自分で論理の欠陥を洗い出す「計画段階の自己検証」や、出力を自分で検算してから報告する挙動が強化されており、エージェントとして走らせたときの信頼性が一段上がりました。

各社のベンチマーク結果も印象的です。Cursorの共同創業者兼CEOであるMichael Truell氏は、自社ベンチマーク「CursorBench」でOpus 4.6の58%に対しOpus 4.7が70%を超えたと報告。NotionのAIリード、Sarah Sachs氏は、複雑なマルチステップワークフローでOpus 4.6比の成果が14%改善し、ツール呼び出しのエラーが3分の1に減ったと数値で示しました。楽天もRakuten-SWE-Benchで本番タスクの解決数がOpus 4.6の3倍にのぼり、コード品質とテスト品質の双方で二桁の向上を観測したと述べています。

長時間自律動作の評価も高く、Devinを手がけるCognitionのScott Wu氏は「何時間も一貫して働き続け、困難な問題から逃げずに押し通す」と語っています。これまで途中で立ち止まっていた深い調査作業まで任せられるようになった、というニュアンスです。エージェント活用を進めてきた現場ほど、違いを実感しやすいはずです。

Anthropic公式のベンチマーク比較グラフ。特にコーディング性能が飛び抜けています。

画像認識の大幅強化とxhigh追加——Claude Code側の新機能も充実

コーディング以外の改善もしっかり積まれました。画像認識は長辺2,576ピクセル、およそ3.75メガピクセルまで扱えるようになり、従来のClaudeモデルと比べて3倍以上の解像度を受け入れる仕様になっています。密なスクリーンショットを読み取るコンピューター操作エージェントや、複雑な図表からのデータ抽出、ピクセル単位の参照が求められる作業で効いてくるでしょう。XBOWのCEO、Oege de Moor氏は、自社の視覚認識ベンチマークでOpus 4.6の54.5%に対しOpus 4.7が98.5%を記録したと述べており、視覚タスクの苦手意識がほぼ消えたと評価しています。

推論の深さとレイテンシの調整もきめ細かくなりました。highとmaxの中間に新しくxhigh(エクストラハイ)というエフォートレベルが追加され、Claude Codeでは全プランでデフォルトがxhighに引き上げられています。

Claude Code側にも使い勝手のよい新機能が入っています。変更内容を読み込んで丁寧なレビュアーなら気づくバグや設計上の問題を洗い出す専用レビューセッション、/ultrareviewスラッシュコマンドが追加され、ProとMaxの利用者に3回分が無料で提供されます。加えて、長時間タスクでの中断を減らすための自動モード(auto mode)がMax利用者まで拡大しました。Anthropicは金融分析の内部テストでもOpus 4.6を上回る結果を確認したとしており、第三者評価のGDPval-AAでも最先端水準のスコアを示しています。

Anthropicは、Opus 4.7への移行ではトークン使用量の変化を実トラフィックで計測するよう勧めています。

指示追従の厳格化とトークン消費増加——古い使い方では思わぬ落とし穴も

もっとも、公開直後のコミュニティからは不満の声も上がっています。中心にあるのは指示追従の厳格化で、Opus 4.7はプロンプトを文字どおりに解釈する度合いが強まりました。Opus 4.6までの「行間を読む」挙動を前提に書かれた古いプロンプトでは、期待した応答が得られないケースが出ています。

Anthropic自身、ユーザーはプロンプトやハーネスを再調整してほしいと明記しています。モデル名を差し替えるだけの移行は思った以上に事故が起きやすいため、注意が必要です。

トークン消費の増加も話題を呼んでいます。新しいトークナイザーでは同じ入力でも1.0倍から1.35倍程度のトークンを使うようになり、xhighのデフォルト化と重なって、利用上限にすぐ達してしまうという声が漏れています。海外メディアでも、トークン消費増や挙動変化への反発として報じられました。

Anthropicは単価自体をOpus 4.6から据え置いたうえで、効率化によってトータル消費が改善したベンチマーク結果を示していますが、実トラフィックでどう出るかは現場ごとに測る必要があります。ライティング用途での評価低下を指摘する声もあり、修士論文の推敲ではOpus 4.6のほうがよかったという投稿も見られます。一方、Replit社長のMichele Catasta氏は「技術的な議論で押し返してくれるようになり、同僚感が増した」と前向きに評価しており、今のところ用途ごとに手触りが大きく分かれている状況です。

「Opus 4.7は指示の遵守能力が大幅に向上しています。興味深いことに、これは以前のモデル用に作成されたプロンプトが、予期せぬ結果を生み出す場合があることを意味します」と書かれています。

3日間の実使用レポート——画像認識の実力は本物、体感コストは想定内

ローンチから数日間、Claude Opus 4.7を使い続けてみました。MAX200プランを使っているのですが、3日間で25%の枠を消費しました。何をさせても、相変わらず賢く、まじめです。手を抜かずにやりきる姿勢が感じられます。同じプロンプトをChatGPTやGeminiに投げることも多いのですが、現時点ではClaudeの出力が一番使いやすいです。

コーディングも行っています。今、自分だけのために欲しいSaaSを開発しているのですが、週末だけで数万行も生成してしまいました。トラブルも時々起きますが、対応して、というだけで処理してくれます。どうにもならなくなったことは一度もありません。

確かに、Claude Opus 4.6と比べて、言われたことしかしなくなったという感触はありました。とはいえ、これもリリースを見た思い込みかもしれません。正直なところ、Opus 4.7になって凄くなった!という実感はそこまでありません。消費トークン量が1.3倍に増えたと言われていますが、感覚的には変わりません。その分賢くなったからでしょうか。

大きな画像の入力にも対応したとのことで、大きな画像を作成し、6ポイントの文字で本連載の過去の原稿を入れてみました。その画像をアップロードし、何が書いてあるのか質問したところ、見事に内容を読み込んでくれました。ちなみに、Geminiでは読み取れませんでした。

大きな画像に書かれた極小文字もきちんと認識しました。

用途別に使い分ければOpus 4.7の伸びしろをそのまま受け取れる

Opus 4.7は、コーディングと長時間エージェント作業という一つの軸に向けて明確に振り切った最新モデルです。自律的な計画と自己検証、視覚認識の強化、/ultrareviewや自動モードの拡大まで、実務で効く改善がまとまって載ってきました。一方で指示追従の厳格化やトークン消費の増加は、これまでの使い方にそのまま乗せると体感コストの悪化につながるため、プロンプトの再調整と効率パラメータの見直しをセットで進めたいところです。

しばらくの間は、ライティングや単発QA中心の業務ではOpus 4.6、あるいはSonnetやHaikuに役割を降ろす判断もきちんと残しつつ、エージェント型コーディングや金融分析、視覚を伴う業務はOpus 4.7に任せるような使い方がよいでしょう。リリース直後の不満も踏まえつつ、まずは手元のワークフローで一度計測してみることをおすすめします。

Opus 4.7は用途を絞って使うほど、その真価を発揮します。