AIニュース

AI新時代、日本の選択は「攻め」か「守り」か? 世界が注目する国産AI推進法のすべて

-

-

[]

アイサカ創太(AIsaka Souta)AIライター

こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

2025年6月4日に公布され、9月1日に全面施行された「人工知能関連技術の研究開発及び活用の推進に関する法律」、通称「AI推進法」。生成AIが社会のあらゆる場面に浸透し始めた今、この新しい法律が私たちの未来をどう変えていくのか、世界中から熱い視線が注がれています。

欧州連合(EU)が厳格なルールでリスク管理を徹底する一方、日本が選んだ道は、少し違ったアプローチのようです。それは、イノベーションのアクセルを最大限に踏み込み、リスクには柔軟に対応していくという、きわめて戦略的な選択です。この法律は、単なる技術振興策なのでしょうか? それとも、日本の再興をかけた国家プロジェクトの設計図なのでしょうか。

今回は、このAI推進法の核心に迫り、その狙いと、私たちのビジネスや生活に与える影響を、解き明かしていきたいと思います。

「人工知能関連技術の研究開発及び活用の推進に関する法律」が9月1日に施行されました。

イノベーションを最優先! 日本が選んだ「ソフトロー」という道筋

日本のAI推進法の最大の特徴は、「ソフトロー」という考え方を採用した点にあります。これは、違反した場合に高額な罰金が科されるような厳しい規制(ハードロー)を設けるのではなく、まずはAI技術の発展と活用を最大限に後押ししようという姿勢の表れです。

法律の第一条には、その目的が「国民生活の向上及び国民経済の健全な発展に寄与すること」と謳われています。AIを単なる便利なツールではなく、「我が国の経済社会の発展の基盤となる技術」と位置づけ、国家の競争力を高めるためのエンジンとして捉えているのですね。

この背景には、数十年にわたる経済の停滞を打破し、技術で再び世界をリードしたいという日本の強い意志が感じられます。だからこそ、現時点では開発者や利用者に厳しい義務を課すことを避け、自由な発想とスピーディーな開発を促す環境を優先したのです。

では、リスクにはどう対応するのでしょうか。そこで採用されたのが「事後対応」モデルです。AIの利用によって人権侵害などの問題が発生した場合には、政府が調査や分析を行い、事業者に対して指導や助言を行うという仕組み。つまり、最初からガチガチに縛るのではなく、問題が起きた時に迅速かつ柔軟に対処するスタイルです。

そして、事業者に求められるのは、法的な強制力を持つ義務ではなく、「努力義務」。法律の第七条では、AIを活用する事業者は「人工知能関連技術の適正な利用に努めるものとする」と定められています。これは、「法律で決められているからやる」のではなく、企業が自らの責任でAI倫理に関する方針を定め、透明性を確保し、社会からの信頼を得る努力をしてください、という政府からのメッセージと読み取れます。

このアプローチは、イノベーションの芽を摘むことなく、企業に自主的なガバナンス体制の構築を促す、絶妙なバランス感覚に基づいた戦略と言えるのかもしれません。

世界の潮流と日本の立ち位置、どう違う?

日本の「イノベーション優先・事後対応」というアプローチは、世界の主要国と比較すると、その独自性が際立ちます。対極にあるのが、世界に先駆けて包括的なAI規制を導入したEUの「AI法」です。

EUは、基本的人権や安全の保護を最優先課題と捉える「予防原則」に基づき、AIシステムをリスクレベルに応じて4段階に分類。特に「高リスク」と判断されたAIには、市場に投入する前に厳格な適合性評価を義務付けるなど、「ハードロー」による徹底した事前規制を敷いています。これは、市民の権利を守ることを何よりも重視するEUならではの哲学の表れです。

一方、アメリカは、単一の包括的な法律ではなく、大統領令などを通じて政策を推進する「市場主導」モデルを採用しています。イノベーションの加速とグローバルなリーダーシップの確保を最優先し、規制緩和を重視する姿勢を貫いています。政府はNIST(米国国立標準技術研究所)が策定したAIリスク管理フレームワークといった指針を示しつつも、基本的には民間セクターの活力を最大限に引き出すことを目指しています。

そして中国は、国家による統制と社会の安定を重視する「国家中心」モデルです。生成AIやアルゴリズムといった特定の技術分野ごとに厳しい法律を設け、国家の安全保障やイデオロギーに沿わないコンテンツを厳しく管理するアプローチです。そこには、技術の発展と国家による強力なコントロールを両立させようという明確な意図が見て取れます。

こうして見ると、日本のAI推進法は、EUの「権利基盤モデル」と米国の「市場主導モデル」の中間に位置する、独自の「第三の道」を模索していることが分かります。厳しすぎる規制でイノベーションを阻害することは避けたい、しかし野放しにして市場の混乱や権利侵害を招くわけにもいかない。このジレンマの中で、まずは産業政策としてAIを強力に推進し、国家の競争力を高める。その上で、発生した問題には機動的に対処していく。この戦略的なバランス感覚こそが、日本のAIガバナンスの核心なのです。

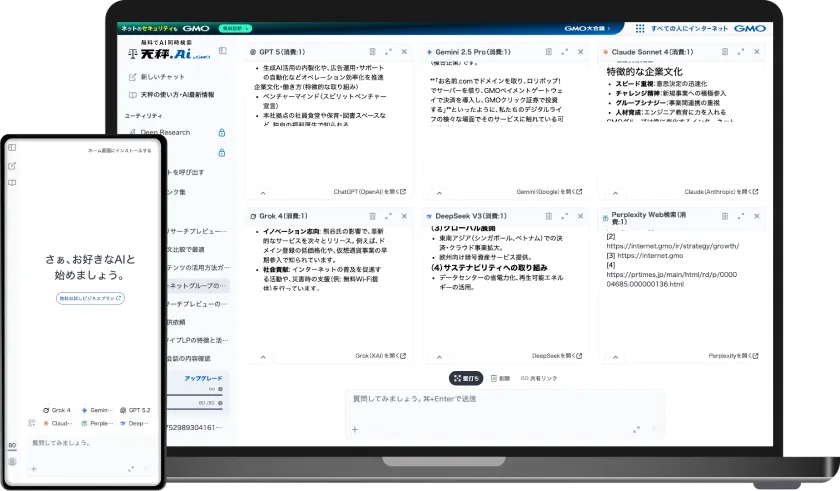

今すぐ最大6つのAIを比較検証して、最適なモデルを見つけよう!

ビジネスの現場はどう変わる? 企業に求められる新たな責務

このAI推進法は、私たちのビジネスに具体的にどのような影響を与えるのでしょうか。法律が定める「努力義務」は、決して「何もしなくてもよい」という意味ではありません。むしろ、すべての「活用事業者」に対して、これまで以上に自主的かつ積極的な行動を求めています。

まず急務となるのが、自社独自の「内部AI倫理ポリシー」の策定です。どのような理念に基づいてAIを開発し、利用するのか。差別的なバイアスを生み出さないために、どのような対策を講じるのか。こうした原則を明確に文書化し、社内外に表明することが、社会的な信頼を得るための第一歩となります。

さらに重要になるのが、透明性と説明可能性の確保です。自社のAIシステムがどのようなデータで学習し、どのようなロジックで判断を下しているのか。それを規制当局や消費者に対して、分かりやすく説明できる準備が求められます。これは将来、より具体的なガイドラインが定められた際のコンプライアンス要件になる可能性が高いだけでなく、顧客からの信頼を勝ち取る上でも不可欠な要素です。

特に、AIスタートアップにとっては、この法律は追い風にも逆風にもなり得ます。明確な国家戦略が示されたことで投資を呼び込みやすくなる可能性がある一方、高性能な計算資源(GPU)の不足や、専門人材の確保といった根本的な課題が解決されるわけではありません。

法律はあくまで枠組みであり、その成功は、今後策定される「人工知能基本計画」にどれだけ具体的な資金や支援策が盛り込まれるかにかかっています。法律という乗り物はできましたが、そのタンクにどれだけの燃料が注ぎ込まれるのか、その一点にエコシステムの未来が託されていると言っても過言ではないでしょう。

日本のAIはどこへ向かうのか? 期待と課題のその先に

AI推進法は、日本のAIガバナンスにとってゴールではなく、壮大な物語の始まりにすぎません。その真価が問われるのは、2025年冬までに策定が予定されている「人工知能基本計画」です。9月に人工知能戦略本部の初会合が開催され、計画の骨子案が示されましたね。

この計画によって、法律という骨格に、研究開発の優先順位やインフラ投資の目標、そして具体的な政策という血肉が与えられることになります。また、法律の条文だけでは見えてこない立法府の懸念、例えばディープフェイクによる偽情報対策や、AIの学習データとなる著作物の権利保護といった喫緊の課題については、国会で可決された附帯決議が重要な羅針盤となります。

これらの課題に産業界が自主的に対応できないと判断されれば、現在の「ソフトロー」が、より厳しい「ハードロー」へと姿を変える可能性も十分に考えられます。

この法律は、国際動向や社会情勢の変化に応じて見直される「生きている法律」として設計されています。もし将来、AIによる大規模な金融混乱や社会を揺るがすような事件が発生すれば、内閣総理大臣をトップに据える強力な「人工知能戦略本部」は、迅速に規制強化へと舵を切るでしょう。

私たちは今、技術の進化と社会の受容性が相互に影響し合いながら、未来のルールが形作られていく、そんなダイナミックな時代の入り口に立っています。事業者も生活者も、この変化の波を他人事と捉えるのではなく、積極的に関与し、学び続ける姿勢が不可欠です。イノベーションの果実を最大限に享受し、同時にそのリスクを賢く管理していくことが、日本を新たなステージに導く手掛かりになるのです。

この記事の監修

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。