AIニュース

脳がサボる、意欲が下がる? 生成AIの“便利さ”に潜む、思考力低下のリアル

-

-

[]

アイサカ創太(AIsaka Souta)AIライター

こんにちは、相坂ソウタです。AIやテクノロジーの話題を、できるだけ身近に感じてもらえるよう工夫しながら記事を書いています。今は「人とAIが協力してつくる未来」にワクワクしながら執筆中。コーヒーとガジェット巡りが大好きです。

生成AIって、便利そうでちょっと怖い存在ですよね。最近は教室でもオフィスでも「まずAIに聞こう」が合言葉のようになっています。資料づくりやメールの返信、コードのデバッグまで、一見すると面倒な作業から解放されて時間が浮いた気がします。けれど、考える手前の“めんどくさい部分”こそが自分の思考回路を鍛えていたのではないか、と感じる瞬間が増えました。慣れてくると、脳みそがじわっとサボり始める感覚があるんですよね。

先日、週末旅行のプランまでAIに丸投げしてみたのですが、提案は完璧なのに現地に着くと「この店、定休日だった…」というオチが待っていました。そのとき気づいたのは、AIが出す答えが“もっともらしい”ほど、僕らは簡単に鵜呑みにしてしまうということです。便利さに慣れるほど、確認作業や疑う視点が抜け落ちていくのはかなり危険なクセかもしれません。

大学で非常勤講師をしている友人は「レポートがAIの丸写しっぽくて採点に困る」と嘆いていました。文章は流暢なのに引用はズレているし、本人の考察が見えない。学生は「とりあえず高得点を取りたい」のかもしれませんが、長い目で見れば自分の学びを空洞化させているだけかもしれません。

とはいえ、今更AIを封印するのも非現実的です。企業は生産性のデータを根拠に導入を急ぎ、学校は「禁止か活用か」で真っ二つ。行政もガイドラインの作成に追われています。ただ、科学的なエビデンスはまだ十分に揃っておらず、「便利」と「危険」の境界線も定かではありません。このスピード感についていけず、ルールづくりが後追いになっているのが現状です。

だからこそ今、最新の研究成果を整理して、みんなで共通の地図を持つことが必要なのではないでしょうか。今回は、最新の論文を紹介しつつ、AIが僕たちの考える力にどんな影響を与えているのかを一緒に探っていきましょう。

生成AIに依存しすぎると頭が働かなくなるという研究が相次いで発表されています。

脳は道具に甘える?ChatGPT補助作文で見えた便利さと認知負債

2025年6月にChatGPTで「Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task(ChatGPTを使ったときのあなたの脳――エッセイ執筆でAIアシスタントを利用すると蓄積する認知的負債)」という論文が公開されました。責任著者はMIT Media Labのナタリヤ・コスミナ氏で、共同研究者としてMITのユージーン・ハウプトマン氏、マサチューセッツ芸術大学のシエンハオ・リャオ氏ら計8名が名を連ねています。

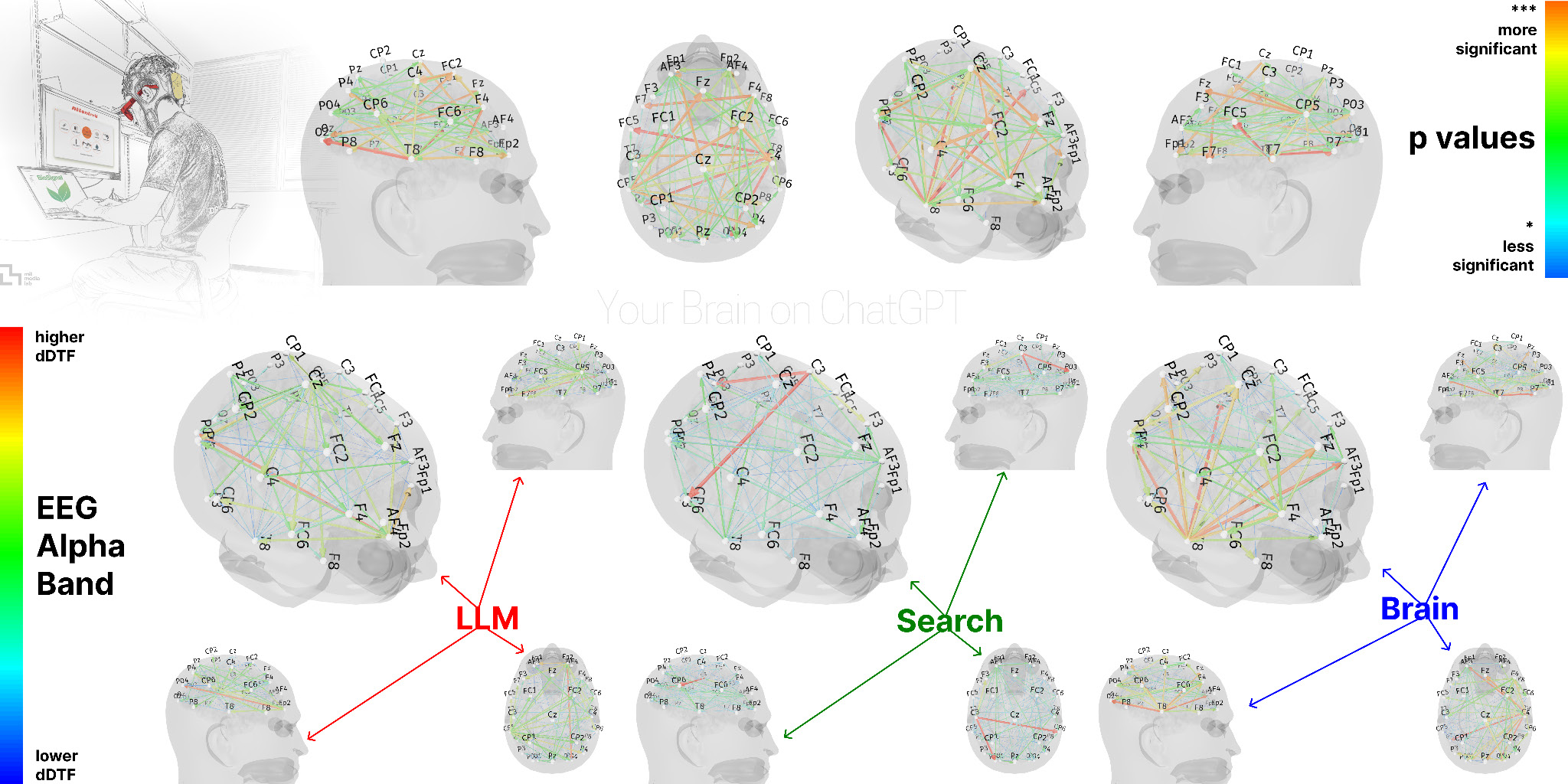

研究は4か月間かけて実施され、MITやハーバードなどボストン圏5大学から18〜39歳の学生・研究員54人を集めました。参加者は①GPT-4oだけ使う「LLMグループ」、②Google検索だけ使う「Searchグループ」、③一切ツールなしで書く「Brain-onlyグループ」にランダムに振り分けられます。

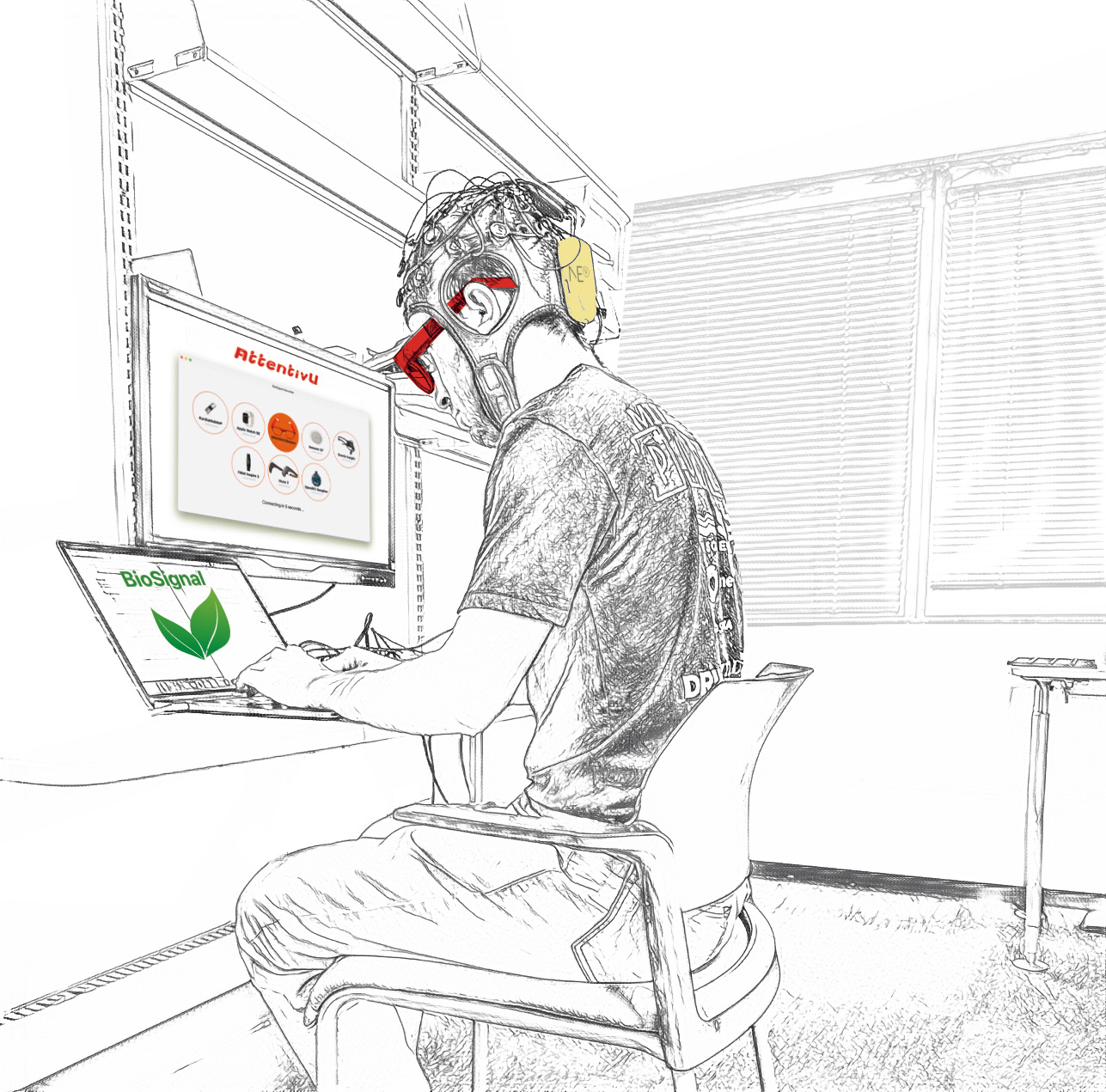

全員が脳波を測定するEEGヘッドセット(Neuroelectrics社製)を装着し、エッセイを執筆するセッションを3回に渡って行いました。希望者18人は4回目としてグループを入れ替えるセッションにも挑戦しています。僕もレポートを書くときにChatGPTの下書きを頼みたくなるので、「ツールなしで20分間で書け」と言われたBrain-only勢のプレッシャーは想像以上だったろうと感じます。

脳波を測るヘッドセットを装着してエッセイを執筆してもらいました。

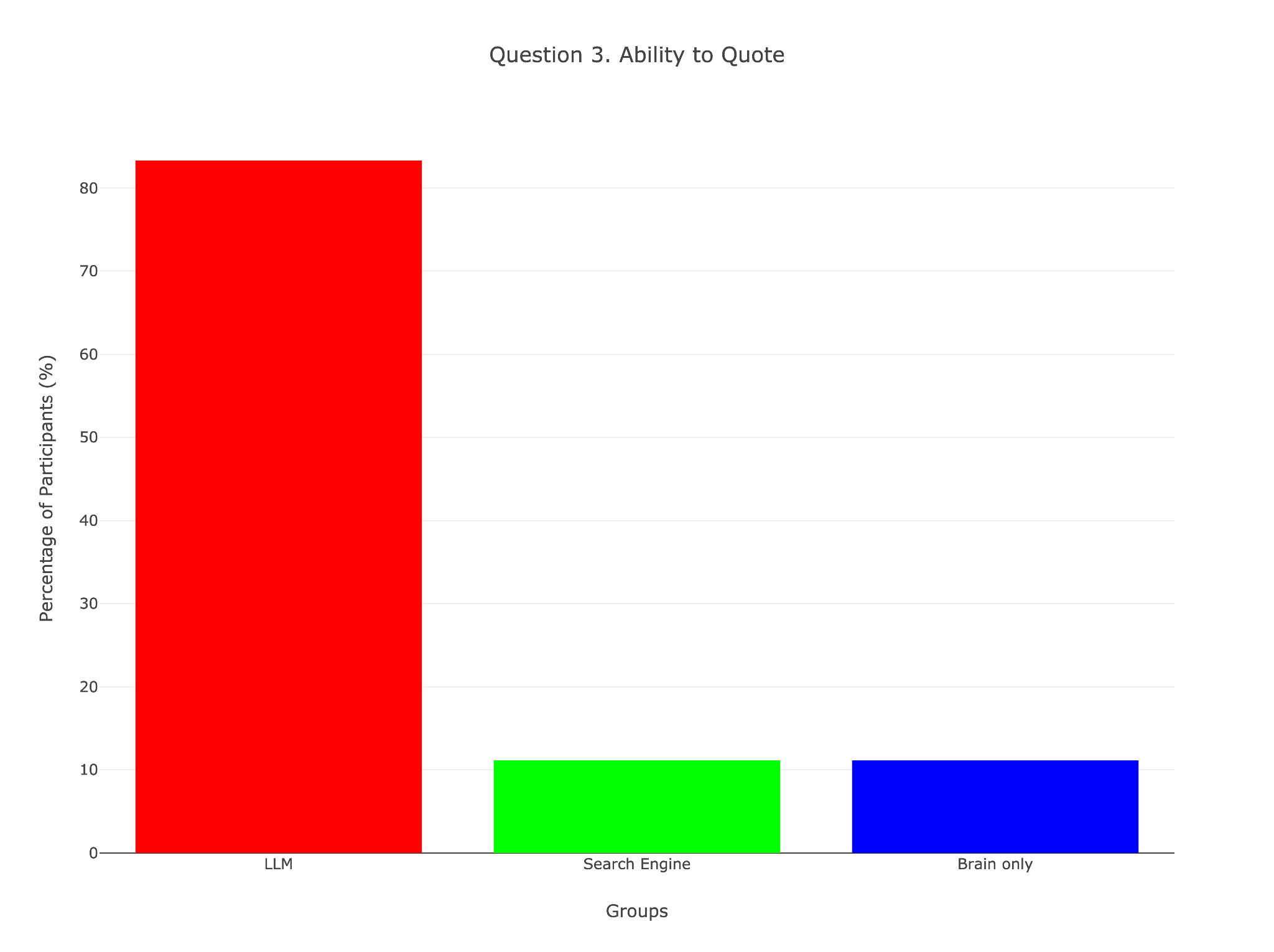

注目すべき結果は三つあります。第一に「記憶」の指標として行った引用テストです。各セッションの直後、参加者はエッセイを見ずに、そこから一文を引用するように指示されます 。執筆した内容がどの程度短期記憶に保持されているかを測る直接的なテストです

最初のセッションではLLMグループの83.3%(15/18)が自分の文章を一文も正確に引用できず、正確に再現できた人はゼロでした。一方、SearchとBrain-onlyは失敗率11.1%(2/18)で、有意差はF(2, 51)=79.98、p<.001という圧倒的なものです。便利さの代わりに覚えなくなる、という現象は数字でみると強烈ですね。

LLMを利用したグループのみ突出して自分が書いた文章を覚えていませんでした。

第二に脳波解析です。アルファ帯(8–12 Hz)の情報流で見ると、左頭頂P7→右側頭T8の結合がBrain-onlyではdDTF=0.053、LLMでは0.009と約6倍強く、p = 0.0002で有意でした。総有意結合数もBrain-onlyが79、LLMは42にとどまります。創造的思考で重要とされる前頭~頭頂ネットワークが、ツールなしの方がはるかに活発だったわけです。

第三に「慣れ」と「乗り換え」を見るセッションです。それまでLLMを使っていた参加者がツールなしで執筆した際、脳の活動は十分に回復しませんでした 。特に、自律的な思考に必要な高次のネットワークの働きが鈍いままで、AIへの依存が脳の働きに影響を残す可能性が示唆されました。そして、それまで自力で執筆していた参加者が初めてLLMを使用すると、脳全体の結合性が急激に上昇しました 。これは、自身の既存知識とLLMからの提案を統合するという、非常に高度な認知プロセスが働いたためと考えられます 。

利用するツールによって脳の使われ方が大きく異なることがわかりました。

課題は二つあります。一つは学習面での「認知負債」です。引用できなかったり、情報の結合ができないという状況は、短期的には効率を、長期的には深い理解を損ねるリスクを示しています。ただしLLMグループのエッセイはAI評価でも教員評価でも形式面で高得点を出しており、アウトプット品質が必ずしも低いわけではない点はフェアに見る必要があります。

もう一つはユーザー側の「慣れ」です。脳波が示すように、使い続ければ負荷は下がるものの、突然オフラインに戻るとパフォーマンスが急落します。対策として著者らは、①AIが提案した文章を声に出して再読し記憶と結び付ける、②エッセイの骨子だけをAIに任せ具体例と体験談は自分で書く、といった「ハイブリッド執筆」を教育現場で訓練すべきだと示唆しています。僕自身も、まず自分で書き散らしてからChatGPTに要約を頼む形にすると、脳がサボらずに済むと実感しています。

54人を対象にした本研究は、ChatGPTが作文を速く整える利点を持つ一方で、引用力やアルファ波ネットワークの弱体化という「認知負債」を生むことを数値で可視化しました。AIを味方にする鍵は、楽をする部分と自分の頭を使う部分を意識的に切り分けるリテラシー教育にあります。道具が進化しても、最後に文章を「自分ごと」として覚えていられるかどうかに学びの質が宿ると感じさせる研究でした。

今すぐ最大6つのAIを比較検証して、最適なモデルを見つけよう!

生成AIは思考の味方か、それとも敵か? 知識労働者のリアルな本音

2025年4月、マイクロソフトは「The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of KnowledgeWorkers(生成AIがクリティカルシンキングに及ぼす影響――知識労働者を対象とした調査による認知負荷の自己報告的な低減と自信効果)」という論文を発表しました。

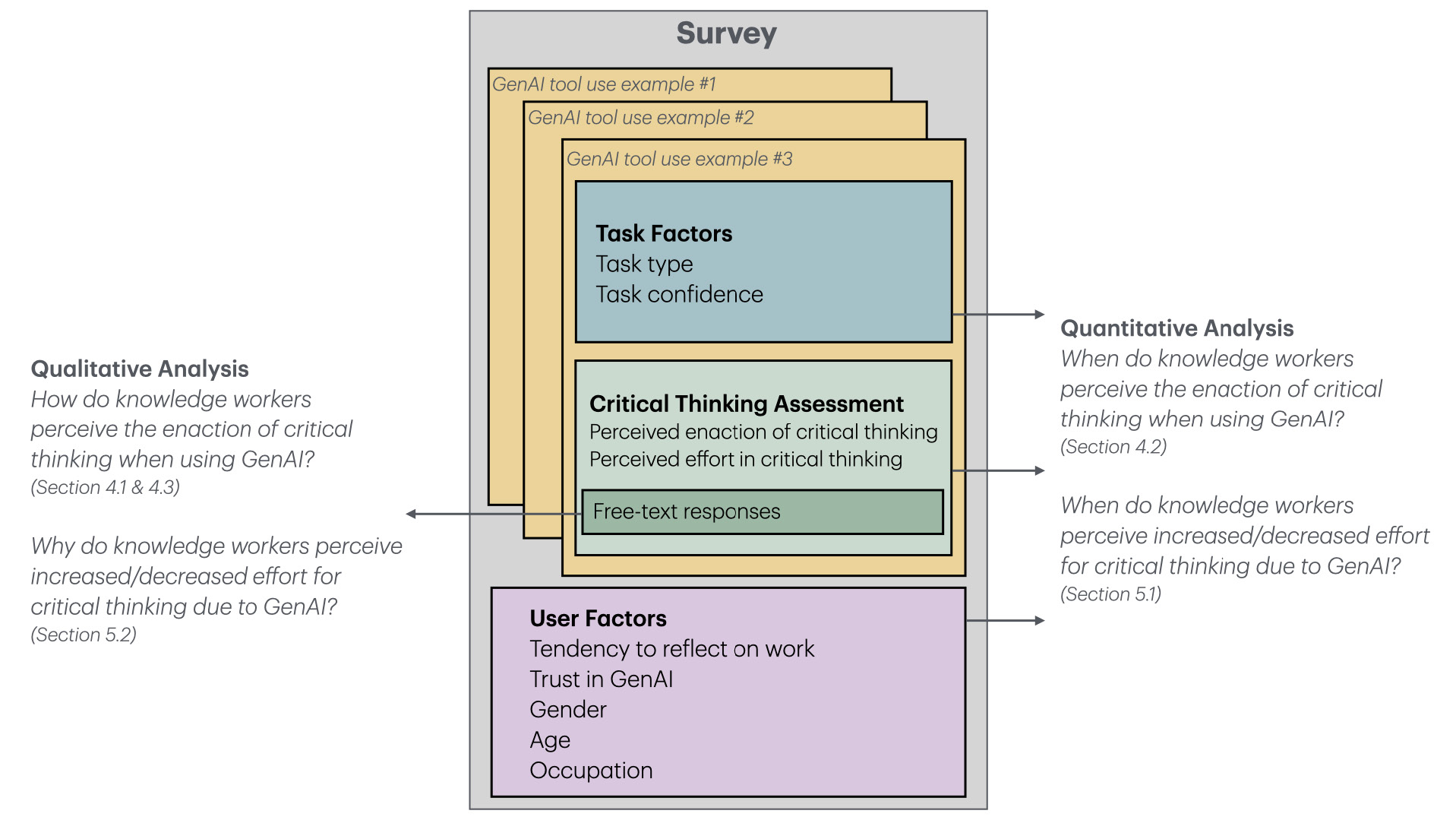

研究の目的は、知識労働者が仕事で生成AIを使うときに、一体いつ、どのように「クリティカルシンキング(批判的思考)」を働かせているのか、そしてAIの利用がその労力をどう変化させているのかを明らかにすることでした。

そのために、彼らはオンラインの調査プラットフォーム「Prolific」を通じて、仕事で週に1回以上は生成AIを使っていると回答した319人の知識労働者から、合計936件にも及ぶ具体的な利用事例を集めました。単なるアンケートではなく、参加者が実際に体験したリアルな事例に基づいているのがこの研究のすごいところです。

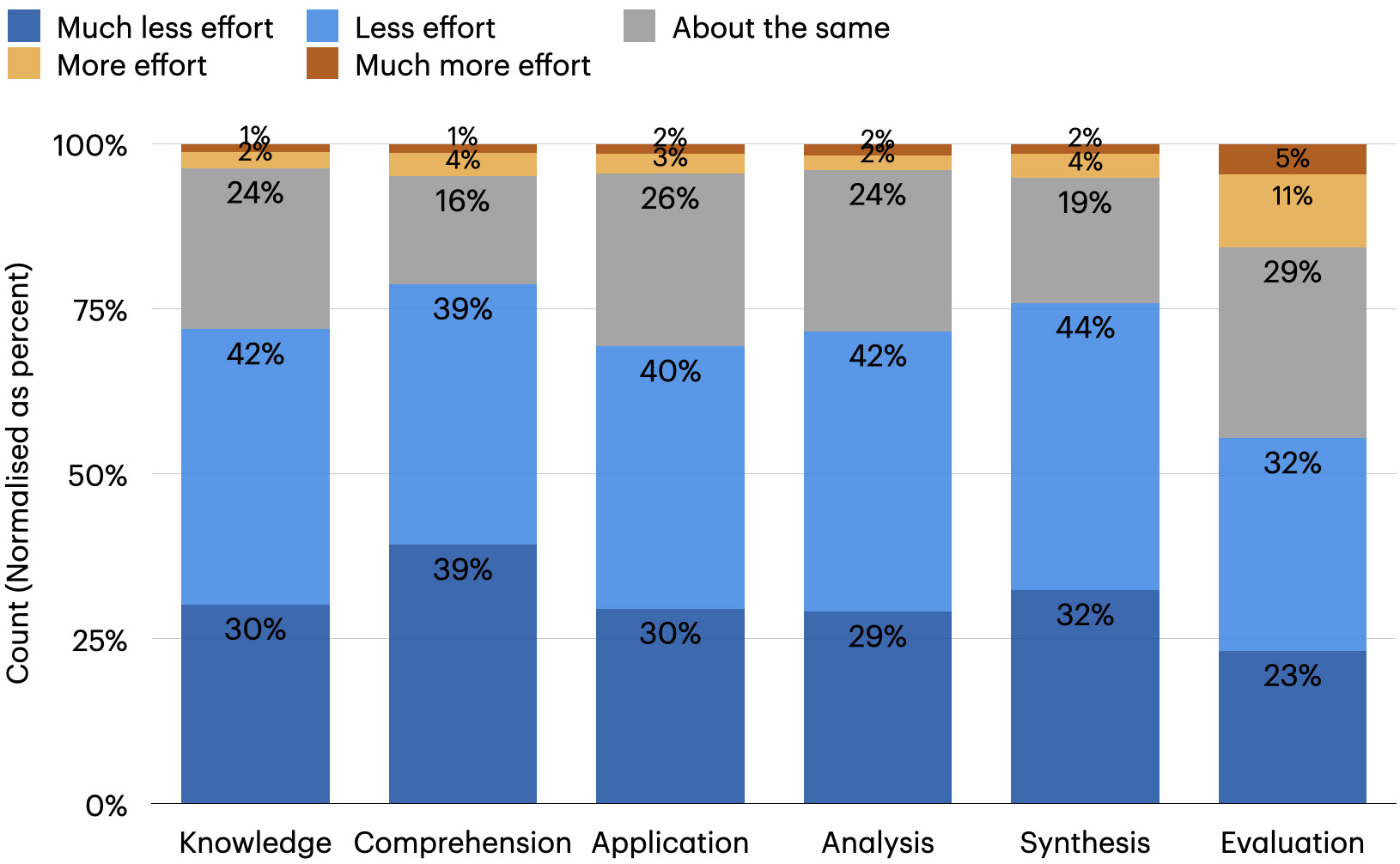

分析には、統計モデルを用いた定量的なアプローチと、自由記述を詳細に読み解く定性的なアプローチを組み合わせ、多角的に実態に迫っています。特に、クリティカルシンキングを測定するために、「ブルームのタキソノミー」という教育分野で広く知られる枠組みを用いて、「知識」「理解」「応用」「分析」「統合」「評価」という6つの認知活動に分けて、AI利用による労力の変化を尋ねています。

この研究で明らかになったのは、「AIへの自信」と「自分自身への自信」という2つの要素が、クリティカルシンキング(批判的思考)を行うかどうかに大きく影響するという現実です。

調査方法の設計図です。タスクのタイプと自信度、クリティカルシンキングの有無などの情報を収集しています。

調査に参加した知識労働者のうち、約6割が何らかのクリティカルシンキングを行っていたと答えています。しかし、AIの能力を強く信頼している人ほど、実際にはクリティカルシンキングを行う割合が著しく低いことが分かりました。統計的にも「AIなら完璧にやってくれる」と思うほど、自分で深く考えることをやめてしまいやすい傾向が示されています。

一方で、自分自身のタスク遂行能力や、AIの出力を評価する力に自信がある人ほど、積極的にクリティカルシンキングを行っていました。専門知識や経験が豊富な人ほど、AIを単なる答えを出す道具ではなく、自分の思考を深めるパートナーとして活用し、AIの出力を鵜呑みにせず吟味・修正してより質の高い成果を目指していることが浮き彫りになっています。

また、AIの利用は「思考の労力」の感じ方にも大きな変化をもたらしています。多くの人がAIを使うことで、情報の整理や思い出しといった作業の負担が減ったと感じています。特に「知識」や「理解」に関する活動では、7割以上が「労力が減った」と回答しています。ただし、AIへの信頼が高い人ほど労力の軽減を強く感じる一方で、自分に自信がある人はAIの出力を現実に応用したり評価したりする場面で、むしろ労力が増えたと感じる傾向も見られました。

この研究は、生成AIによって私たちの思考の「質」そのものが変化していることも示唆しています。かつては情報の「収集」に多くの時間と労力を費やしていましたが、その役割はAIが担うようになり、私たちは「AIが集めた情報が本当に正しいのか検証する」という新しい役割を担うようになっています。さらに、AIの出力を自分の目的や文脈に合わせて編集・統合したり、タスク全体の責任者としてAIを監督するなど、より高次の思考活動へとシフトしているのです。

ブルームの認知領域6分類ごとにクリティカルシンキングに要する労力がどう変わったかをまとめたグラフです。

この研究結果は、これからの時代にAIとどう付き合っていくべきか、重要なヒントを与えてくれます。まず直視すべきは、AIへの過度な信頼が私たちの考える力を鈍らせてしまうリスクです。特に「これは重要じゃないからAIに任せればいい」と安易に判断し続けると、長期的には認知能力が衰える「オートメーションの皮肉」と呼ばれる現象に陥る危険性があります。

また、「忙しくて考える時間がない」「品質チェックは別のチームの仕事だ」といったモチベーションの問題や、「AIの答えが正しいか判断できない」「どうすればもっと良い答えを引き出せるかわからない」といった能力の壁も、クリティカルシンキングを阻む要因として挙げられています。

では、どうすればいいのでしょうか。論文では、AIツールを設計する側への提案として、AIの出力の信頼度を可視化したり、最終的な責任はユーザーにあることを明確に伝えたりして、ユーザーの過信を防ぐ工夫が挙げられています。また、ユーザーが思考停止に陥りそうなタイミングで「本当にこれでいいですか?」と問いかけてくれる機能や、AIとの対話を通じてユーザー自身の専門スキルが向上するような動機付けも有効です。

結論として、この研究は、生成AIと人間の関係を「便利か、危険か」という単純な二元論で語るのではなく、私たち自身がAIをどう使いこなし、「考える力」をどう育てていくかという、主体的で能動的な姿勢が求められていることを教えてくれています。

AIとの協働作業は瞬間的な成果を上げるが、働く意欲を削ぐという衝撃

2025年4月、「Human-generative AI collaboration enhances task performance but undermines human’s intrinsic motivation(「人間と生成AIの協働はタスクの成果を向上させるが、人間の内発的動機づけを低下させる)」という論文が公開されました。この研究を主導したのは、中国の名門・浙江大学経営学院の研究チームです。主要メンバーは、Suqing Wu氏、Yukun Liu氏(責任著者)、Mengqi Ruan氏、Siyu Chen氏、そしてXiao-Yun Xie氏です。

現在、職場での生成AI活用が急速に広がる中、多くの研究がAIとの協働による生産性向上を報告しています。しかし、Liu氏らの研究チームが着目したのは、これまで見過ごされがちだった長期的な心理的影響でした。

研究の目的は、人間と生成AIの協働作業が、即座のタスクパフォーマンスだけでなく、その後の独立作業や心理状態にどのような影響を与えるかを包括的に検証することです。特に、自己決定理論(Self-Determination Theory)に基づいて、内在的動機、コントロール感、退屈感という3つの心理的側面に焦点を当てました。

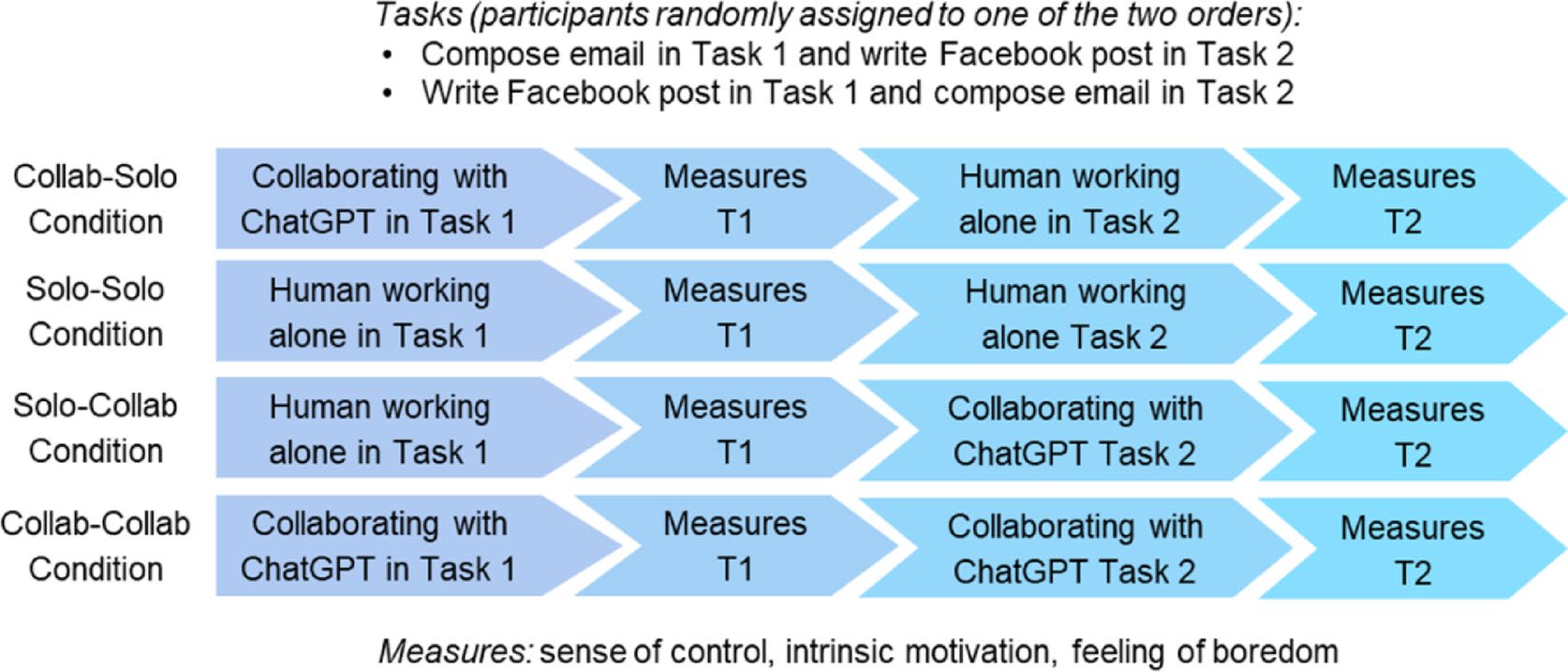

研究方法として、オンラインプラットフォームProlificを通じて総計3562人の参加者を募集し、4つの独立した実験を実施しました。Study 1(352人)ではFacebookの投稿作成、Study 2(793人)では人事評価レポート、Study 3(793人)では歓迎メール、Study 4(1624人)では2つのテキスト作成タスクを実施しました。

ChatGPTを使うタスクと使わないタスクを組み合わせてテストしました。

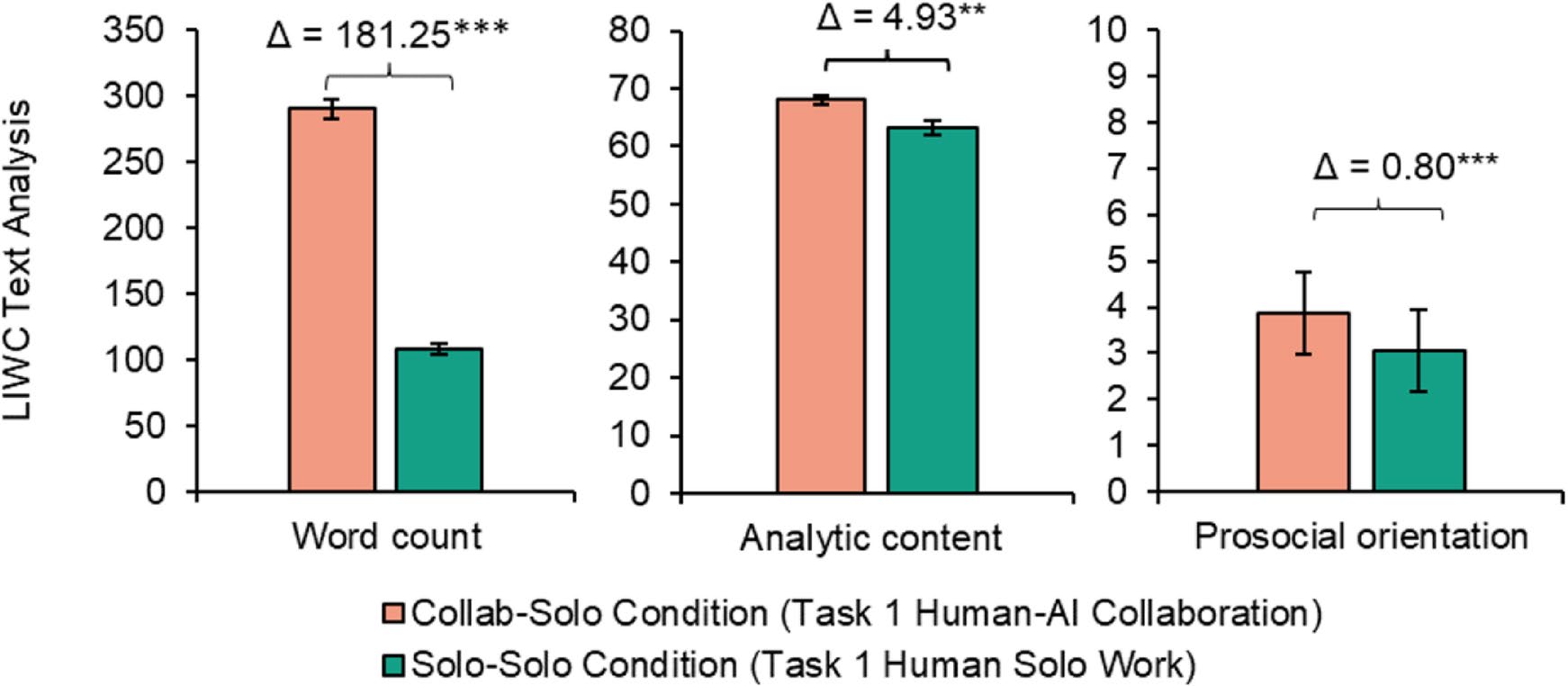

やはり、AIとの協働による即座のパフォーマンス向上効果が目立ちました。特にStudy 2では、AI協働により文書の長さが約2.7倍に増加しました(289語 vs 109語)。これは統計学的にも非常に大きな効果(効果量d=1.50)を示しています。内容の質についても、分析的で親社会的な表現が有意に向上し、文書全体の完成度が大幅に高まりました。

一方で、AIとの協働経験が次の単独作業にもたらすプラス効果は限定的でした。Study 1では創造性において小さな改善が見られたものの、Study 2以降では明確なスピルオーバー効果は確認されませんでした。むしろ、Study 4では次のタスクでわずかに劣る結果となりました。

心理的な影響では、予想外のパターンが浮き彫りになりました。AI協働から単独作業への移行により、確かにコントロール感は回復しましたが、その代償として内在的動機が大幅に低下し、退屈感が増加したのです。特に内在的動機の低下は中程度の効果量(d=-0.51)を示し、働く意欲への深刻な影響が懸念されます。Study 4では、単独作業からAI協働への移行時にコントロール感が大幅に低下することも確認され、タスクの切り替えそのものが心理的負担となることが明らかになりました。

AIとの協働は確かに、パフォーマンスの向上につながります。

この研究では、AIとの協働が諸刃の剣となりかねないことがわかりました。確かにAIとの協働は即座にタスクの品質を向上させますが、その代償として働く人の内在的動機を削ぎ、退屈感を増加させる可能性があります。特に、AI協働から単独作業への移行時に、これらの悪影響が顕著に現れることが明らかになりました。

対策としては、AI開発者は、人間の主体性を保持できるような協働プラットフォームの設計を重視すべきでしょう。具体的には、ユーザーのフィードバック、入力、カスタマイゼーションを統合し、AI協働中でもユーザーがコントロール感を維持できるようにすることが求められます。

また、職務設計者にとっては、AI技術の恩恵を享受しながらも個人の心理的ウェルビーイングを維持することの重要性が浮き彫りになりました。これは、労働者の好みやスキルに合わせてタスクを調整し、持続的な従業員のモチベーションと意味のある協働を促進する職務設計の必要性を示しています。

働く個人レベルでは、AI協働と独立作業の間でバランスを取りながら、職務を主体的に構築することで、専門的努力における充実感とモチベーションを促進することができるでしょう。

便利さの代償を越えて。問われるべきは私たちの主体性

生成AIは、私たちの学習や仕事に革命的な効率化をもたらす一方、その利用が思考力や意欲に与える影響が科学的に明らかになってきました。今回紹介した最新の研究は、生成AIへの依存が記憶の定着を妨げ、AIへの過信が批判的思考を鈍らせ、さらには短期的な成果と引き換えに仕事への内発的な動機を削いでしまう危険性を、脳科学や心理学の見地から具体的に示しています。

今求められるのは「AIは便利か、危険か」という二元論ではなく、「人間がどう主体性を持って使いこなすか」という本質的な問いです。AIの提案を鵜呑みにせずに出力を吟味し、効率化で生まれた時間をより高次の思考に充てるなど、意識的な使い分けのリテラシーが不可欠です。AIを、自らの能力を高める最強のパートナーへと変える鍵は、私たちユーザー自身の手に委ねられているのです。

この記事の監修

柳谷智宣(Yanagiya Tomonori)監修

ITライターとして1998年から活動し、2022年からはAI領域に注力。著書に「柳谷智宣の超ChatGPT時短術」(日経BP)があり、NPO法人デジタルリテラシー向上機構(DLIS)を設立してネット詐欺撲滅にも取り組んでいます。第4次AIブームは日本の経済復活の一助になると考え、生成AI技術の活用法を中心に、初級者向けの情報発信を行っています。